大脑神经网络具有复杂的语义记忆和动态连接性,可将不断变化的输入与其庞大记忆中的经验联系起来,高效执行复杂多变的任务。目前,人工智能系统中广泛应用的神经网络模型大多是静态的,随着数据量的不断增长,其在传统数字计算系统中产生大量能耗和时间开销,难以适应外界环境的变化。

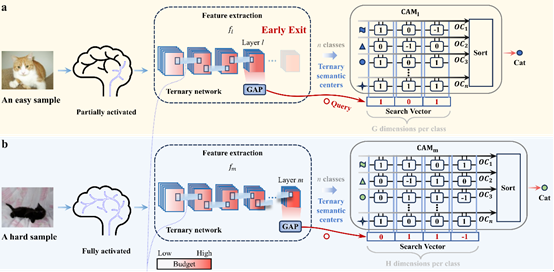

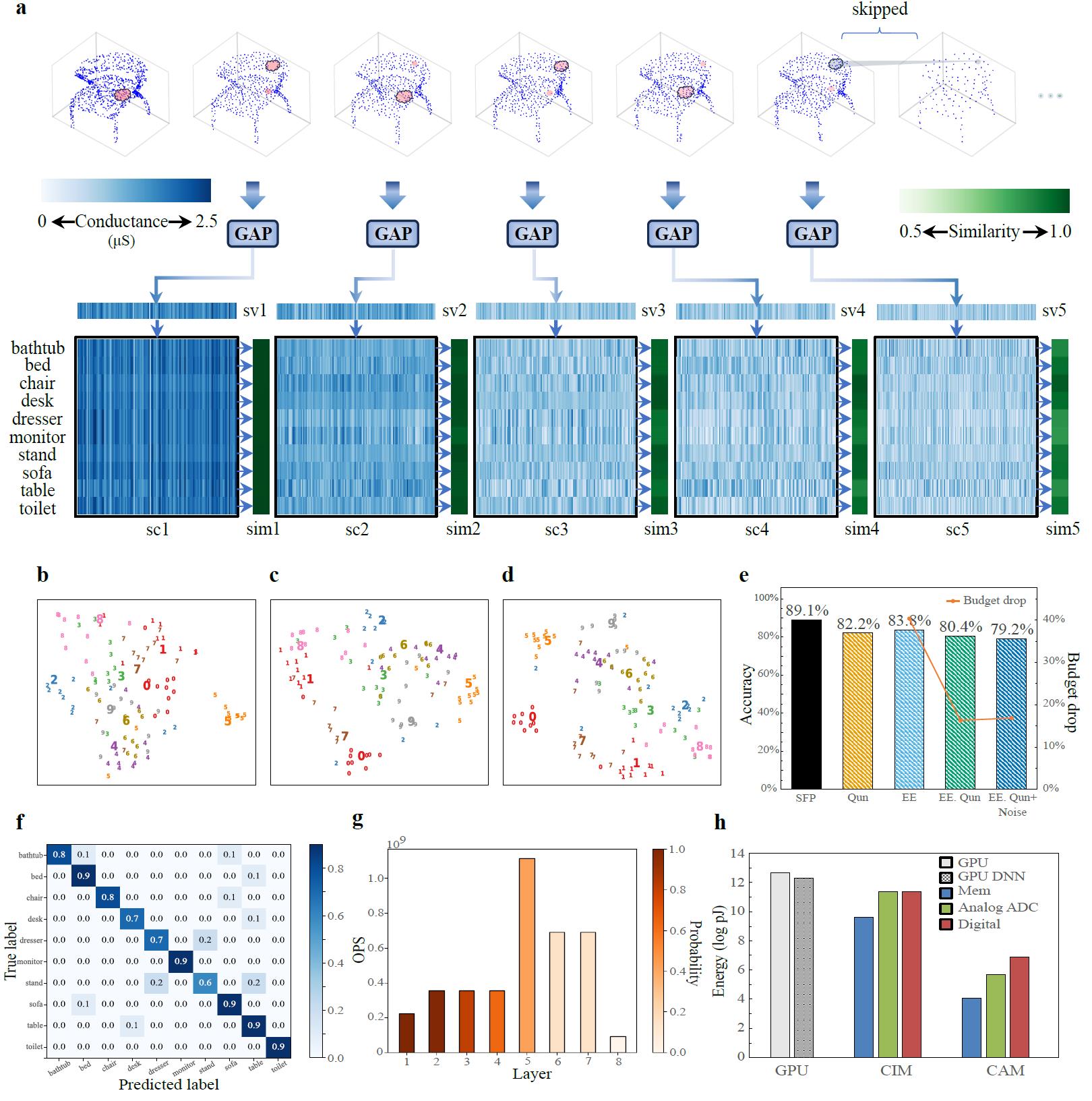

针对这一问题,中科院微电子所微电子器件与集成技术研发中心刘明院士团队的尚大山研究员与香港大学电子工程系的王中锐博士、复旦大学张续猛博士合作,通过将人工神经网络与大脑的动态可重构性相结合,开发了一种基于语义记忆的动态神经网络(Dynamic neural network)。该网络将新信息与过去的经验信息进行关联,利用输入样本与语义记忆的相似性,为神经网络配备动态连接,从而根据需求分配计算资源。相比静态网络,语义记动态神经网络能够根据计算资源权衡识别准确性和计算效率,可在资源受限设备或分布式计算环境中展现出色的性能。团队基于TaN/TaOx/Ta/TiN阻变存储器阵列验证了动态神经网络设计在ResNet和PointNet++网络框架上的有效性。提取特征的神经网络和语义记忆分别在基于阻变存储器的存内计算(CIM)和内容寻址存储(CAM)的组合结构上进行物理实现,有效缓解了冯·诺依曼计算瓶颈。在对2D图像数据集MNIST和3D点云数据集ModelNet的分类任务中,该设计实现了与软件相当的准确率,相比于静态神经网络减少了48.1%和15.9%的计算量,相比传统数字硬件系统降低了计算能耗。这种软硬件协同设计研究为开发与大脑的适应性和效率相媲美的人工智能系统提供了参考。

该项目得到了科技部、国家自然科学基金委、中国科学院的支持。成果近期发表在《科学-进展》期刊上(Science Advances,10,eado1058,2024)。香港大学硕士生张越与微电子所博士生张握瑜为共同第一作者,香港大学王中锐博士,复旦大学张续猛博士和微电子所尚大山研究员为该文章的共同通讯作者。参与本工作的还有微电子所许晓欣研究员、复旦大学刘琦教授、香港大学齐晓娟博士和香港科技大学郑光廷教授。

文章链接:https://www.science.org/doi/10.1126/sciadv.ado1058

Semantic memory–based dynamic neural network using memristive ternary CIM and CAM for 2D and 3D vision

Y. Zhang, W. Zhang, S. Wang, N. Lin, Y. Yu, Y. He, B. Wang, H. Jiang, P. Lin, X. Xu, X. Qi, Z. Wang*, X. Zhang*, D. S. Shang*, Q. Liu, K. Cheng, M. Liu

Science Advances 10, eado1058 (2024)

图1 :基于语义记忆的脑启发动态神经网络硬件软件协同设计

图2 :基于CIM/CAM的动态PointNet++模型用于ModelNet数据集分类