英国初创公司Opteran是谢菲尔德大学的一家分支机构,与大多数行业相比,它对神经形态工程有着完全不同的看法。该公司对昆虫大脑进行了反向工程,以开发出可用于机器人的防撞和导航新算法。

Opteran将其人工智能的新方法称为“自然智能”,为系统的算法部分提供了直接的生物灵感,这与现有的计算机视觉方法不同。计算机视觉方法主要使用主流人工智能/深度学习或摄影测量,而摄影测量则是一种使用2D照片来推断3D对象信息(如尺寸)的技术。

Opteran的自然智能不需要训练数据,也不需要训练,更像是生物大脑的工作方式。如今的深度学习能够实现狭义的人工智能-它可以在有限的环境(如电脑游戏)中执行精心定义的任务,但这需要大量的训练数据,也需要大量的计算资源和功耗。Opteran希望通过密切模仿大脑的实际功能来克服深度学习的局限性,以便在计算资源和功耗预算紧张的情况下,能够设计出与现实世界互动的自主机器人。

Opteran首席科学官Marshall教授最近在嵌入式视觉峰会上的一次演讲中说:“我们的目的是逆转——或重新设计自然算法,创造一种软件大脑,使机器能够更像自然生物那样来感知、行动和适应。”

“模仿大脑开发人工智能是一个古老的想法,可以追溯到艾伦·图灵,”他说。“另一方面,深度学习基于灵长类动物大脑视觉皮层的一小部分的草图,却忽略了真实大脑的巨大复杂性……现代神经科学技术正越来越多地被用来提供所需的信息,以忠实地对真实大脑如何解决自主性问题进行反向工程。”

反向大脑需要一起研究动物行为、神经科学和解剖学。Opteran一直在研究蜜蜂的大脑,因为它们既足够简单,又能够协调复杂的行为。蜜蜂能够在超过7英里的距离上进行导航,并准确地向其他蜜蜂传达它们的思维地图。它在针头大小的高能效大脑中,仅用不到100万个神经元就完成了所有这些功能。

Opteran成功地反向设计了蜜蜂用于光流估计(由观察者相对运动引起的场景中物体的视在运动)的算法。该算法可在小型FPGA上实现光流处理,主频为10kHz,功耗小于1W。

“这种性能在所有维度上都超过了深度学习技术的水平,包括鲁棒性、功率和速度,”Marshall说。

生物算法

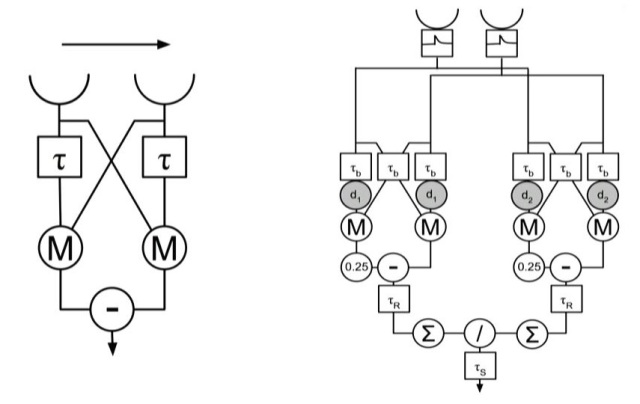

生物运动检测是在20世纪60年代基于昆虫大脑实验建立的数学模型。这个模型被称为hassen stein–Reichardt探测器,它已经通过不同的实验方法得到了多次验证。在这个模型中,大脑接收来自眼睛中两个相邻受体的信号。当一个受体的输入被延迟后,如果大脑同时接收到这两个信号,神经元就会激活,因为这意味着所看到的物体正在移动。再对另一个信号也进行延迟,如果结果也是这样的话,则意味着,物体在任一方向上移动时模型均有效(故模型具有对称性)。

图1:作为生物大脑中的运动检测模型的hassen stein–Reichardt检测器(左);源于蜜蜂大脑的Opteran专利算法(右)。(来源:Opteran)

Marshall在他的演讲中解释说,Hassenstein-Reichardt检测器虽然足以模拟果蝇的运动检测,但对空间频率(图像中明暗分布模式)和对比度高度敏感,因此不太适合广义视觉导航。

“蜜蜂做的就更聪明一些,它们对这些基本单位做了一种新颖安排,”Marshall说。“蜜蜂的飞行行为对空间频率和对比度表现出很强的鲁棒性,所以肯定还有其他原因。”

Opteran利用蜜蜂的行为和神经科学数据,实现了自己的视觉惯性里程估计器和防撞算法,见图1(右)。该算法经过基准测试,发现在理论精度和噪声鲁棒性方面优于FlowNet2s(当时最先进的深度学习算法)。Marshall指出,深度学习的实现还需要GPU加速,并伴有相关的功耗损失。

真实世界的机器人技术

这是一个很好的理论,但它在现实世界中有效吗?Opteran确实已经将其算法应用于现实世界的机器人。该公司开发了一款机器人狗演示版Hopper,其外形与波士顿动力公司的Spot相似。Hopper基于Opteran的碰撞预测和规避算法,采用基于边缘的视觉专属解决方案;当识别出潜在的碰撞时,一个简单的控制器会令其转向。

Opteran还在研究一种3D导航算法,同样也是基于蜜蜂。该解决方案将等同于当今的SLAM(同步定位和映射)算法,但它也将处理路径规划、路由和语义。Marshall说,利用同样的硬件,功耗只有几分之一瓦。

“另一个大的节省是由该方法产生地图时的内存节省,”他说。“对于传统的基于摄影测量的SLAM生成的地图,每平方米所需的字节数约为数百兆到数千兆,这便给大面积地图的绘制带来重大问题,而我们的地图每平方米只消耗几千字节的内存。”

该算法的演示版已用于一架携带一台低分辨率摄像机(小于10000像素)的小型无人机上,实现了基于视觉的自主导航。

软硬件

Opteran的开发套件使用小型Xilinx Zynqberry FPGA模块,重量不到30g,功耗不到3W。该套件需要两个相机,使用的是廉价(20美元)的Raspberry Pi相机。不过,在产品开发期间,Opteran还将与其他OEM厂商合作,校准其他类型的相机算法。

目前的FPGA可以同时运行Opteran的全方向光流处理和碰撞预测算法。Marshall说,根据需要,未来的硬件可能会迁移到更大的FPGA或GPU上。

该公司正在为机器人应用构建软件堆栈。在电子稳定全景视觉系统的顶部,有防撞,然后是导航。决策引擎的工作正在进行中(预计2023年完成),以允许机器人决定它应该去哪里以及在什么情况下去。未来的元素包括社交、因果和抽象引擎,这些引擎将允许机器人相互交互,在现实世界环境中推断因果结构,并从体验情境中抽象出一般准则。所有这些引擎都将基于生物系统—无需深度学习或基于规则的学习系统。

目前,已有客户在cobot手臂、无人机和采矿机器人中使用了稳定视觉、防撞和导航功能。且Opteran上个月已完成融资,将为其自然智能方法的商业化和其堆栈中剩余算法的开发提供支持。

公司未来的研究方向还可能包括对其他更复杂动物大脑的研究,“我们从昆虫开始,但这种方法会扩展。将在适当的时候研究脊椎动物,这无疑是我们的路线图,” Marshall介绍道。

(参考原文:Reverse-Engineering Insect Brains to Make Robots )

本文为《电子工程专辑》2022年11月刊杂志文章,版权所有,禁止转载。点击申请免费杂志订阅