在NVIDIA FY2024(截至2024年1月底)年报中,黄仁勋(NVIDIA CEO)写了一篇长达7页的致股东信,重心还是在谈行业发展的热点和未来上。其中最后一条是“机器人的ChatGPT时刻即将到来”。今年黄仁勋也在不止一个场合谈到,将AI从虚拟世界带到物理世界,就要看机器人了。在此语境下,机器人的潜在发展逻辑,是AI的物理外延。

机器人历经好几十年的不同发展阶段,新时代的机器人就是从新世纪开始,以AI/ML技术兴起为契机的;加上传感器、制动、材料技术的精进,以及加速计算呈井喷之势;机器人的确有了新的发展机会。

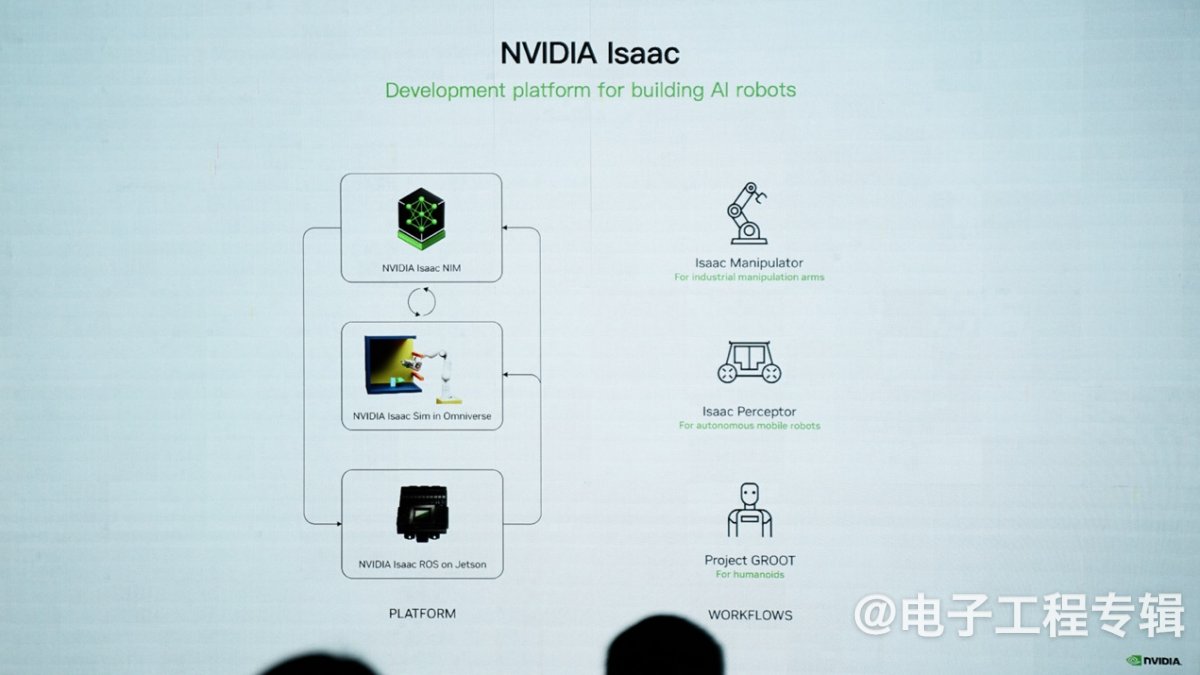

不过AI应当不是NVIDIA于机器人发展逻辑的全部。2019年我们参加GTC开发者大会活动时,NVIDIA刚刚发布了最新的Isaac SDK。Isaac是基于AI的机器人开发平台。当时的Isaac还比较初级——主要体现在其强化学习(RL)仿真环境是Isaac Gym。

Isaac Gym是个仿真训练空间:在机器人“脑内”率先进行学习和模拟。比如说机械臂在现实世界里要拿起物体,则可以先在仿真训练空间中模拟整个过程以得到工作路径。听起来好像和现在的Isaac Sim差不多。

不过当时还没有Omniverse——也就是NVIDIA元宇宙。所以Isaac Gym对机器人的种类支持有限,感知能力相对欠缺,也没有复杂的场景构建能力,更不用提底层的OpenUSD标准格式等属于Omniverse的关键特性。这是NVIDIA后来在Omniverse的基础上,构建起Isaac Sim的原因。

所以在我们看来,老黄有底气说出机器人ChatGPT时刻即将到来的关键是,NVIDIA同时具备了NVIDIA AI和NVIDIA Omniverse两项核心能力。这也符合NVIDIA认为当代机器人需要“3台计算机”的逻辑,一台搞AI,一台做仿真,还有一台就是机器人部署了。

最近的ROSCon China 2024大会上,NVIDIA又在主题演讲中谈到了Isaac,并且展示了当前以Jetson芯片为基础的机器人生态发展情况。这也是我们在AI+仿真技术,双双走向成熟的时代背景下,了解机器人技术的现状与未来的机会。

先看一个解决方案的例子

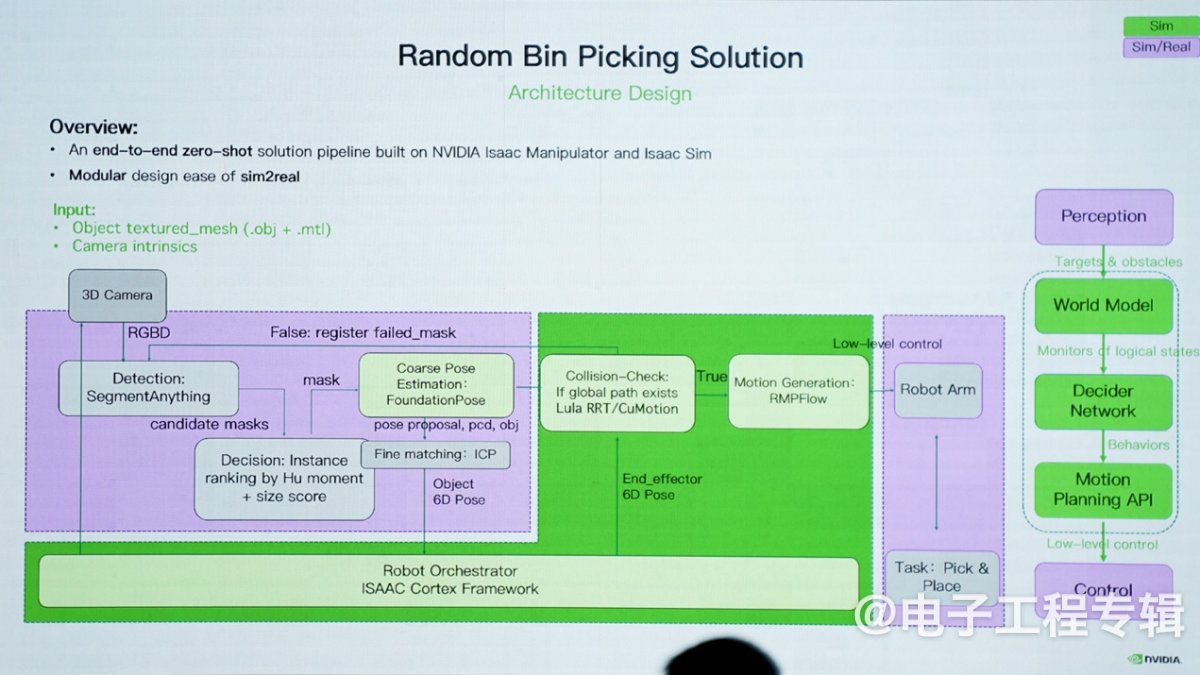

NVIDIA在ROSCon的展位上,展示了机械臂的无序拣选解决方案开发。我们认为以此流程为例,能够大致理清NVIDIA究竟在其中做了些什么,以及当代AI+仿真为关键技术的机器人开发整体是什么样。

这个demo展示的,是机械臂的随机深框抓取。针对深框中的不同对象——通常是无序杂乱的,可能是工业应用中的零件,机械臂藉由视觉感知去抓取对象,后续可能以特定的位姿摆到下游的生产线上。

这是个听起来还挺简单的场景。但实际上存在很多细枝末节的工程问题。比如工业零件的3D感知问题、深框抓取的碰撞问题等。NVIDIA针对这一问题的整套逻辑构建于Isaac Manipulator基础上——这是专门面向工业机械臂的参考工作流。这里稍微提一句,与Isaac Manipulator并列的,还有面向自主移动机器人的Isaac Perceptor,以及今年特别火、面向人形机器人开发设计的Project GR00T。当然,它们都构建在Isaac Sim技术基础之上。

用户而输入工业零件(或抓取对象)有材质贴图的3D几何模型——如来自CAD软件;也可以藉由3D相机的RGBD数据流及相机内参。基于已有信息,ISAAC Cortex决策框架进行任务编排与调度。

上面这张图给出的输入示例,将来自3D相机——RGBD数据流喂给检测算法;后续的决策算法根据设计好的排序规则,得分高的实例会喂给FoundationPose(6D位姿估计算法);后将识别到的、需要抓取目标的6D位姿,发往碰撞检测模块——此处cuMotion是其中关键,用于在复杂动态环境中,进行无碰撞轨迹规划的算法。

cuMotion根据机械臂状态、目标6D位姿、环境中的障碍物,来求解是否存在无碰撞的全局轨迹;如果有,则调用Motion Generation算法,生成机械臂的Low-level control,发往控制器完成对应的动作...

这套流程包含有感知、决策、控制三个部分。英伟达机器人解决方案架构师Rebecca Zhang表示,由于其模块化设计,“很容易实现sim-to-real、仿真到实机的迁移”;而且“整个流程很容易部署或调试;也很容易切换不同的manipulator实体或不同的末端执行器——像是把吸盘换成两指夹具,机器人换成不同品牌的产品等”...

回归三台计算机问题

细究上述Isaac Manipulator工作流的关键组成部分,主要是三个AI基础模型:

(1)目标检测算法SyntheticaDERT是基于Transformer的大模型,速度比SOTA快了9倍;

(2)6D位姿估计和追踪的预训练模型FoundationPose则可对新颖对象进行位姿识别与追踪,“借助LLM和文生3D的能力”,“在Isaac Sim中合成了大量数据进行预训练”,“结合无需标注的对比学习方式,具备出色的泛化能力,对没见过的新颖物体能够直接进行zero-shot部署”;

(3)无碰撞轨迹规划的cuMotion对比传统算法,达成数倍的成功率与路径规划速度提升...

从Isaac Manipulator这套参考流程,是可以看到AI、生成式AI在当代机器人开发解决方案中的重要性的。“机器人开发者、OEM公司、ISV厂商等,都可以选择参考其中部分模块或整个工作流,将其已有产品集成到其中。”Rebecca在主题演讲中说,Isaac Manipulator“能够加速机械臂运动生成抓取的节拍,让开发者快速部署和验证已有算法”。

基于上述内容,回到NVIDIA过去一年一直在谈的3台计算机的逻辑,情况就变成了这样:第一台做AI模型训练——包括感知、抓取、6D位姿估计与追踪等;NVIDIA在其中提供了不少相关的预训练模型;

第二台则是仿真计算机,底层是Omniverse,更具体地说建基于Isaac Sim机器人仿真软件。在Isaac Sim上快速部署和验证已有的AI算法,可进行在线模型训练与开发;另外也用于进行合成数据生成,扩增数据集进行模型的迭代与优化。

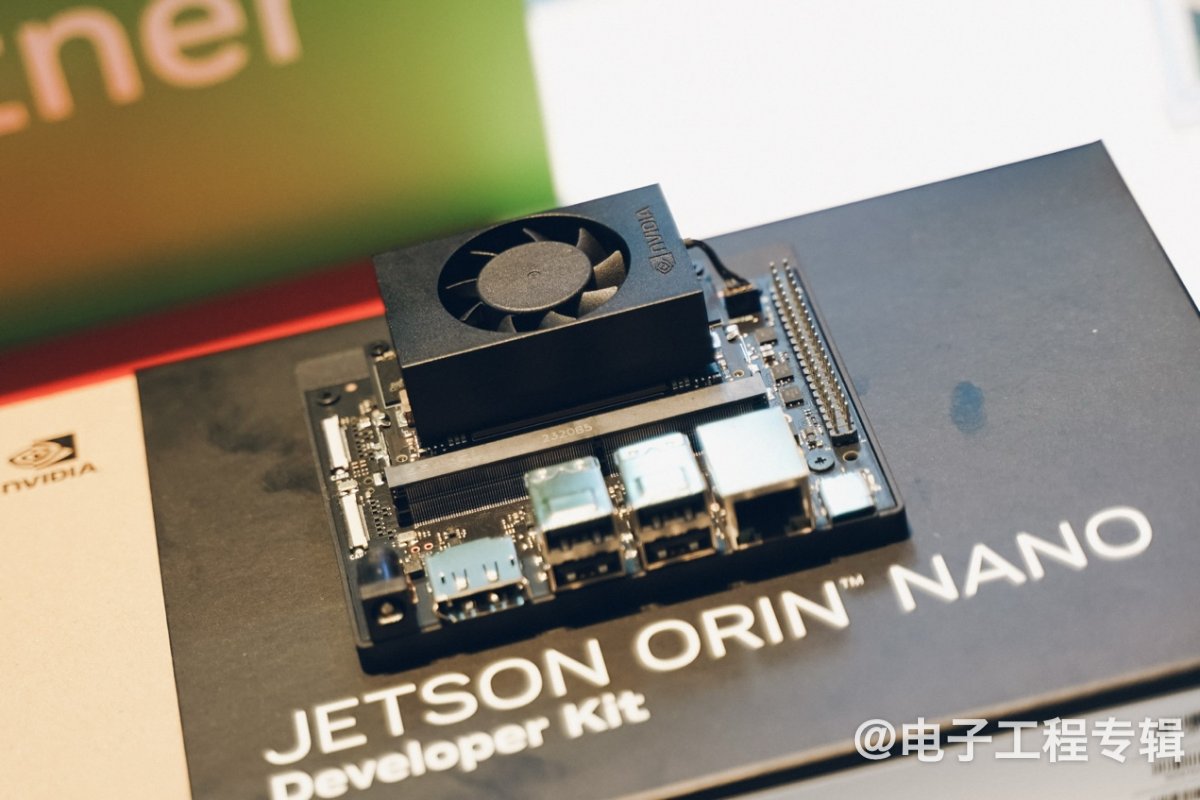

第三台自然就是基于Jetson芯片的嵌入式计算机了,对应的来自上述两台计算机的算法和结果就部署到机器人本体上。

值得一提的是,这第3台计算机上还有个关键即Isaac ROS。NVIDIA对于ROS生态的拥抱应该是从2021年开始的。而Isaac ROS是达成了NVIDIA GPU加速的ROS 2软件包集合。不单有ROS相关应用组件,也有Isaac SDK和加速库,以及诸如Isaac Manipulator这样的参考工作流。

抛开围绕NVIDIA AI与Omniverse的生态不谈,机器人应用的生态中心或许就在ROS这个中间件上。“ROS是生态系统的粘合剂”。配合ROS开源生态的其他资源,NVIDIA也就构成了机器人的端到端解决方案。Isaac ROS 3.2版即将在本月发布。

仿真,于世界和机器人的价值

《电子工程专辑》2025十大技术趋势预测有一大部分都是和AI、仿真相关的。我们认为,数字化及更多仿真技术的渗透会成为接下来几年各行各业的趋势。

就好像SpaceX星舰相较所有同类航天产品的技术领先,在于其打破火箭研发传统流程,将近10年前就将注意力主要放在仿真技术上,不仅大幅加速了研发迭代速度,而且降低了火箭研发成本。

可能不少半导体与计算机领域的同人无法想象,航空航天、生命科学、药物发现等传统领域的数字仿真技术渗透率,有些连1%都不到。“数字仿真”用更时髦的话来说就是“数字孪生”,或者往大了说是“元宇宙”。这也是NVIDIA这类市场参与者于Omniverse产品大力开拓传统行业的原因:潜在市场巨大。机器人显然是其中的关键组成部分。

为了验证和训练,“把一堆机械臂都生产出来,放到一起,或者搭建完整产线去试错,成本是任何企业都无法承受的。”NVIDIA展位的工程师在交流中提到,“藉由仿真技术,只需要一台工作站,用我们的GPU和软件,很快就有相应的数据,能够快速验证算法。这就是NVIDIA AI + Omniverse解决问题的价值了。”

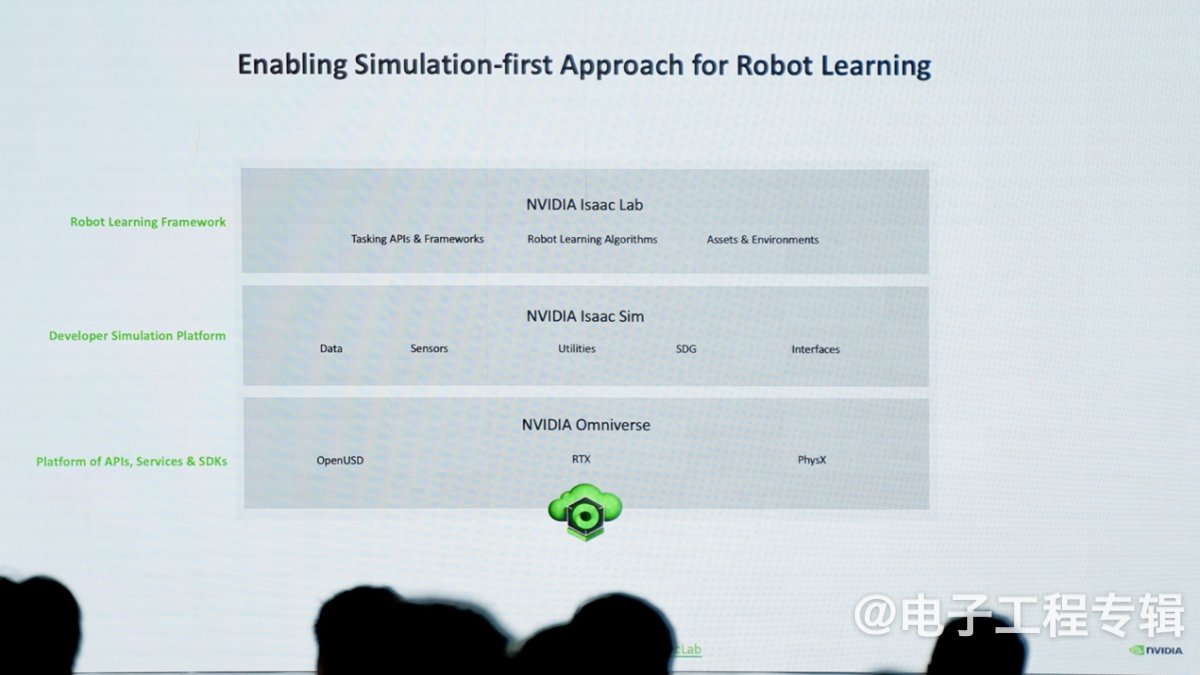

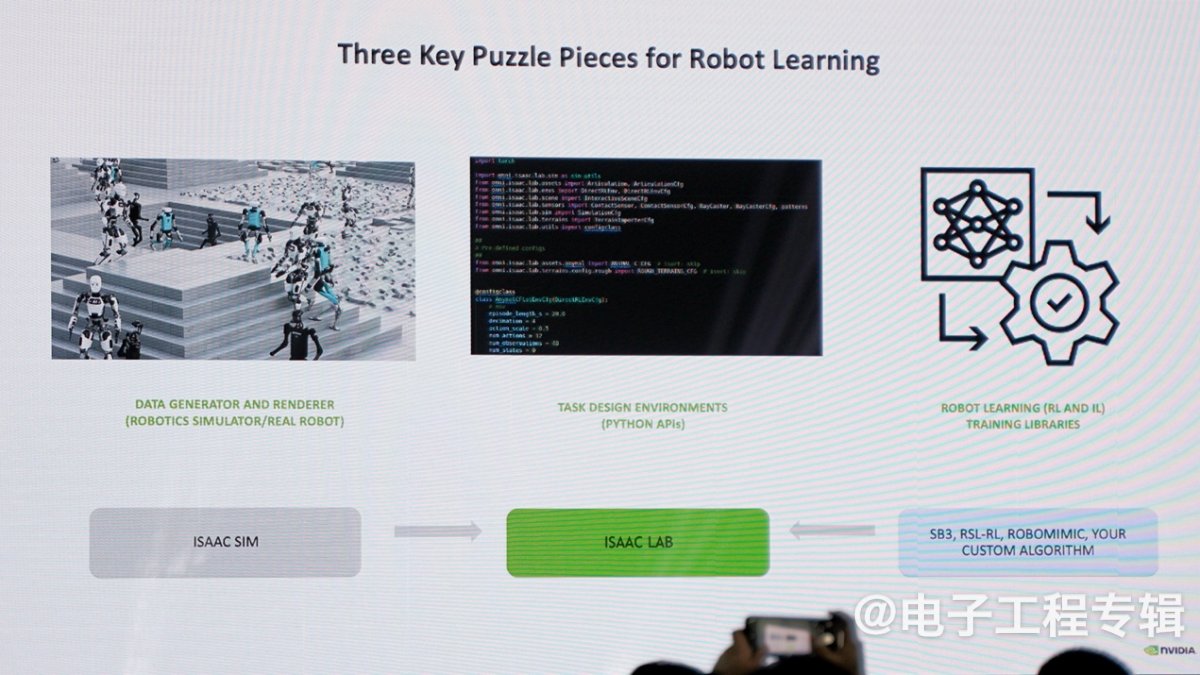

Isaac Sim就是以Omniverse为基础的软件工具,其中包括诸多仿真资产,用于机器人在虚拟世界的训练。英伟达机器人解决方案架构师Lia Liang在演讲中特别介绍了Isaac Lab:“我们一直专注做simulation first(仿真优先)的机器学习方法。这个工具就是开源的Isaac Lab。”

Isaac Lab是个支持强化学习与模仿学习、支持多GPU多节点并行加速的框架。展位上展示的就是用Isaac Lab进行强化学习训练和推理的过程。在Isaac Sim中构建复杂环境,尔后选择社区中的强化学习框架——Isaac Lab就能通过Python API实现定制化的任务设计与开发流程。

Lia总结Isaac Lab三大亮点:(1)精准的物理仿真模块——据说接下来NVIDIA准备在Isaac Lab中支持更多开源的物理引擎;(2)API和学习方法的模块化使用,“减少训练过程中逻辑性错误的发生几率”;(3)以及多机多卡并行加速的支持——NVIDIA的加速计算老本行。

目前Isaac Lab 1.2版本里面集成的资产涵盖有25种环境以适配包括灵巧操控、运动(locomotion)、导航(navigation)等的强化学习训练与开发;16种机器人具身化形态,有不同品牌的机械臂、人形机器人、四足机器狗等——“也支持通过USD构建定制的机器人形态”;支持刚性、可变形体资产;以及目前支持摄像头、触觉传感器、接触传感器等超过5种传感器,“未来会有更多API开放,去适配对应的框架”。

基于OpenUSD创建场景、机器人等,然后进行仿真,本身不就是个小型元宇宙么……对各种强化学习框架的支持、两种任务函数设计方式、多卡多机可扩展支持,以及如何从以前的Isaac Gym迁移到Isaac Lab等本文就不多赘述了,有兴趣的开发者可以关注Isaac Lab的开发文档。

不过有个细节值得一提:上个月NVIDIA发布了Cosmos tokenizer(图像和视频数据的tokenizer,也就是将视觉数据token化;可应用于图片和视频生成,及为开发多模态生成式AI模型整合数据)。1X作为一家开发人形机器人的企业,很快基于Cosmos tokenizer尝试生成更多机器人操作的视频数据,构建机器人视频数据集。

Lia将Cosmos形容为“帮助构建world model的video tokenizer”。不管NVIDIA宣传Cosmos本身视觉重建能力多强,感觉从开发者的角度,这件事是能够真正管中窥豹地显现“虚拟”和“仿真”世界,于机器人开发的重要性的。这可能就是当代机器人开发的思路与标准范式了。

“我们建议所有机器人开发都可以从仿真开始,成本低、门槛低、易上手、出成果快。”NVIDIA工程师表示,“用我们的Jetson验证也比较便宜。”“AI大模型的部分,我们也开源了很多资源。基于开源的模型和我们对接,成本也是可控的。”

生态与合作:起步阶段

ROSCon China现场的绝大部分参展企业展位上都挂着“NVIDIA Partner”的绿色牌子:不少是直接推机器人产品——采用Jetson Orin;也有像沥拓科技这样基于Jetson做板卡套装、系统级解决方案的;

甚至我们还看到米文动力这样,既做基于Jetson的汽车、机器人计算机,而且还面向开发者自己开发了Autoware on Jetson软件环境的市场角色…;参与活动的也包括从事模型训练的互联网企业,以及“和我们一起做仿真工作的,像是上海AI Lab”…

所以NVIDIA展位工程师才说,“这应该是目前国内开发者最活跃的生态了。高校和第三方合作伙伴建立的讨论社区也特别火爆。”

但另一方面,从现场展示的绝大部分机器人主要着眼于高校客户和科研应用,行业应用较少这一现状来看,新时代的机器人现在都还处在发展的起步阶段。观众看到现场机器人最常问的问题是:“这个机器人是做什么用的?”

从这个角度来看,我们倒是认为NVIDIA机器人开发生态可能也更适配没有赶上上一波机器人发展热潮,但在AI+仿真时代或许大有可为的中国市场。

“不同区域的机器人发展情况是有差异的。”工程师在采访中说道,“一些西方国家专注在机器人自主化方面,但不是完全的自主化”;是“针对其现有解决方案”和“原本传统机器人”的;“所以开发成果能快速走向生产”。

“中国现在有大量机器人初创企业。或许等市场走向成熟,并不是每家企业都能成功。”但随着行业发展,“市场会走向分工,为机器人打造不同的组成部分。”“会有企业去造制动器、传感器及各部分组件;也会有企业去做大型基础模型;”“接着就有机会去构建专用解决方案,然后就能用现成(off-the-shelf)的组件去解决问题”。

“像这么年轻的生态,技术会在发展过程中得到传播。”“我们或许还不必太过在意今天现场的某个机器人产品究竟有什么用,因为现在还处在开发者平台构建阶段。等到未来有了正确的技术栈,自然会有面向不同行业特定用途的机器人产品。”

“现阶段我在中国看到的,更多的是为未来应用做前沿研究”,像“专注在更未来向的通用基础模型上”,“技术发展总是从这样的通用平台开始的”。在NVIDIA看来,中国的机器人生态迭代速度相当快,“从7月份而现在(12月),我们看到的成果就已经相当令人惊叹,迭代周期真的很快。”

“是仿真技术,让我们能够发展得这么快。”“对机器人、各组件、环境建模,做到无论我们训练什么样的策略,其输出都能用到机器人身上,弥合sim-to-real的间隙。”“随着时间推移,我想我们会有更好的管线、更好的平台。一旦我们在仿真、策略学习框架、硬件上有了更成熟的生态系统,我们就会看到机器人的高速发展。”