当前,生成式AI(Generative AI)正以史无前例的速度快速发展,不但成长速度可以与手机、互联网相类比,而且动辄10亿甚至百亿的参数规模也导致AI算力需求激增。数据显示,2015年全球产生的数据量约为10EB,预计到2025年,这一数字将会增加到175ZB,2035年更是会增加到2432ZB。

“显然,把所有的数据放到云端进行处理是不现实的。”炬芯科技股份有限公司董事长兼CEO周正宇博士指出,为了实现AI的普及和发掘其全部潜力,AI计算必须合理分配在云端服务器和端侧装置(如PC、手机、汽车、IoT装置)之间,而不是让云端承载所有的AI负荷。

这种云端和端侧AI协同作战的架构也被称之为混合AI(Hybrid AI),业界普遍认为这将提供更强大、更有效和更优化的AI体验。换句话说,要让AI真正触手可及,深入日常生活中的各种场景,离不开端侧AI的落地。

但在这一过程中,端侧AI也同时面临两大挑战:一是性能、功耗和成本之间的平衡,在提高算力的同时,如何在合理功耗和成本下达到最佳效果,特别是在电池驱动低功耗设备上的应用挑战巨大;二是生态系统的构建,类似于CPU、GPU的发展,需要形成统一的生态,包括工具链、语言、通用性以及开发便利性,以促进AI技术的普及和规模化应用。

端侧AI落地的魅力

端侧AI将机器学习带入每一个IoT设备,减少对云端算力的依赖,可在无网络连接或者网络拥挤的情况下提供低延迟AI体验,还具备低功耗、高数据隐私性和个性化等显著优势,是端侧AI落地带来的首要优势。

周正宇博士表示,在从端侧AI到生成式AI的广泛应用中,不同的AI应用对算力资源需求差异显著,而许多端侧AI应用是专项应用, 并不需要大模型和大算力。尤其是在以语音交互、音频处理、预测性维护、健康监测等为代表的AIoT领域,因此端侧AI是实现人工智能无处不在的关键,而为电池驱动的低功耗IoT装置赋能AI又是让端侧AI变为现实的关键。

根据ABI Research预测,端侧AI市场正在快速增长,预计到2028年,基于中小型模型的端侧AI设备将达到40亿台,年复合增长率为32%。到2030年,预计75%的这类AIoT设备将采用高能效比的专用硬件。

以市场主流的可穿戴产品(耳机和手表)和其他便携式音频产品(蓝牙音箱等)为例,其平均功耗在十几毫瓦-几十毫瓦之间,存储空间在10MB以下,这就框定了低功耗端侧AI,尤其是可穿戴设备的资源预算。

为此,该公司最新提出了针对电池驱动的端侧AI落地的“Actions Intelligence”战略,意在聚焦模型规模一千万参数(10M)以下的电池驱动型低功耗音频端侧AI应用,致力于为10mW-100mW之间功耗预算下的低功耗AIoT装置,提供0.1-1TOPS的通用AI算力。

这意味着,作为一家致力于在毫瓦级功耗下实现TOPS级别的AI算力,以满足IoT设备对低功耗、高能效需求的公司,“Actions Intelligence”将挑战目标10TOPS/W-100TOPS/W的AI算力能效比。

突破冯•诺依曼架构瓶颈

现有的通用CPU和DSP解决方案虽然有非常好的算法弹性,但是算力和能效远远达不成以上目标,本质原因均源于传统的冯•诺依曼计算系统所采用的存储和运算分离的架构,导致产生“存储墙”与“功耗墙”瓶颈,严重制约系统算力和能效的提升。

所谓“存储墙”,是指在冯•诺伊曼架构中,计算单元要先从内存中读取数据,计算完成后,再存回内存。但处理器和存储器二者之间的工艺、封装、需求不同,存储器数据访问速度跟不上处理器的数据处理速度,数据传输就像处在一个巨大的漏斗之中,不管处理器灌进去多少,存储器都只能“细水长流”。两者之间数据交换通路狭窄以及由此引发的高能耗两大难题,在存储与运算之间筑起了一道“存储墙”。

此外,在传统架构下,数据从内存单元传输到计算单元需要的功耗是计算本身的许多倍,因此真正用于计算的能耗和时间占比很低,数据在存储器与处理器之间的频繁迁移带来严重的传输功耗问题,称为“功耗墙”。例如英特尔的7纳米CPU经过测试,大概有63%的功耗被消耗在数据搬运,而不是计算上。

Arm和Cadence的公开资料也显示,同样使用28/22nm工艺,ARM A7 CPU 运行频率1.2GHz时可获取0.01TOPS的理论算力,需要耗电100mW,即理想情况下的能效比仅为0.1TOPS/W;HiFi4 DSP运行600MHz时可获取0.01TOPS的理论算力,需要耗电40mW,即理想情况下的能效比0.25TOPS/W。即便专用神经网路加速器(NPU)的IP ARM周易能效比大幅提升,但也仅为2TOPS/W。

“弱化或消除‘存储墙’及‘功耗墙’问题的最佳方案,是采用基于静态随机存取存储器(SRAM)的存内计算(Computing-in-Memory, CIM)结构。”周正宇博士进一步解释说,CIM的核心思想是将部分或全部的计算移到存储中,让存储单元具有计算能力,数据不需要单独的运算部件来完成计算,而是在存储单元中完成存储和计算,消除了数据访存延迟和功耗,是一种真正意义上的存储与计算融合。同时,由于计算完全依赖于存储,因此可以开发更细粒度的并行性,大幅提升性能尤其是能效比。

不过,“存算一体”理念具体实现起来的难度是比较大的,幸运的是AI在本质上是一个神经网络,由无数神经元计算组合成复杂计算模式。而机器学习的算法基础是大量的矩阵运算,适合分布式并行处理的运算,存内计算非常适用于人工智能应用。

知易,行也易

“端侧AI,一定要走创新性的道路”。

要在存储上做计算,存储介质的选择是成功成本关键。按照周正宇博士的说法,炬芯的目标是将低功耗端侧AI的计算能力和其他SoC的模块集成于一颗芯片中,因此无法使用特殊工艺的DDR RAM和Flash。相比之下,采用CMOS工艺的SRAM和新兴的非易失性随机访问存储器(NVRAM),例如忆阻器(RRAM)或者磁性随机存储器(MRAM)会更加合适。

SRAM工艺非常成熟,且可以伴随着先进工艺升级同步升级,读写速度快、能效比高,并可以无限多次读写。唯一缺陷是存储密度较低,但对于绝大多数端侧AI的算力需求,该缺陷不会成为阻力。短期内,SRAM是在低功耗端侧AI设备上打造高能效比的最佳技术路径,且可以快速落地,没有量产风险。

长期来看,新兴NVRAM 如RRAM由于密度高于SRAM,读功耗低,也可以集成入SoC,给存内计算架构提供了想象空间。但是RRAM工艺尚不成熟,大规模量产依然有一定风险,制程最先进只能到22nm,且存在写次数有限的致命伤(超过会永久性损坏)。故周正宇博士预期未来当RRAM技术成熟以后,SRAM 跟RRAM的混合技术有机会成为最佳技术路径,需要经常写的AI计算可以基于SRAM的CIM实现,不经常或者有限次数写的AI计算由RRAM的CIM实现,基于这种混合技术有望实现更大算力和更高的能效比。

目前,业界公开的基于SRAM的CIM电路有两种主流的实现方法,一是在SRAM尽量近的地方用数字电路实现计算功能, 由于计算单元并未真正进入SRAM阵列,本质上这只能算是近存技术。另一种思路是在SRAM介质里面利用一些模拟器件的特性进行模拟计算,这种技术路径虽然实现了真实的CIM,但缺点也很明显。一方面模拟计算的精度有损失,一致性和可量产性完全无法保证,同一颗芯片在不同的时间不同的环境下无法确保同样的输出结果。另一方面它又必须基于ADC和DAC来完成基于模拟计算的CIM和其他数字模块之间的信息交互,整体数据流安排以及界面交互设计限制多,不容易提升运行效率。

炬芯科技创新性的采用了基于模数混合电路的SRAM存内计算(Mixed-Mode SRAM based CIM,MMSCIM)的技术路径。即在SRAM介质内用客制化的模拟设计实现数字计算电路,既实现了真正的CIM,又保证了计算精度和量产一致性。

周正宇博士认为,MMSCIM具有以下几点显著的优势:第一,比纯数字实现的能效比更高,并几乎等同于纯模拟实现的能效比;第二,无需ADC/DAC, 数字实现的精度,高可靠性和量产一致性,这是数字化天生的优势;第三,易于工艺升级和不同FAB间的设计转换;第四,容易提升速度,进行性能/功耗/面积(PPA)的优化;第五,自适应稀疏矩阵,进一步节省功耗,提升能效比。

而对于高质量的音频处理和语音应用,MMSCIM是最佳的未来低功耗端侧AI音频技术架构。由于减少了在内存和存储之间数据传输的需求,它可以大幅降低延迟,显著提升性能,有效减少功耗和热量产生。对于要在追求极致能效比电池供电IoT设备上赋能AI,在每毫瓦下打造尽可能多的AI算力,炬芯科技采用的MMSCIM技术是真正实现端侧AI落地的最佳解决方案。

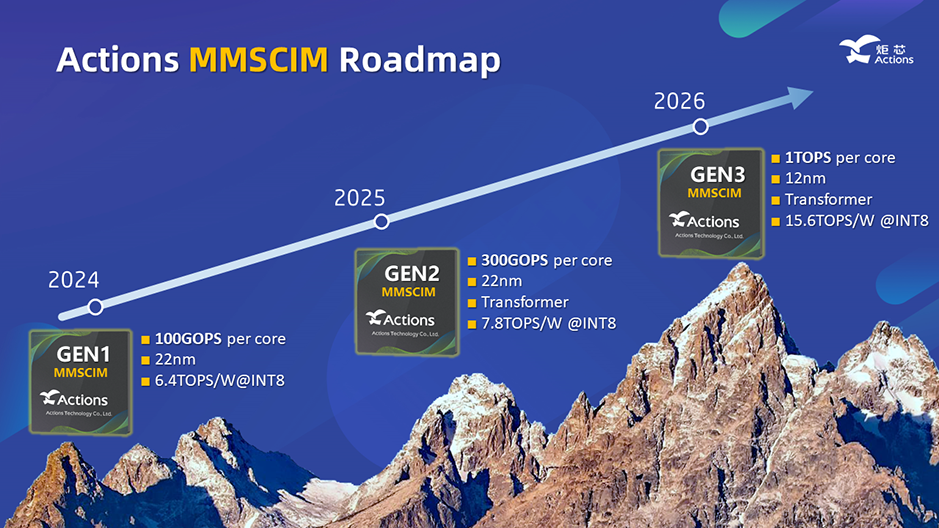

根据首次公布的炬芯科技MMSCIM路线规划,炬芯第一代GEN1 MMSCIM已经在2024年落地,GEN1 MMSCIM采用22纳米制程,每一个核可以提供100GOPS的算力,能效比高达6.4TOPS/W @INT8。受益于其对于稀疏矩阵的自适应性,如果有合理稀疏性的模型(即一定比例参数为零时),能效比将进一步得到提升,依稀疏性的程度能效比可达成甚至超过10TOPS/W。

接下来,到2025年,炬芯科技将推出第二代GEN2 MMSCIM,采用22纳米制程,性能将相较第一代提高三倍,每个核提供300GOPS算力,直接支持Transformer模型,能效比也提高到7.8TOPS/W @INT8。到2026年,推出新制程12纳米的第三代GEN3 MMSCIM,每个核达到1TOPS的高算力,支持Transformer,能效比进一步提升至15.6TOPS/W @INT8。

以上每一代MMSCIM技术均可以通过多核叠加的方式来提升总算力,比如MMSCIM GEN2单核是300GOPS算力,可以通过四个核组合来达到高于1TOPS的算力。

新一代端侧AI音频芯片有多强?

炬芯科技全新一代基于MMSCIM端侧AI音频芯片共三个系列:面向低延迟私有无线音频领域的ATS323X系列;面向蓝牙AI音频领域的ATS286X;以及面向AI DSP领域ATS362X系列。

三个系列芯片均采用了CPU(ARM)+ DSP(HiFi5)+ NPU(MMSCIM)三核异构的设计架构,炬芯的研发人员将MMSCIM和先进的HiFi5 DSP融合设计形成了炬芯科技“Actions Intelligence NPU(AI-NPU)”架构,并通过协同计算,形成一个既高弹性又高能效比的NPU架构。在这种AI-NPU架构中MMSCIM支持基础性通用AI算子,提供低功耗大算力。同时,由于AI新模型新算子的不断涌现,MMSCIM没覆盖的新兴特殊算子则由HiFi5 DSP来予以补充。

以上全部系列的端侧AI芯片,均可支持片上1百万参数以内的AI模型,且可以通过片外PSRAM扩展到支持最大8百万参数的AI模型,同时炬芯科技为AI-NPU打造了专用AI开发工具“ANDT”,该工具支持业内标准的AI开发流程如Tensorflow,HDF5,Pytorch和Onnx。同时它可自动将给定AI算法合理拆分给CIM和HiFi5 DSP去执行。ANDT是打造炬芯低功耗端侧音频AI生态的重要武器。借助炬芯ANDT工具链轻松实现算法的融合,帮助开发者迅速地完成产品落地。

根据周正宇博士公布的第一代MMSCIM和HiFi5 DSP能效比实测结果的对比显示:当炬芯科技GEN1 MMSCIM与HiFi5 DSP均以500MHz运行同样717K参数的Convolutional Neural Network(CNN)网路模型进行环境降噪时,MMSCIM相较于HiFi5 DSP可降低近98%功耗,能效比提升达44倍。而在测试使用935K参数的CNN网路模型进行语音识别时,MMSCIM相较于HiFi5 DSP可降低93%功耗,能效比提升14倍。

另外,在测试使用更复杂的网路模型进行环境降噪时,运行Deep Recurrent Neural Network模型时,相较于HiFi5 DSP可降低89%功耗;运行Convolutional Recurrent Neural Network模型时,相较于HiFi5 DSP可降低88%功耗;运算Convolutional Deep Recurrent Neural Network模型时,相较于HiFi5 DSP可降低76%功耗。最后,相同条件下在运算某CNN-Con2D算子模型时,GEN1 MMSCIM的实测AI算力可比HiFi5 DSP的实测算力高16.1倍。

打造高品质音频之路

声音的处理是一个复杂的系统性工程,高品质音质不仅需要由前置放大器、ADC/DAC、音频处理、编解码器、模拟放大器组成出色的硬件信号链,更是需要每一个环节都能实现高信噪比、低底噪、高动态范围、高线性度等各种客观可量化指标,还须对人类对声音的主观喜好具备一定的经验和理解,并将电学和声学有机融合于产品设计之中。

“的确是这样,尤其是在主观部分,悦耳的声音没有统一标准,每个人都有自己的偏好,每个品牌也都有自己的风格。”周正宇博士说炬芯深耕音频行业20余年,之所以能在主客观标准上达到国际一线品牌的认可,源于“拥有深厚的积累和经验传承”,更加懂得什么是自然、干净、清晰悦耳的音色并加以调节,能够将芯片、算法和声腔有机结合在一起协同工作。

另一个值得关注的现象,是随着AI技术的飞速发展,AI与音频的融合正催生出无限可能性——语音识别、噪音抑制、语音翻译、语音关键词识别、人声增强、人声分离等都是AI模型在音频领域的应用场景。AI的发展也同时为音频设备和系统带来了许多创新和改进,无论是在家庭娱乐、个人音乐欣赏还是商业应用中,更加丰富、个性化的用户体验正成为消费者追逐的新趋势。

周正宇博士认为,AI是一种新型的计算,它在音频领域利用基于神经网络的深度学习计算替代了传统的符号逻辑计算,极大地提升用户体验。“在我看来,其实所有的音频产品都值得用AI重做一遍,尤其是搭配专用的低功耗、高效率硬件,模型效率可以提升几十倍。”他说。

当前市场上,无线家庭影院音响、无线电竞耳机和无线麦克风,是低延迟高品质音频产品的主要市场。周正宇博士预测称,未来,这些领域将出现更多细分市场,例如更加专业的直播麦克风等无线化设备,对低延迟有更高要求;强调三维沉浸式体验的7.1.4声道及12声道环形音响,对无线传输的带宽、采样率及延迟提出挑战,这将带动市场对高带宽私有无线技术、AI降噪、以及新型编解码技术的强烈需求,以应对超低延迟、高音质需求。

根据QYResearch的统计及预测,2023年,包括条形音箱、耳机和麦克风、无线扬声器系统在内的全球无线音频设备市场规模达到了1996.28亿元人民币,其中中国市场规模为654.38亿元人民币。预计到2029年,这一数字将达到5820.85亿元人民币,年复合增长率约为19.25%,商业、汽车、消费者和家庭是主要的终端市场。

以智能耳机、智能手表或手环等产品为主的可穿戴设备市场同样值得关注。根据IDC的预测,2024年全球可穿戴设备出货量将同比增长6.1%,达到5.379亿台,耳戴设备出货量占比就高达57.7%。Canalys公布的数据则显示,2024年第二季度,全球个人智能音频市场总出货量达到1.1亿部,同比增长10.6%,成为历史上出货量最高的第二季度。这其中,TWS耳机是增长主力。2024年第二季度,TWS耳机的年增长率达到12.6%,出货量为7700万部,市场份额占比为72.6%。

显然,在这一背景下,AI技术的探索与应用会成为跨行业热门话题,未来科技在提高用户体验方面也有着巨大潜力。对企业而言,从单一产品供应商转向系统解决方案供应商将成为新常态,他们越来越需要通过开放平台和工具,让客户能够基于基础组件进行差异化开发,在注重性能、成本和功耗平衡的同时,构建起独特的AI生态系统。

结语

从ChatGPT到Sora,从文生文、文生图、文生视频,到图生文、视频生文,各种不同的云端大模型不断刷新人们对AI的预期。然而,AI发展之路依然漫长,从云到端将会是一个新的发展趋势,凭借低延迟、个性服务和数据隐私保护等优势,端侧AI在IoT设备中将扮演越来越重要的角色,在制造、汽车、消费品等多个行业中展现更多可能性。