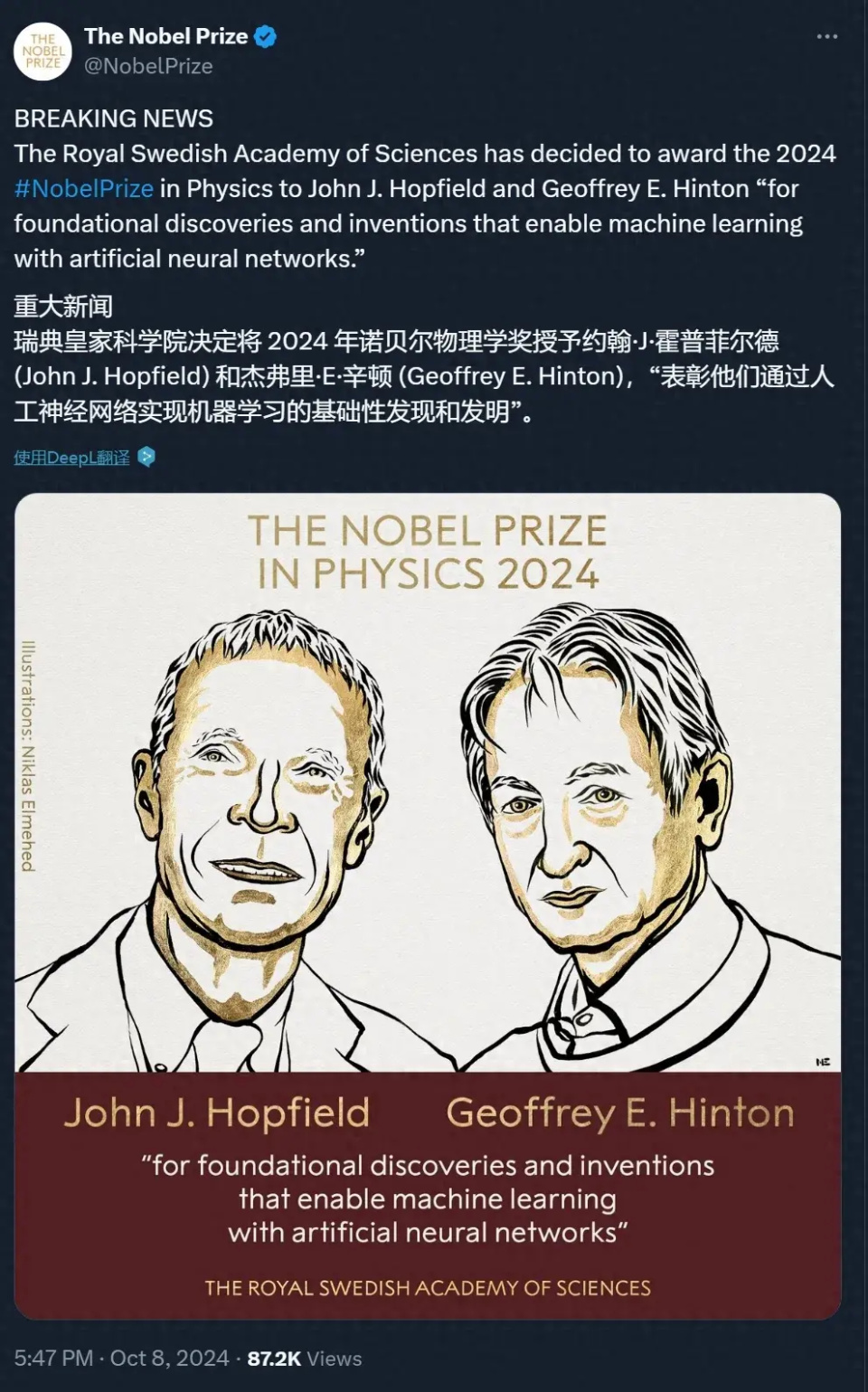

当地时间10月8日,瑞典皇家科学院宣布,将2024年诺贝尔物理学奖授予John J. Hopfield和Geoffrey E. Hinton,以表彰他们“为利用人工神经网络进行机器学习做出的基础性发现和发明”。

诺贝尔奖评奖委员会表示:机器学习长期以来一直对科学研究至关重要,包括对大量数据的分类和分析……John Hopfield 和 Geoffrey Hinton 利用物理学工具,构建了有助于为当今强大的机器学习奠定基础的方法。基于人工神经网络的机器学习目前正在彻底改变科学、工程和日常生活。

John Joseph Hopfield的贡献

约翰・约瑟夫・霍普菲尔德(John Joseph Hopfield)1933年出生于美国伊利诺伊州芝加哥,1958年在康奈尔大学获得物理学博士学位,是一位美国物理学家,活跃于生物物理学和统计物理学领域。他的研究兴趣跨越了多个领域,从物理化学到分子生物学,最终转向了神经网络的研究。

霍普菲尔德最为人所知的成就是他于1982年提出的Hopfield神经网络模型。这种模型是一种能够存储和重构图像或其他类型数据模式的联想记忆网络。霍普菲尔德利用物理学中的自旋系统能量的概念,通过寻找节点之间连接的值来进行训练,使得保存的图像具有较低的能量。当网络接收到不完整或扭曲的图像时,它会逐步更新节点的值,从而找到最接近输入图像的保存图像。

霍普菲尔德的这一发现为递归神经网络的发展铺平了道路,并对解决优化问题产生了深远的影响。

霍普菲尔德的神经网络模型开启了人们对大脑计算过程的研究,推动了计算神经科学的发展。他的神经理论解释了大规模处理如何在存储网络中实现稳定的记忆,启发了后来的深度学习研究。

Geoffrey Hinton的贡献

Geoffrey Hinton 1947年出生于英国伦敦,1978年在爱丁堡大学获得人工智能博士学位。Hinton是深度学习领域的先驱之一,被誉为“AI教父”。

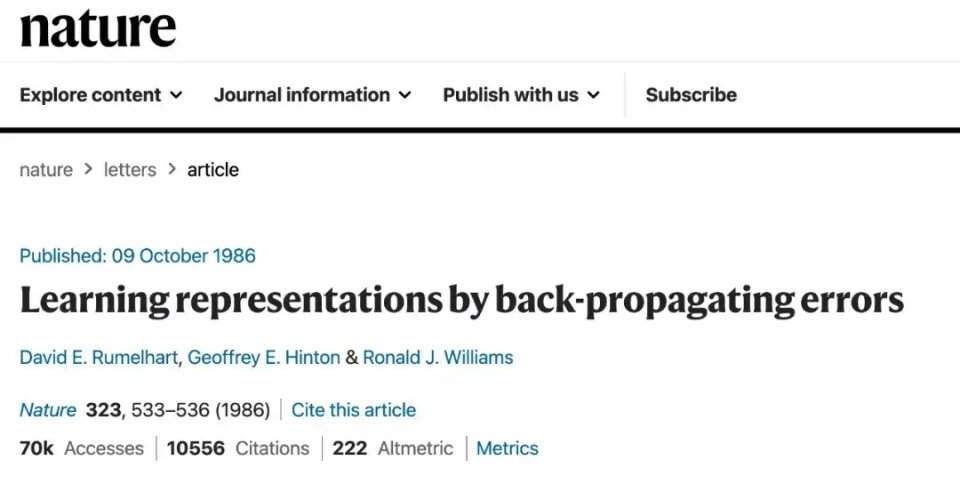

他在1986年与David Rumelhart和Ronald J. Williams共同发表的论文中,介绍了用于训练多层神经网络的反向传播算法,这一算法使得网络可以学习有用的内部数据表示。

论文链接:https://www.nature.com/articles/323533a0

此外,辛顿还发明了玻尔兹曼机,这是一种在霍普菲尔德神经网络基础上发展而来的随机递归神经网络,可以学习识别给定类型数据中的特征元素,用于图像分类或生成新材料。

2012年,辛顿和他的学生Alex Krizhevsky、Ilya Sutskever设计的卷积神经网络AlexNet在ImageNet挑战赛中取得了重大突破,将视觉识别错误率降至15.3%,开启了深度学习的新纪元。

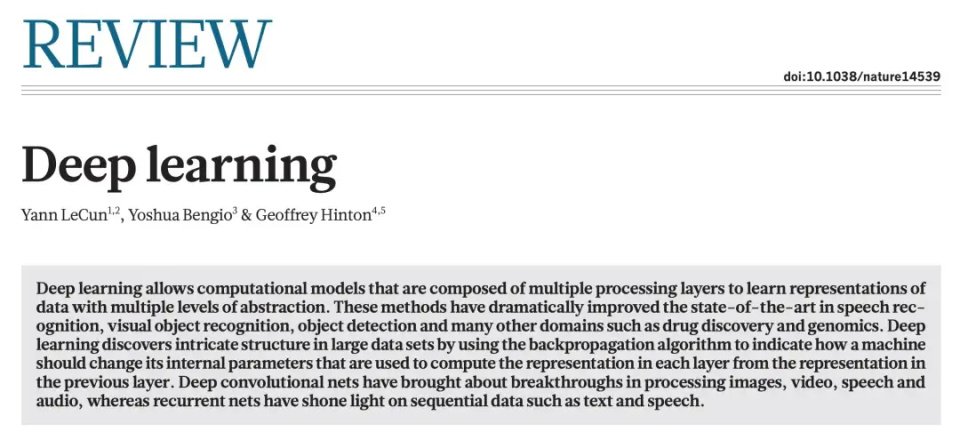

2015 年,为了纪念人工智能 60 周年,深度学习三巨头 Yann LeCun、Yoshua Bengio、Geoffrey Hinton 在 Nature 上发表了综述论文《Deep learning》:

论文链接:https://www.cs.toronto.edu/~hinton/absps/NatureDeepReview.pdf

卷积神经网络获得了巨大的成功,但也并不适合所有的任务。

2017 年 10 月和 11 月,Hinton 发表了两篇关于胶囊神经网络主题的研究论文,提出了胶囊网络 (CapsNet) 作为 CNN 模型的替代。胶囊是深度学习的新概念,与 CNN 和传统的网络神经网络相比,它产生了不错的效果。CNN 分类器在对抗干扰数据时并不稳健,而胶囊网络被证明对不良数据的适应力更强,而且还能适应输入数据的仿射变换。

2018 年,Hinton 与 Yann LeCun 和 Yoshua Bengio 一起获得了 2018 年图灵奖,以表彰他们使深度神经网络成为计算的关键组成部分的概念和工程突破。

在几十年的研究生涯中,Hinton 称得上「桃李满天下」。他曾培养的知名学者包括:Peter Dayan、Sam Roweis、Richard Zemel、Brendan Frey、Radford M. Neal、Ruslan Salakhutdinov、Ilya Sutskever、Yann LeCun 和 Zoubin Ghahramani。