如今,对AI技术进行监管已经成为全球各国的共识。然而,美国加州州长加文・纽森(Gavin Newsom)在9月30日否决了具有争议的《前沿人工智能模型安全创新法案》(简称SB 1047)。该法案要求大型前沿AI模型的开发者采取预防措施,例如部署前测试、模拟黑客攻击等。

据悉,加文・纽森在否决声明中提到了多个影响他作出该决定的因素,包括该法案可能对AI公司造成的负担、加州在AI领域的主导地位以及对法案可能过于宽泛的担忧。在否决该法案过程中,AI界泰斗吴恩达、图灵奖获得者Yann LeCun、斯坦福教授李飞飞等发挥了重要作用。尤其是吴恩达曾多次在公开场合呼吁科技人士抵制该法案。

加文・纽森表示,SB 1047存在一刀切的现象,将会抑制在某些领域的创新和AI技术的发展。而这一法案的否决让全球开发者可以继续使用美国加州众多科技巨头的开源AI大模型,否则将扼杀美国硅谷的AI科技创新。

“SB 1047”法案是什么?

毫无疑问,AI技术在提高生产效率、改善生活质量、推动科技进步和促进经济发展等方面正展现出广阔的发展前景,但因AI技术存在数据泄露、技术滥用甚至危及国家经济安全的可能性,使得这一技术必须在一定的法律框架运行。

目前,美国加州的人工智能技术和产业在全球范围内都具有强大的发展实力。根据2023年人工智能指数报告,加州以17.9%的比例位居全美第一,其次是德克萨斯州和纽约州。同时,根据《The AI Index Report 2023》,加州在2022年通过了5项与人工智能相关的立法,位居美国各州之首。

而且,加州拥有众多世界领先的AI大学,如斯坦福大学、加州理工学院、伯克利大学等,这些学术机构为加州提供了强大的技术支持和人才储备。加州也是Meta、谷歌、微软等科技巨头的所在地,这些公司推动了加州在全球AI领域的领先地位。

因此,美国加州在人工智能(AI)领域的发展一直备受关注,尤其是在监管和创新之间的平衡问题上。

2024年2月7日,美国加州拟定了全名叫《SB-1047 前沿AI大模型安全创新法案》,旨在为大型人工智能模型的安全性和透明度制定标准。

该法案的主要内容包括要求开发强大AI模型的公司采取预防措施,如部署前测试、模拟黑客攻击、安装网络安全保障等,以确保技术不会造成严重伤害。此外,法案还要求开发者提供数据和信息用于评估,并对AI系统的结构、能力和局限性进行披露。

具体而言,该法案为训练成本超过1亿美元或者达到一定算力的开发者制定了安全标准,以确保这些大型前沿人工智能模型的安全开发。

其次,法案要求开发者在未获得积极的安全决定时,必须为人工智能模型实现关机功能,以防止潜在的安全风险。

此外,法案还强调了数据影响评估的重要性,旨在了解并解决与AI技术相关的潜在问题。法案试图建立针对高风险AI模型的安全标准,以防止这些模型可能引发的灾难性事件,例如造成人员伤亡或导致超过5亿美元的损失。

该法案于8月28日在加州州议会获得通过,并提交给州长加文・纽森签署。然而,尽管该法案在立法机构中获得了通过,但加文・纽森最终否决了这项法案。他认为,该法案虽然出于“好意”,但可能对加州的AI生态系统产生不利影响。

有争议的AI监管法案

加文・纽森最终否决SB 1047,意味着这个被视为美国乃至全球首个专门针对AI模型安全性和透明度的法律框架并未成为正式法律。不过,归根结底是这项法案确实存在诸多争议的地方。

该法案有非常多的不合理内容,比如规定开发、训练成本超过1亿美元的大模型,比如Meta开源的Llama-3系列;谷歌的Gemma系列,一旦开源有人使用它做一些非法的事情,那么源开发商也会受到非常严重的处罚。

而在监管方面,该法案要求,当大公司开放其模型给别的国家用户使用时,需要提交客户的所有资料,包括客户的身份、信用卡号、账号、客户标识符、交易标识符、电子邮件、电话号码。同时,每年都要提交一次资料,并对用户的行为、意图进行评估。用户的所有资料会被备份7年,也会在海关、边境总署备案。这将对使用开源AI大模型的国外AI企业带来数据安全风险。

当然,该法案还有很多类似不合理的条款,比如监管范围和适用性方面。该法案主要针对训练成本高昂或达到一定算力阈值的AI模型,而较小的模型则不受监管。这导致了一些批评者认为法案过于宽泛,未能全面覆盖所有潜在风险。

加文・纽森对此表示,SB 1047可能会给公众一种控制这项快速发展技术的虚假安全感。而较小的、专业化的模型可能同样甚至比SB-1047针对的大模型更危险,会阻碍AI技术创新。

此外,该法案没有考虑到AI模型是否部署的环境因素。因为在低风险环境中可能不需要同样严格的监管措施。同时,法案没有明确哪些类型的决策是关键决策,也没有定义什么是敏感数据,这可能会导致在保护个人隐私和数据安全方面的不足。

科技界、企业界反对法案

OpenAI、Meta、谷歌等科技巨头普遍担心该法案将阻碍其AI技术在该州的发展,甚至认为起草该法案的人员就是想彻底扼杀开源大模型以及大模型出口。

OpenAI应该是对该法案最强烈反对意见的企业之一。在当地时间8月21日,OpenAI发布公开信,反对美国加州参议员提出的《安全可靠的前沿人工智能模型创新法案》草案,称草案可能“威胁加州未来增长、拖慢创新、赶走加州的世界级工程师和企业家”,并建议在联邦而非地方层面推出AI大模型监管法案。

OpenAI首席战略官Jason Kwon在在给牵头该法案的加州参议员Scott Wiener的信中写道,SB 1047法案威胁到了“加州作为人工智能全球领导者的独特地位”。

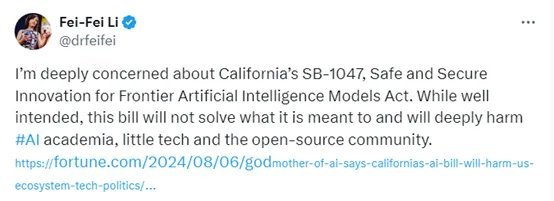

斯坦福大学的首位红杉讲席教授、被誉为“人工智能教母”的李飞飞也指出,SB-1047法案将对刚刚起步的人工智能生态系统造成伤害,它可能通过过度惩罚开发者,压制开源社区的发展,阻碍学术研究的进步,并且对于解决实际问题并无助益。

在美国科技界、企业界的反对声音下,加文・纽森也认为,美国加州在人工智能领域具有领先地位,需要谨慎处理该法案的影响。

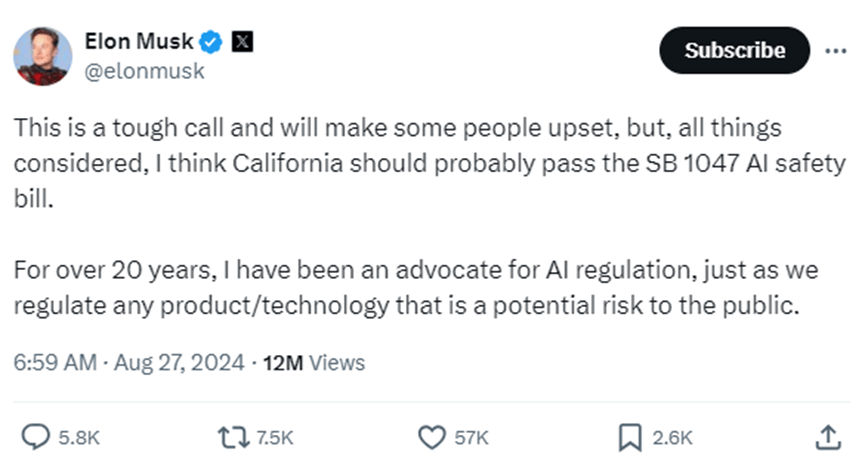

不过,对SB 1047法案的实施,美国也有一些支持的支持声音。马斯克近日在X平台上发帖表示,尽管这一呼吁可能令人为难并令一些人沮丧,但加州应该通过SB-1047法案。他声称,过去20年间,他一直致力于推动针对人工智能的立法,就像对其他技术领域进行监管一样。