西方哲学的传统经历了一场深刻的转型,其焦点从早期对物质世界的深入探索逐步转向了对心智与意识现象的细致剖析。这一哲学重心的迁移,恰好与人类历史上的技术跃迁相互呼应,尤其是步入第三次和第四次工业革命的时代,我们目睹了传统工业时代的力量象征——蒸汽与钢铁,逐渐让位于数字时代的双刃剑:算力与智能。这一进程被广泛誉为“算力与智能的革命”。

在由芯原与上海开放处理器产业创新中心联合主办的“智”由“芯”生——RISC-V和生成式AI论坛上,乌镇智库理事长张晓东分享中深入探究了大语言模型背后的发展原理,指出全球工业革命从前两次的能源驱动演进到当前的算力驱动。

ChatGPT的出现掀起了生成式人工智能热潮。然而,语言与思维之间的关系一直是哲学上的争议话题,尽管语言可能无法完全等同于思维,但其在表达和理解思维方面的作用不容小觑。张晓东表示:“图灵不仅是现代计算机科学的奠基人,他的理论更是智能语言的核心,正如费曼将微积分誉为上帝的语言,图灵机则被视为智能的语言。”

而大语言模型则主要基于四个基础原理。

图灵机的概念简洁而强大,通过一个“读、写”头在无限长的带上移动,执行写入“0”或“1”的操作,展示了计算的本质。这种看似简单的机制实际上涵盖了所有已知计算设备的功能,这便是所谓的原理1:丘奇-图灵论题——计算机科学的基石。张晓东表示:“芯片、算力的起点就是图灵机,我们现在已知的所有计算的装置都等价于图灵机。”

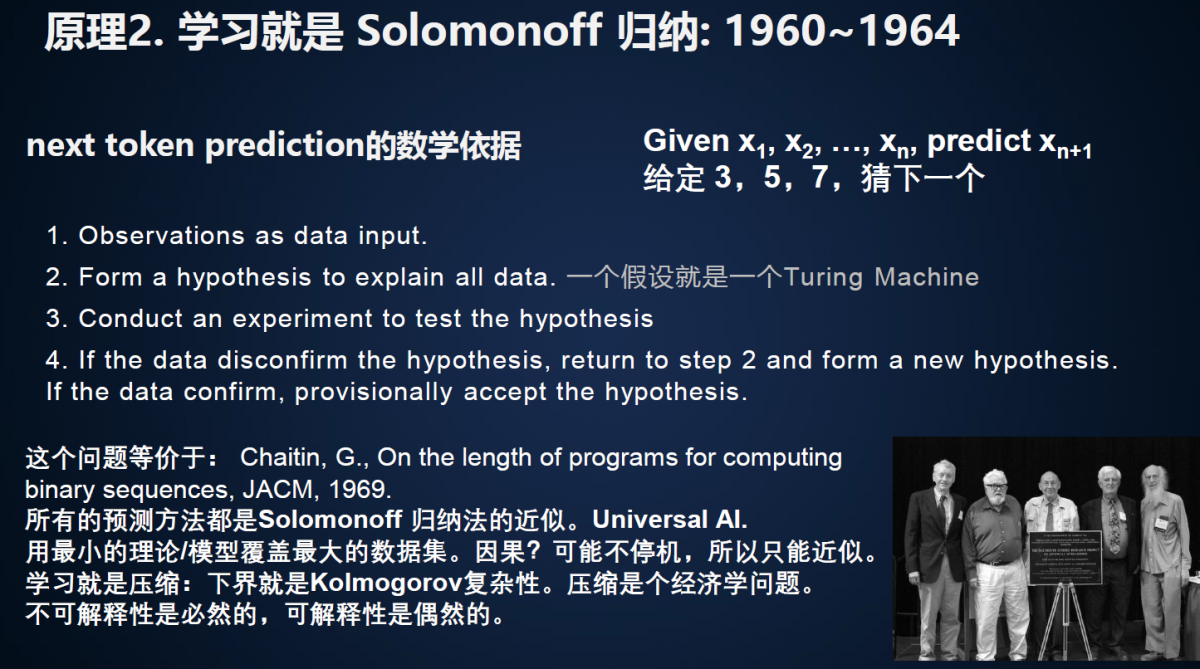

原理2则是“学习就是图灵机求逆”。

学习的本质,长久以来一直是哲学与心理学探讨的热点话题,不同学科从各自的视角出发,提出了多元化的见解,却往往难以达成共识。然而,当我们追溯到人工智能的起源点——1956年的达特茅斯会议,达特茅斯会议组织者之一John McCarthy写了一篇7页纸的文章,提出了一种新颖且深刻的观点,试图从数学角度界定学习的概念,他说:“学习就是图灵机的逆”。

具体而言,如果有一系列数据输入,学习的目标就是通过分析这些数据,推断出背后潜在的“图灵机”规则,即能够生成这些数据的算法或模型。这种将学习视为从结果回溯至原因的过程,实际上是在尝试重构数据生成的逻辑。

这一定义,虽然源于1954年,却意外地与现代大模型训练的理念相吻合。在机器学习中,我们提供大量的数据给算法,通过训练,算法(或称大模型)逐步逼近能够模拟或解释这些数据的内在规律,这正是对McCarthy定义的生动实践。

十年后的1964年,另一位参与过达特茅斯会议的数学家进一步深化了这一概念,他证明了所谓的图灵机求逆问题,实质上等同于预测序列中下一个元素(Next token Prediction)的能力。这意味着,一旦掌握了预测序列中任意位置下一个元素的方法,理论上就能解决所有与学习相关的计算难题,这是大语言模型训练的核心任务。

谷歌提出的Transformer模型及其衍生的BERT和GPT模型,展示了不同学习策略的效能。那BERT和GPT有和区别吗?张晓东表示:“BERT是双向的,即给出X 1到X N,然后将X 2拿掉,再猜出X 2。而GPT是给出X 1到X N,预测出X N+1。我发现,GPT相对来说是一个比较简单的机制。”

张晓东指出人工智能的发展经历了三种主要路线:人工智能的主要路线之一是逻辑主义,即从专家系统到知识图谱;之二是联结派,神经网络,深度学习;之三是从细胞自动机到强化学习。

他表示,自然语言处理的进步在过去七十年中发生了五次范式变迁,开源对于自然语言处理的进步至关重要。

原理3:“深度学习的充分性依据是Kolmogorov–Arnold叠加”

Robert Hecht-Nielsen(HNC 创始人)证明了三层以上神经网络可以无限逼近任意连续函数。而数学根据是Kolmogorov在1956年证明的Kolmogorov–Arnold表示定理,也称叠加定理或映射定理。

张晓东提到,近来,业界对于是否应当使用医疗数据来训练模型存在争议,但即便在不直接利用医疗数据的情况下,某些模型的表现已经超越了IBM的Watson等前辈系统。此外,AI设计AI的概念也正在成为现实,其中芯片设计是一个引人注目的应用方向。谷歌在2021年展示了一项成就,他们运用AlphaGo背后的强化学习技术,仅需6小时即可完成通常需数十人花费数月才能完成的电路布局设计。尽管有人质疑这一成果的宣传效果有所夸大,但不可否认的是,它揭示了AI在加速复杂任务处理方面的巨大潜力。

张晓东还提到了近期公众热议的话题之一“大型预训练模型(大模型)的未来走向”,他表示尤其是受到一个多月以来OpenAI一位年轻研究员撰写的一篇长达160页论文的影响。该论文大胆预测,在不远的将来,或许类似于2017年或2018年“Room”项目中的超智能机器,将配备多达一千万个高性能GPU(如H100),其能耗相当于中国一个中等省份的电力消耗,这一设想引发了诸多连锁思考。

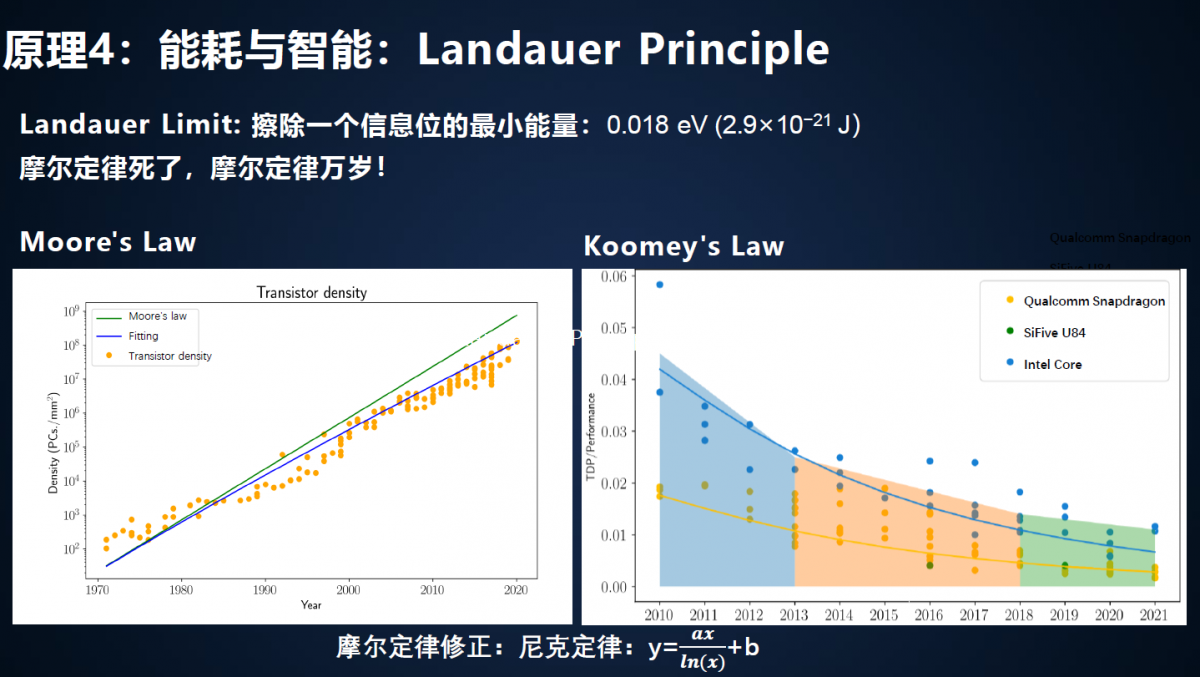

这正是大模型的发展引发的对未来计算资源分配和能耗的担忧,兰道尔原则(Landauer's Principle)指出,信息处理过程中的比特翻转需要消耗最小能量,这暗示了计算能力增长的物理极限。这也是张晓东给出的原理4:能耗与智能,Landauer Principle。

张晓东表示,从0变成1是需要能量的,他预计摩尔定律还能走到2100年以后,半导体行业至少还可以蓬勃发展80到100年。