许多人认为英伟达(NVIDIA)在AI系统的主导地位,仅仅是因为他们的GPU或软件。其实在AI和高性能计算(HPC)领域,连接技术才是实现计算加速器芯片之间高效通信的关键。

目前,NVIDIA拥有一系列用于跨多个GPU和系统扩展工作负载的技术,包括芯片间和封装间互连(D2D)、用于服务器或pod中GPU到GPU通信的NVLink、用于pod间扩展的InfiniBand,以及连接到更广泛基础设施的Ethernet。

其中NVLink技术在行业中占据着领导地位,其总线和通信协议广泛用于连接CPU与GPU,以及多个NVIDIA GPU之间的相互连接。

然而,这一局面可能即将改变。例如去年我们就看到了Ultra Ethernet,它使用增强的Ethernet来作为InfiniBand的替代方案。

UALink是什么?

近日,AMD、英特尔、谷歌、微软、博通、思科、Meta、惠普企业等八家科技巨头联合组建了一个新的行业联盟——UALink Promoter Group(简称UALink)。这一联盟的成立标志着这些科技巨头将共同推动AI加速器芯片之间连接组件的发展,直接对抗NVIDIA的NVLink技术。

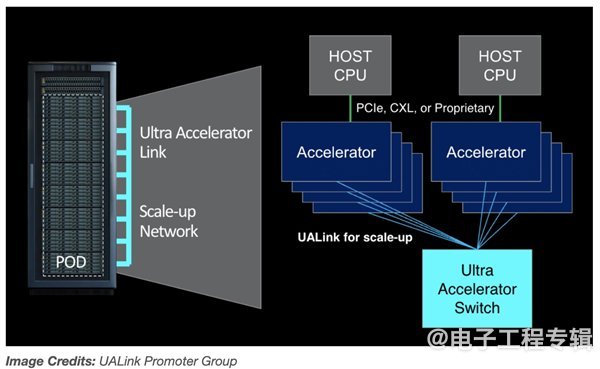

UALink,即Ultra Accelerator Link,是一项开放的行业标准,旨在连接数据中心内的AI加速器芯片,以满足日益增长的计算密集型工作负载的需求。

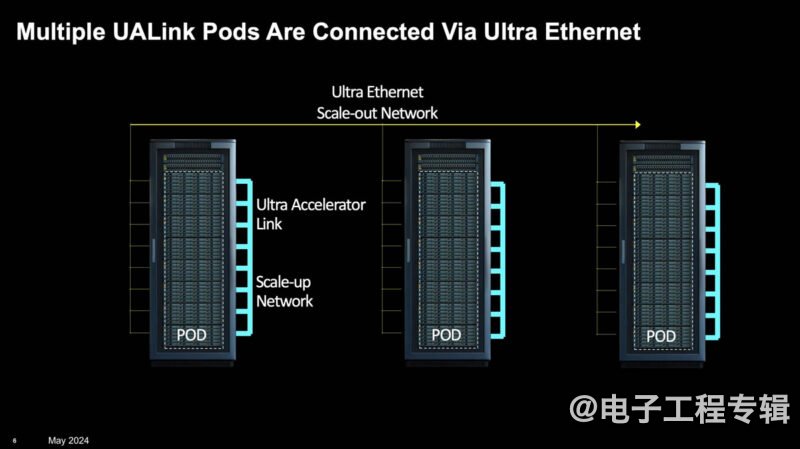

与NVLink不同,UALink的目标是提供一个可扩展的、高性能的连接解决方案,支持AI和HPC应用,并允许多达1024个GPU AI加速器的连接,组成一个计算“集群”(pod),意指服务器中的一个或多个机架。

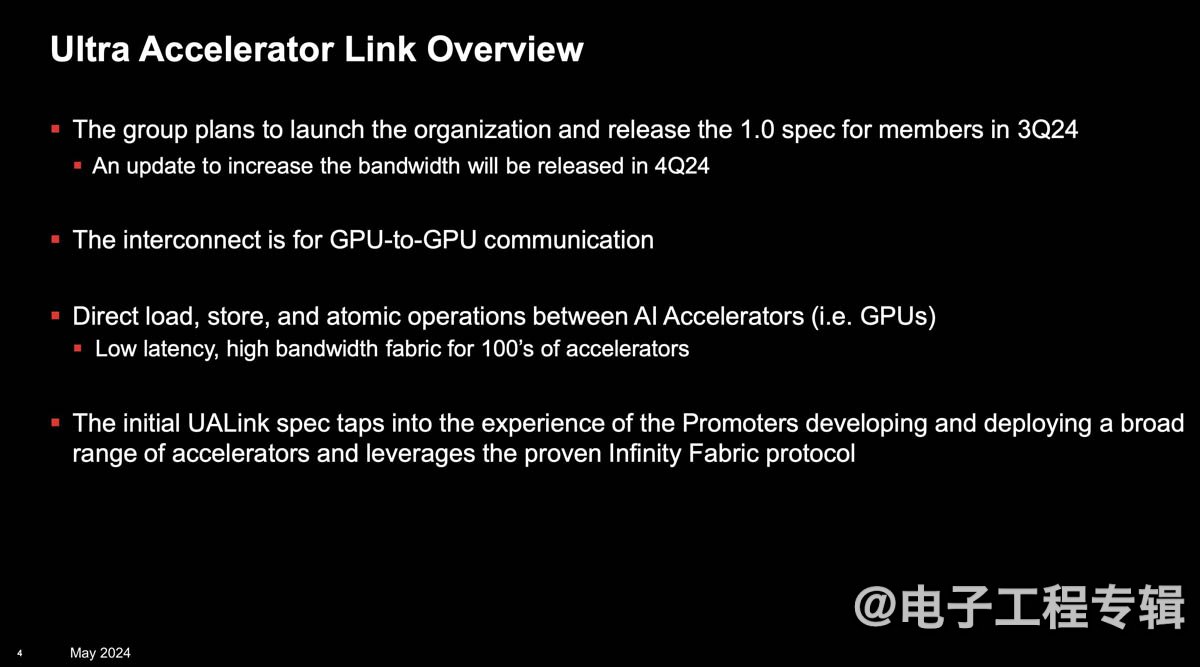

根据UALink推广组的说法,基于包括AMD的Infinity Fabric在内的“开放标准”,UALink 1.0将允许AI加速器所附带的内存之间的直接加载和存储,并且与现有互连规范相比,总体上将提高速度,同时降低数据传输延迟。

行业期待已久

UALink的推出受到了行业的广泛关注。

AMD数据中心解决方案总经理福雷斯特·诺罗德(Forrest Norrod)表示,行业需要一个能够快速推进的开放标准,允许多家公司为整个生态系统增值,而不受任何单一公司的束缚。他还谈到,第一批采用UALink技术的产品“将在未来几年内”上市。

这一技术不仅适用于大型企业,也为行业中的所有人提供了一个在规模和创新方面与NVIDIA竞争的机会。目前,博通公司已经开始使用AMD Infinity Fabric AFL生产UALink交换机。

UALink计划在今年第三季度成立一个官方行业联盟,并向加入该联盟的公司提供UALink 1.0技术。该技术将能够在单个集群中连接多达1024个AI加速器,通过将大量加速器连接在一起,共同完成大规模计算任务。

此外,该组织第四季度还将发布第一轮迭代版本UALink 1.1,提供更高的带宽。

其他行业大佬对UALink也发来贺电:

“博通很荣幸成为UALink联盟的创始成员之一,落实我们对提高大规模AI技术在数据中心的实现这一长期承诺。支持通过生态系统协作来实现具有各种高速低延迟解决方案的纵向扩展网络至关重要。”——博通副总裁兼数据中心解决方案部总经理Jas Tremblay

“随着AI工作负载的规模和范围不断增长,超高性能的互连变得越来越重要。我们共同携手,承诺将UALink建设成为一个可扩展的开放解决方案,帮助克服构建AI超级计算机时所面临的一些挑战。”——思科通用硬件部执行副总裁Martin Lund

“随着我们在超级计算领域进行创新以及对系统的访问量增加,开放标准对惠普十分重要。作为UALink行业联盟的创始成员之一,我们将贡献我们在高性能网络和系统领域的专长,与同行携手合作制定面向下一代超级计算的加速器互连的新开放标准。”——惠普(HPE)高级副总裁兼高性能计算和人工智能基础设施解决方案部总经理Trish Damkroger

“UALink是人工智能计算发展的一个重要里程碑。英特尔非常荣幸联合牵头这一新技术,贡献我们的专长以建立一个开放、富有活力的AI生态系统。作为这一新联盟的创始成员之一,我们期待通过UALink标准带来新一轮的行业创新,为客户创造价值。该倡议是英特尔对AI连接创新的承诺的延申,包括在超级以太网联盟(Ultra Ethernet Consortium)和其他标准机构承担领导角色。”——英特尔公司高级副总裁兼网络和边缘计算部总经理Sachin Katti

“在极端的时间内,科技行业用于面对AI和HPC解开的挑战。将GPU等加速器进行互连,需要采取全面的方法来提高效率和性能。在UEC,我们认为UALink通过纵向扩展来解决容器组集群问题的方法与我们自己的横向扩展协议形成互补,我们期待携手合作,共同建立可在未来同时满足这两种需求的,开放的、对生态系统友好的、全行业解决方案。”——超级以太网联盟主席J Metz博士

NVLink不好撼动啊

NVIDIA作为全球最大的AI加速器生产商,占据了约80%至95%的市场份额。其NVLink技术以其高效的连接性能和广泛的应用基础,在行业中具有显著的竞争优势。

此前,NVIDIA第一财季财报显示,公司期内实现营收260.44亿美元,同比上涨262%,远高于市场预期的247亿美元。数据中心业务营收为226亿美元,与上年同期相比增长427%。这些数据证明,NVIDIA拥有强大的实力和影响力,所以也有不与其他公司合作的底气。

然而,UALink的成立可能会对NVIDIA的市场地位构成挑战。

截至5月30日,NVIDIA股价收于每股1105.00美元,跌3.77%,总市值2.72万亿美元。股价的本次下跌或是收到了UALink组织成立的部分影响,此外有消息称,美国政府已放缓向NVIDIA和AMD等芯片制造商发放对中东国家大规模出口AI加速器的许可证,或将使NVIDIA在中东市场的扩张受阻。

值得注意的是,除了NVIDIA的缺席,和谷歌、微软并列全球三大云服务巨头之一的亚马逊也尚未加入UALink联盟。分析指出,AWS作为云服务提供商,可能仍在评估UALink对其业务的潜在影响。

巨头为何结盟?有利益就有动力

研究机构Gartner预测,由于企业应用需求的增长,对AI处理器的需求将推动2024年全球AI芯片的收入增长33%,达到712亿美元,其中数据中心产品将贡献29.6%的收入。到2028年,数据中心产品的收入预计将增加到330亿美元。

UALink联盟的成立为AI加速器领域的连接技术带来了新的竞争和发展机遇。作为NVIDIA的竞争对手,AMD和英特尔毫无疑问将从UALink的成立中收益颇丰。此外微软、Meta和谷歌也将从中获益,这三家公司已累计花费了数十亿美元来购买NVIDIA的GPU,以支持自己的云服务并训练AI模型。

谷歌有用于训练和运行AI模型的定制芯片——TPU和Axion。亚马逊拥有几个AI芯片家族。微软去年也加入了这场竞争,推出了Maia和Cobalt。而Meta则在不断完善自己的加速器产品线。

尽管NVIDIA目前在市场上占据主导地位,但开放的UALink标准可能会吸引更多的行业参与者。据报道,微软及其密切合作伙伴OpenAI计划在超级计算机上投资1000亿美元,用于训练配备未来版本的Cobalt和Maia芯片的AI模型。而这些芯片需要某种方式连接,也许这就会用到UALink。