无论到哪,发现几乎人人都在谈论人工智能。在EE Times过往的报道中,也经常谈论此话题。不过,讨论的大都是有关系统开发人员和制造商如何在系统中植入人工智能以及相关方面的技术创新、突破、芯片、软件和工具,而对于人工智能的风险和危险,谈论得却远不够。

危险显然存在

先是OpenAI董事会之争,虽然人们并不知道背后的全部情况,但一些人似乎预感,这是由于安全护栏不达标,抑或是技术发展速度过于惊人所导致。随后是去年10月份发生的Cruise自动驾驶出租车事故,车辆没有检测到行人,而是直接碾停在了行人身上。

人工智能也可能有丑陋的一面,正如之前在神经信息处理系统会议(NeurIPS 2023)上发表的一篇论文所强调的那样。该文表明,人工智能网络和工具比以前认为的更容易受到针对性攻击,这些攻击会有效迫使人工智能系统做出错误决策。

北卡罗来纳州立大学电气和计算机工程系的研究人员开发了一款名为QuadAttacK的软件,专门测试深度神经网络面对针对性攻击时的脆弱性。该软件旨在探明黑客如何通过操纵数据来欺骗人工智能网络,并观察人工智能的反应。一旦识别出漏洞,就可以迅速让人工智能看到该软件希望它能够发现的任何问题。

就此含义,该论文的合著者、该大学副教授吴天福进行了解释。“攻击者一旦发现人工智能的漏洞,就可能会利用这个漏洞造成灾难。”他解释道,“这一点非常重要,如果人工智能系统对这类攻击的抵御能力不够强大,就无法投入实际应用,尤其是可能影响人类生活的应用。”

“当想到最近关于使用自主武器系统的讨论时,这尤其令人担忧。”他进一步解释道,“想象一下,如果有人聪明地理解了系统中的漏洞,会发生什么。对于我们这些特定年龄段的人来说,不免回想起之前卡通漫画里想疯狂地 ‘控制整个世界’的那些狂妄之徒!”

安全/焦虑 vs 利润/羡慕,如何平衡?

毫无疑问,风险是真实存在的。所以,人们应更多地挖掘人工智能的糟糕和丑陋的一面,无论是现在还是将来,尤其是当人工智能全面普及后。

为了解决这一方面的争论,EE Times、Silicon Catalyst与小组成员合作举办了一场网络研讨会,讨论人工智能的社会责任、监管和投资者视角。

在小组讨论会上,责任创新实验室(RIL)首席运营官Jama Adams、Mayfield的管理合伙人Navin Chaddha及美国人工智能标准(INCITS/ANSI)主席Rohit Israni,都分别从社会影响、投资策略和监管的多个角度,探讨了人工智能的美、丑、恶。

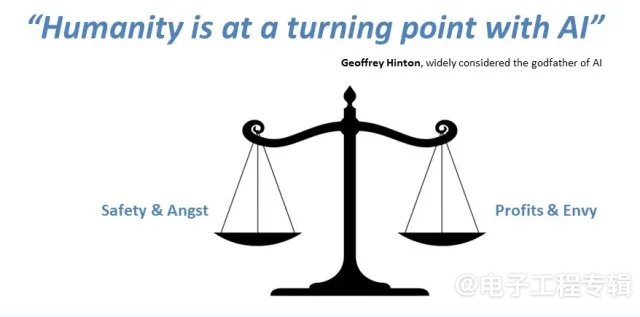

图1:人工智能使人类正处于转折点。(来源:Silicon Catalyst)

利润和安全之间显然存在着较大矛盾,正如被称为“人工智能教父”的杰弗里·辛顿所说,“人工智能正使人类处于转折点” 。

这场长达一小时的网络辩论研讨会,深入探讨了人工智能将如何塑造人们生活的“大局”,也探讨了以下两者之间的平衡行为:

- 人工智能的安全问题以及人工智能引发的所有问题。显然,最近与人工智能相关的事件非常相关,首先是与自动驾驶汽车公司Cruise有关的事故,再就是OpenAI发生的宫廷阴谋。还有,监管将会对创新带来什么影响?

- 人工智能在私人市场和公共市场上对电子行业投资机会的财务影响。针对电子行业投资机会,无论是私人还是公共市场,人工智能的财务影响如何。不用说,许多组织和投资者(私人和机构)都羡慕英伟达在市场上的地位——其销售额同比大幅增长,占据了人工智能处理器市场80%以上的份额,近期其股票价格一路向上飙涨。

这场网络研讨会,帮助读者了解了快速发展的人工智能领域及行业现状,以及监管监督和投资决策如何考虑人工智能对人类的影响。

该网络研讨会特别及时,因为针对人工智能,RIL为初创公司和投资者推出了行业驱动的自愿负责任承诺和协议,已有50多家风险投资机构报名参加。作为发布会的一部分,RIL与VC及美国商务部长雷蒙多举行了圆桌会议。雷蒙多表示,如今仍处于人工智能时代的早期阶段,有必要“追究责任,确保人工智能的发展方式是安全、可信、无顾虑、非歧视、合乎道德与人道的”。

Mayfield是签署该协议的50家风投机构之一,在网络研讨会上,Chaddha解释了对人工智能初创公司的投资策略,以及负责任的人工智能承诺将如何影响他们的思维。

所有社会责任辩论的关键点是,该行业需要考虑人工智能可能带来的风险。

Mayfield的Chaddha在此次网络研讨会上的闭幕词中说:“我认为现在是创办一家公司并以平衡方式运作的好时机。不过,既要赚钱,也要为世界做好事!”

(原文刊登于EE Times美国版,参考链接:Navigating the Good, the Bad, the Ugly of AI,由Franklin Zhao编译。)

本文为《电子工程专辑》2024年4月刊杂志文章,版权所有,禁止转载。免费杂志订阅申请点击这里。