电子工程专辑讯 6月20日,联发科辟谣与谷歌合作打造AI服务器芯片的传闻,联发科发布澄清公告表示,针对有媒体报导“联发科传夺Google AI大单”,是基于市场传言未经全面核实之错误报导,影响公司及投资人权益甚钜。若因该等错误报导造成公司任何损害,将依法保护公司之权利。

早些时候,台湾经济日报援引消息人士报道称,谷歌将携手联发科打造最新的AI服务器芯片,采用台积电的5nm工艺生产,计划今年底前送给晶圆厂制造,在明年初量产。该合作,是由联发科提供串行器及解串器方案,协助整合谷歌自行开发的张量处理器(TPU),助力谷歌打造最新的AI服务器芯片。

业界解读,如今Google上门找联发科携手开发最新AI服务器芯片,意味联发科在AI的实力深获肯定,也是联发科跨足当红的AI服务器领域一大里程碑。

根据台湾经济日报的报道,联发科受到谷歌的青睐是因为联发科的AI能量相当充沛,旗下各产品线都有AI功能强化。联发科对如何迎接大型语言模型(LLM)的发展趋势进行思考。联发科将于10月底推出天玑系列第三代芯片天玑9300,将具备基于LLM的AI运算技术。

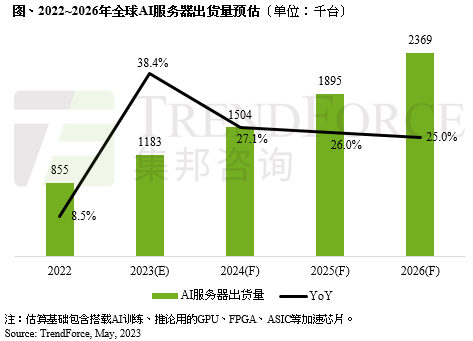

今年AI成为产业热点,TrendForce集邦咨询预估2023年AI服务器(包含搭载GPU、FPGA、ASIC等)出货量近120万台,年增38.4%,占整体服务器出货量近9%,至2026年将占15%,同步上修2022~2026年AI服务器出货量年复合成长率至22%。而AI芯片2023年出货量将成长46%。NVIDIA GPU为AI服务器市占率有望达到60~70%。

从高端GPU搭载的HBM来看,NVIDIA高端GPU H100、A100主采HBM2e、HBM3。以今年H100 GPU来说,搭载HBM3技术规格,其中传输速度也较HBM2e快,可提升整体AI服务器系统运算效能。随着高端GPU如NVIDIA的A100、H100;AMD的MI200、MI300,以及Google自研的TPU等需求皆逐步提升。