AI市场这两年发展的一个主旋律,在边缘AI上——或者更进一步,可以窄化到端侧AI,甚至再进一步窄化到TinyML。参与这一市场的竞争者,不光有传统MCU/MPU供应商、IP供应商,还有不少初创的端侧AI芯片供应商。

端侧AI技术的优势,相关的探讨话题和文章都已经不少了,比如说端侧AI将推理(inference)工作部分转往本地,不需要与数据中心或网关做数据通讯,节约功耗和开销;不需要考虑网络通讯的延迟和带宽问题;而且这么做也让隐私更有保障......

不过在我们看来,端侧AI未来一段时间将持续大火的必然原因在于,端侧设备数量和市场规模是任何市场参与者都无法漠视的:犹如IoT设备数量很快会达到百亿量级,如果端侧AI市场做起来,必然又是个了不得的大蛋糕。这对任何层面的市场参与者而言都是扩大营收的机会。

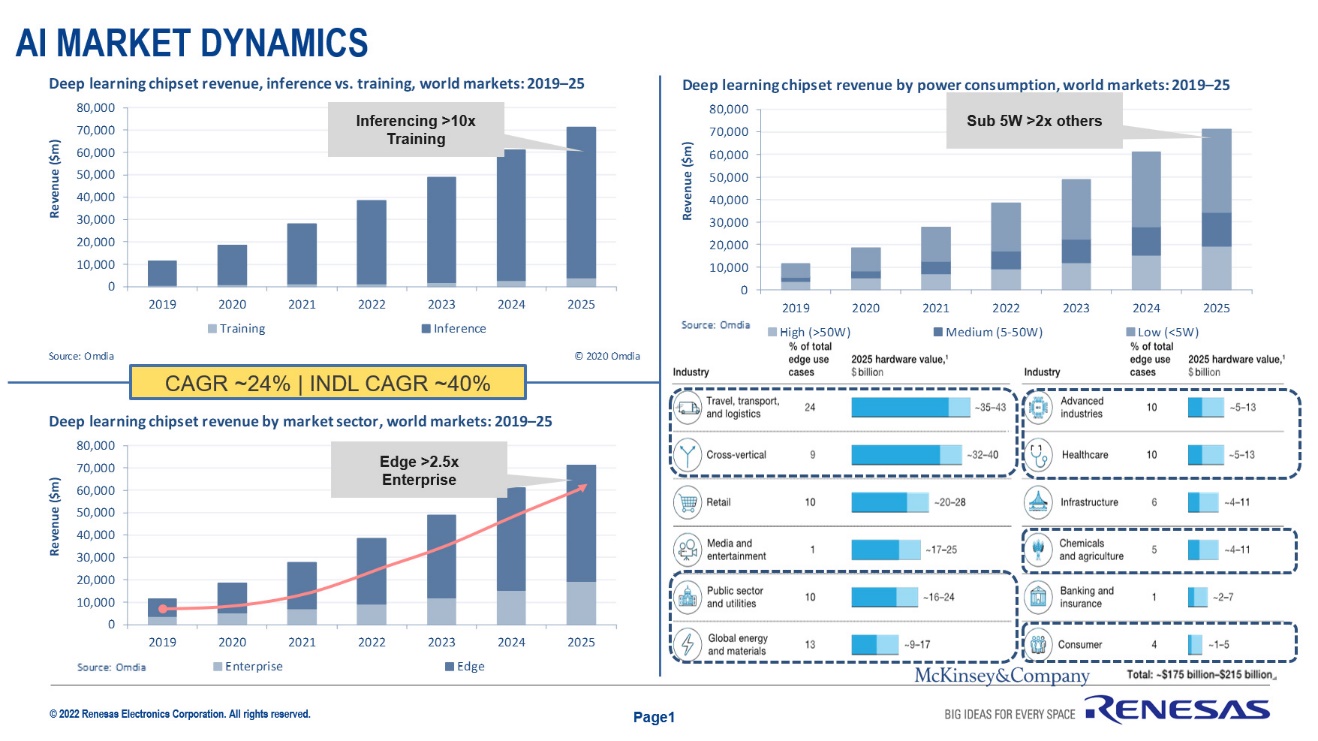

最近我们在采访瑞萨电子集团执行副总裁兼物联网及基础设施事业本部本部长Sailesh Chittipeddi博士时,他给我们呈现了Omdia的一份数据,如下图所示。

预计到2025年,深度学习芯片的市场营收上,用于推理(inference)的AI芯片营收将达到训练(training)AI芯片的10倍。其中功耗不到5W的AI推理芯片,市场营收将是其他类别的2倍。<5W就是应用于端侧的AI芯片。这张图另外也呈现了企业(enterprise)与边缘(edge)AI芯片的营收变化。

这样的市场增量当然值得企业下功夫。不过真正要把AI芯片卖出去,可不光是把芯片本身做好这么简单。

本月初,瑞萨电子宣布收购一家嵌入式AI解决方案供应商Reality Analytics, Inc(Reality AI)。虽说对瑞萨而言,收购属于常规操作,但这应该是瑞萨首次执行以AI技术为明确目标的收购操作。瑞萨是在边缘AI技术上行动相对比较晚的芯片厂商。对瑞萨电子的AI技术布局,及其对该市场的展望做观察,也有利于我们进一步理解该市场的发展现状和未来的可能性。

(注:本文“边缘(edge)”一词的含义将窄化为端侧设备,不包含边缘数据中心等组成部分。)

边缘AI市场布局

瑞萨是传统MCU厂商中布局边缘AI技术的又一个典型代表。英飞凌、TI之类的也都有类似操作。可见这些大型跨国芯片企业对边缘AI市场的理解是大致相似的,虽然它们之间又有各自的侧重点。

而谈到瑞萨的边缘AI技术,我们最先想到的就是其e-AI/DRP(Dynamic Configurable Processor)技术了。此前的不少技术展会上,我们也都看到过瑞萨展示这种专用的AI推理加速器。DRP-AI前两年就已经应用于瑞萨RZ/V系列MPU芯片中。

不过Sailesh告诉我们,DRP-AI并非瑞萨边缘AI布局的全部:“AI有多种实现方式。其一是CPU+NPU(neural processing unit),这类方法也可以是CPU和FPGA之类的硬件配合。其二,只用通用MPU(CPU/MCU),比如64位的MPU来计算。第三种是DRP-AI。”

我们对AI计算的理解主要偏向专用的神经网络计算加速芯片或单元。不过实际上AI计算用一般的通用处理器也可以,虽然性能和功耗都相对受限。尤其对于端侧设备而言,受制于功耗、算力和成本,大部分AI推理运算仍然基于通用处理器——所以比如Arm针对Cortex-M55就特别新增了Helium矢量处理单元,着力于加强DSP和ML方面的能力;再比如去年发布的Raspberry Pi Pico能跑TensorFlow Lite Micro,也是基于Cortex-M0+。

且随着TinyML技术的兴起,端侧AI生态也在想方设法地缩减AI模型尺寸、降低对内存容量和运算能力的需求。所以Sailesh也特别谈到,Reality AI此前与瑞萨之间的合作,其AI模型应用于瑞萨的translator libraries库,就是以瑞萨通用MCU、MPU为计算载体的。后文还会对此做详述。

而Sailesh将DRP-AI单独拿出来作为一个端侧AI发展方向,应当是为了体现瑞萨在端侧AI实现上的与众不同。“DRP-AI作为一种完全弹性化的选择,是我们提供的解决方案。”可能更多人对DRP-AI也更感兴趣,毕竟这是瑞萨给予了厚望的技术。“我们对此是深信不疑的。在高端机器人市场,针对基于视觉的AI技术,我们认为DRP-AI技术,以及我们的一些新产品会扮演非常重要的角色。”Sailesh说,“这个领域可以等等看,有不少视觉AI相关的有趣工作在持续中。”

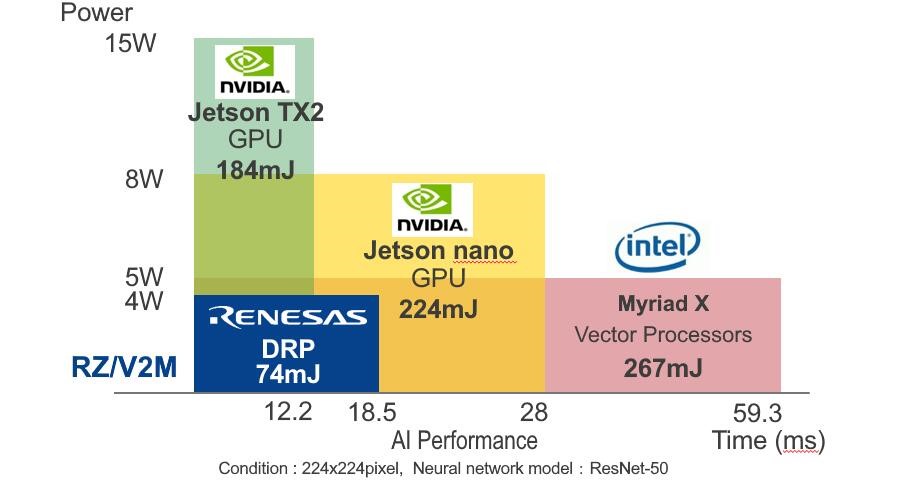

前两年瑞萨就开发了DRP-AI(AI加速器),以及DRP-AI translator软件。这是一种主要面向视觉AI的神经网络方案,比如能够应用于工业生产的预测分析(如某个电机运行故障之前,根据AI分析就能提前预知其故障发生)。此前瑞萨宣传DRP-AI是一种比较典型的前馈神经网络(feed-forward neural network)计算加速方案,相比于其他类型的处理器,以及像是英伟达Jetson nano GPU和Intel Myriad X矢量处理器在效率上有显著优势。

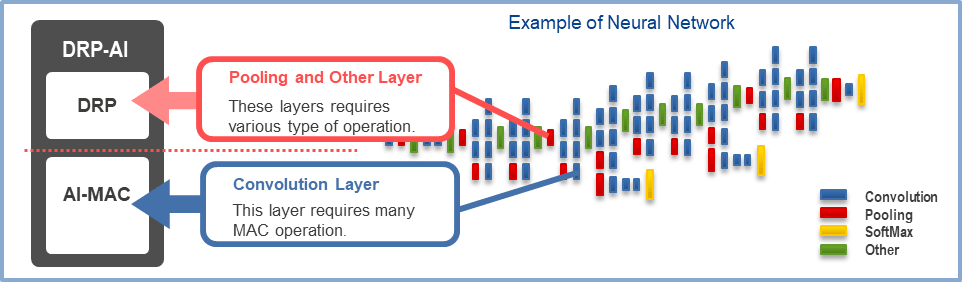

Sailesh在采访中说,“DRP-AI技术有着0.5TOPS到接近10TOPS算力水平,而且是以很低的功耗。这种神经网络能够根据负载来对其自身进行配置,基于复杂环境自行做优化,很智能。”“DRP技术的动人之处,就在于它能够基于喂进去的信息进行处理器性能调整,是一种自我动态重配置(dynamically reconfiguring)方案。所以DRP有着更高的效率。”

从目前DRP-AI的官方介绍页面来看,DRP-AI包括两个部分:AI-MAC——负责AI常见的乘积累加运算,以及DRP可重配置处理器——用于预处理以及池化层的处理等工作。

若总结4个要点,Sailesh认为DRP-AI的价值在于1.能耗比;2.效率;3.成本与灵活性(area,芯片与单板面积);4.动态可重配置性。

AI生态建设需要过程

虽说在硬件效率上有优势,“但相比一些云端有生态基础的市场竞争者,我们目前欠缺的是生态合作伙伴的广度。”这里提到“云”上有生态的竞争对手应该是指英伟达,CUDA和Nvidia AI生态,即便在我们看来英伟达和瑞萨其实并不在同一个赛道上。但“我们现在正在发展生态系统,今年年底之前我们就会有数百个合作伙伴。”

“我的期望是随着时间的流逝,DRP技术会在端侧视觉AI解决方案上得到越来越好的优化。”Sailesh说,“如果只是中等性能需求,那么一般的CNN(卷积神经网络)解决方案就足够了。但如果在视觉AI方面,期望寻求能效和功耗高度优化的解决方案,那么你应该会考虑去用能够对自身进行动态重配置的前馈神经网络产品。”

瑞萨在AI生态建设上应当仍处于早期阶段。所以我们才会看到Reality AI作为瑞萨的首个与AI相关的收购对象的事实。不过端侧AI整个领域本身的发展阶段就比较早期,且瑞萨这两年的动作也还算是频繁。比如说Sailesh告诉我们,瑞萨内部有个团队是专注于AI生态合作伙伴开发的,其中包含了技术营销和业务拓展团队——他们会和不同的客户进行合作。

而且在这次Reality AI收购过后,瑞萨也打算在美国马里兰州新建一个AI卓越中心,“这是我们着手在做的事情,并且我们期望团队会持续扩大。”

同在上个月月底,瑞萨宣布了和嵌入式语音解决方案供应商Cyberon之间的合作——双方将合作提供VUI(voice user interface)解决方案。“Cyberon是语音领域很强的一名市场参与者。类似这样的合作,与生态合作伙伴共同解决不同终端市场的问题还有不少。”“基于我们的MCU、MPU来实践这样的应用,这样的合作还会持续。”Sailesh表示,“我们期望扩张MCU、MPU、DRP-AI合作的范围,让它们得到最大范围的应用。”

还有比较典型的生态建设活动,像是前年的瑞萨杯全国大学生电子设计竞赛,瑞萨就鼓励所有的参赛选手能够在自己的参赛项目中切实地用上DRP-AI资源......此类技术推广活动应当不少。

“我们有在追踪DRP-AI和其他AI相关解决方案的Design-In数据。虽然我给不了你确切的数字,不过DRP-AI的Design-In数量是在稳步增长的。而且我现在每年期望团队达成Design-In倍速增长的目标。”

生态补全和差异化竞争

基于这些,瑞萨对于Reality AI的收购就很好理解了:AI生态和能力扩张自然是其中重点。“我们此前就和Reality AI有合作了。这家公司是我们生态合作伙伴中的一员,我们在HVAC(室内或车内负责暖气、通风及空气调节的系统或相关设备)负载均衡应用方面一直有合作。”

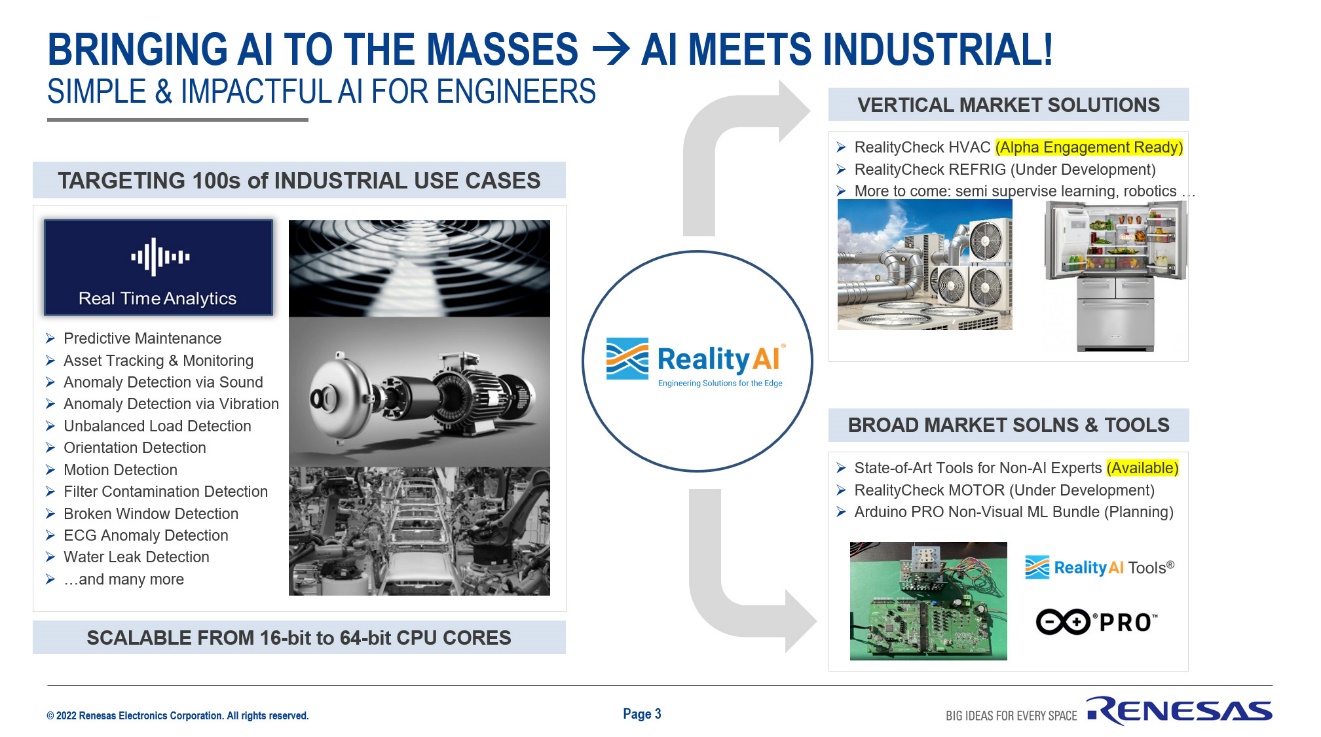

上面这张图展示了Reality AI涉足的市场和产品。“Reality AI和其他竞争者的不同之处在于,他们专注于工业领域。”这也是瑞萨主场,Sailesh说,“对我们来说,这就相当的匹配了。与此同时他们在汽车领域也有涉足。”瑞萨这家公司的两大业务部门分别就是IIBU(工业/基础设施/IoT)与ABU(汽车)。

“我想,基于我们的整体策略,双方相当合拍。而且这一领域的人才也非常难找。”“Reality AI团队的人在开发AI模型方面非常专业,而且也有DSP专家。”“这个团队并不大,不过我们预计会快速成长。”

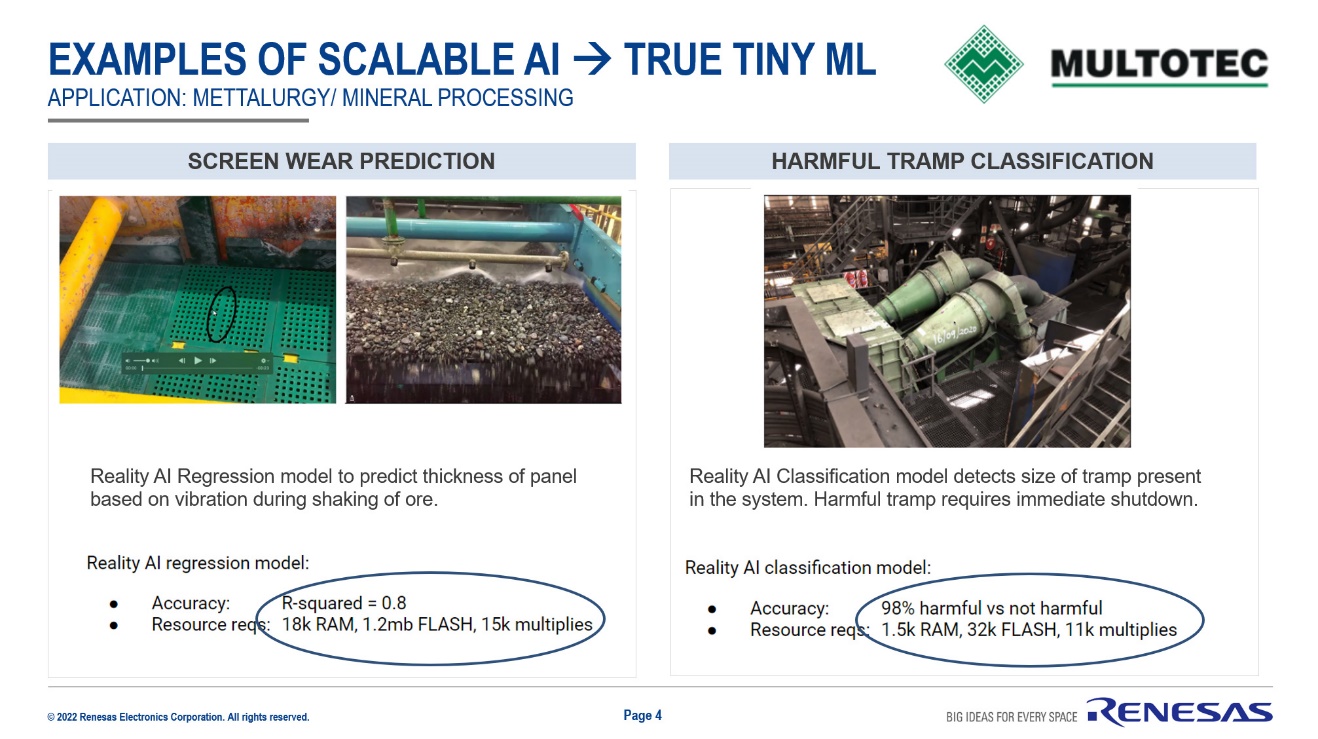

说得再具体一点,瑞萨在PPT中举了Reality AI模型的两个例子,并将其称作“True Tiny ML”。这里的回归模型和分类模型是工业应用中的典型案例。此处重点在于,最后一行存储和算力资源需求量,应当是瑞萨称其为“True Tiny ML”的原因。“Reality AI和我们的MCU、MPU工作流契合度很高:他们做前端AI模型开发,我们提供translator libraries——经过融合之后(藉由e² studio工具),就能跑在MCU、MPU上了。”

“如此一来,我们就能为客户提供更为完整的产品。而且如果客户需要开发AI模型,但本身又没有这方面的能力,我们也能提供Reality AI的model-as-a-service模型服务。”从这番解释来看,Reality AI是增强瑞萨AI生态建设能力的重要一环。“Reality AI团队能够解决的那些问题,对我们客户而言很重要。这是我们努力期望达成本次交易的原因。”很容易理解Reality AI的收购,乃是瑞萨在边缘AI技术堆栈上的横向扩张。

“Reality AI原本的客户可以用我们的MCU和MPU;我们对现有的客户,又能通过Reality AI的工具提供AI模型——提供完整的套装,端到端的解决方案,从问题定义、AI模型到MCU上的实施。”这也是Sailesh反复提到,瑞萨在端侧AI市场上形成差异化竞争的关键。而前文提到AI卓越中心的建立,还将扩大AI解决方案触及的范围。

“我已经看到了基本的demo,就是如何把工具融合起来,并最终应用于我们的MCU。”Sailesh说,“这还处在前期阶段,不过我预期我们将来能够提供完整的套件。”Sailesh说,“我们肯定不可能覆盖每个领域。所以我们的想法是,让(面向开发者的)流程变得无缝,和我们的translater libraries以及e² studio在后端做好融合工作。”“这是个极具挑战性的工作,但团队已经有清晰的思路和早期的演示了。”

Reality AI提供的产品可能更多地适配于更小算力的TinyML型设备之上。实则在算力更高的DRP-AI生态中,Sailesh也谈到了瑞萨对于面向开发者打造更为全栈式的、完整系统级解决方案的执著,让AI开发更加无感。似乎这种思路在这些年瑞萨寻求产品差异化的过程里,是一以贯之的。

从更高维度来看,这家公司的IIBU业务也在提Go Broader和Go Deeper策略。各类合作与扩张也因此显得稀松平常。这里其实还没有怎么触及瑞萨对于更多边缘AI纵向市场的覆盖目标(包括语音、视频、预防检测、医疗健康等)。虽然瑞萨无意于全面覆盖所有的应用市场,但去年瑞萨与Syntiant在语音控制多模AI解决方案上的合作就属于这个角度的典型。

“我们相信端侧AI是个正在快步成长中的领域。我们能够在这一领域找到相较竞争对手的差异化方向。我们为客户提供完整的工具套件,部分市场竞争者就很难赶上。”Sailesh在总结中说,“这其实不是买个公司这么简单的事,而是构建一整套全面的解决方案和恰到好处的用户体验,让工具相比竞争对手的更易于使用。我们如果能做到这些,就能在竞争中胜出。”

采访最后,Sailesh再度强调了在Reality AI的加持下,当前瑞萨于端侧AI领域相较竞争对手的不可替代性:即前文提到Reality AI能够为客户,以服务的方式提供AI训练模型,也就是所谓的AI model-as-a-service,尤其满足那些不具备这方面能力的企业。“这是我们的不少竞争对手无法提供的选择。”即便瑞萨和Reality AI的产品融合还需要一些时间,但这方面的能力在Sailesh看来,在市场上已经足够实现差异化竞争。

“我们说到2024、2025年,你会看到这些技术带来的大量差异。我们才刚刚启航,但我们已经在通往我们预期中的那条路上了。”Sailesh说,“我们决定要成为这一市场的领导者。我相信时间到了,你会看到我们在这一领域留下的印记,当然不光是Reality AI的收购,还在于我们内部开发上的努力、更出色的工具链,以及端到端的用户体验。”