人们一直在探讨人机交互的各类可行性方案。对于手机、平板而言,最常规的交互自然就是触控了;当然现在还有语音。不过与基本交互操作方式构成互补的,都是靠着传感器技术的发展。

比如2007年,初代iPhone应用重力传感器(或加速计)实现手机横置时,照片也随之横置,这种当时看来还颇为神奇的交互方式。随着手机加入越来越多的传感器,包括磁力计、陀螺仪、结构光、ToF等越来越复杂的传感系统,手机也有了多样化的交互;甚至有为加强体验存在的颜色传感器(动态调整屏幕显示白平衡)、光谱传感器(为加强手机拍照体验)等。

有个比较偏门的交互方式,似乎是从智能手机开局没多久就有不少厂商尝试的,即“浮空操作”或者叫“隔空手势”,即不需要手指接触到屏幕,就能进行一些简单的交互。这在浮空操作上比较知名的应该是前年华为Mate30系列手机宣传中的“隔空手势”。在吃东西、做菜等不方便用手指触控屏幕的场景下,也能操作手机。

不过浮空操作方面的探索,其实还能追溯到更早。在此之前先做个相关广告,将于11月3日举办的ASPENCORE全球CEO峰会上,英飞凌科技首席执行官(CEO)Reinhard Ploss,以及英飞凌科技全球高级副总裁、大中华区总裁苏华博士将做题为《电气化和数字化:推动新时代创新与业务发展的主流趋势》的主题演讲,届时千万不要忘记关注。

之所以这里插入一段英飞凌的广告,是因为英飞凌作为传感器供应商,在手机浮空操作的历史上,还是有着浓墨重彩的一笔——后文还将提及。而传感器技术本身也是推动社会数字化转型的关键,而不仅限于本文要探讨的手机。

浮空操作的起源

说起源可能有点夸张,不过我们能够追溯到与手机浮空操作方式相关的应该是诺基亚Lumia 920——这是2012年诺基亚推出的一款Windows Phone手机。Lumia 920并不支持浮空操作,但它支持“戴着手套操作”——这也是这款手机当时的一个卖点。对于一般的电容触控屏来说,戴着手套操作一直是个传说。而戴着手套操作,恐怕也是浮空操作的某种变体了。

当时这种被诺基亚称作Super Sensitive Touch的屏幕,能够穿过手套或者很长的指甲,感知到皮肤的存在性——至少其上游供应商Synaptics是这么说的。在Synaptics那里,这种技术被称为ClearPad电容触控技术。

当年EE Times美国版有报道过这种触控技术,那会儿大家普遍还在讨论“多点触控”,以及on-cell与in-cell显示屏的结构差异。不过公开探讨如何实现隔着手套也能操作屏幕的原理的,得再往后推一些。

真正令浮空操作,在手机上为大众所知的应该是2013年的三星Galaxy S4。这款手机在造势时,大量宣传了其“悬浮触控技术”——虽然其体验实在是有些糟糕;也算是为手机上的浮空操作提供了探索的空间。但实际上,比Galaxy S4更早的索尼Xperia Sola已经做过这方面的探索。只不过后者的知名度是远不及Galaxy S4和Lumia 920的。

索尼Xepria Sola

基于这种技术,在手指与屏幕相隔15-20mm的距离内,屏幕也能有感知——当然我们现在知道,20mm是个太短、也严重妨碍交互体验的距离。这种技术和Lumia 920隔着手套也能操作的方案存在区别,但因为都是在屏幕触控方面做文章,所以我们认为依然可以归为一类。

当时这类屏幕开始采用自电容传感层,因为比互电容更为敏感,即便手指不接触到屏幕玻璃表面也能做简单的手势或者接近感知。在具体的设备上,不同产品的实施方案可能有差异。索尼当年针对Xperia Sola有发布过一篇技术原理解释的文章,现在已经找不到了。不过大致原理也就是谈自电容与互电容。

自电容显示屏有“强信号”特征,可在离传感器0.79英尺的地方就检测到手指,但其缺陷在于很难支持多点触控(因为会存在所谓的触控ghosting effect)。而当时传统多点触控屏幕为了明确多个手指所在的位置,必须降低信号强度,也就无法识别浮空的手指。所以正确操作就是把自电容和互电容做融合,互电容用于常规触控感知;而自电容用于感知浮空操作。要区分两者操作,则通过降低触控感知的阈值来达成。

索尼当时的Floating Touch浮空触控操作技术是和Cypress一起开发的(如今也是英飞凌的一部分了)。不过最终其应用场景也十分有限,主要是用在了浏览网页时的浮空翻页上。但生态扩展方面,当年的Android 4.0有增加新的API来处理浮空操作事件。三星在Galaxy S4身上,做了更多交互的探索,包括截屏、亮屏等各种浮空操作手势引入。

只不过如前文所述,因为距离限定在20mm以内,手势操作的成功率不容乐观。使用体验阻碍了这项技术的发展。或许戴手套操作才是其更好的归属。

浮空操作的“异类”:毫米波雷达

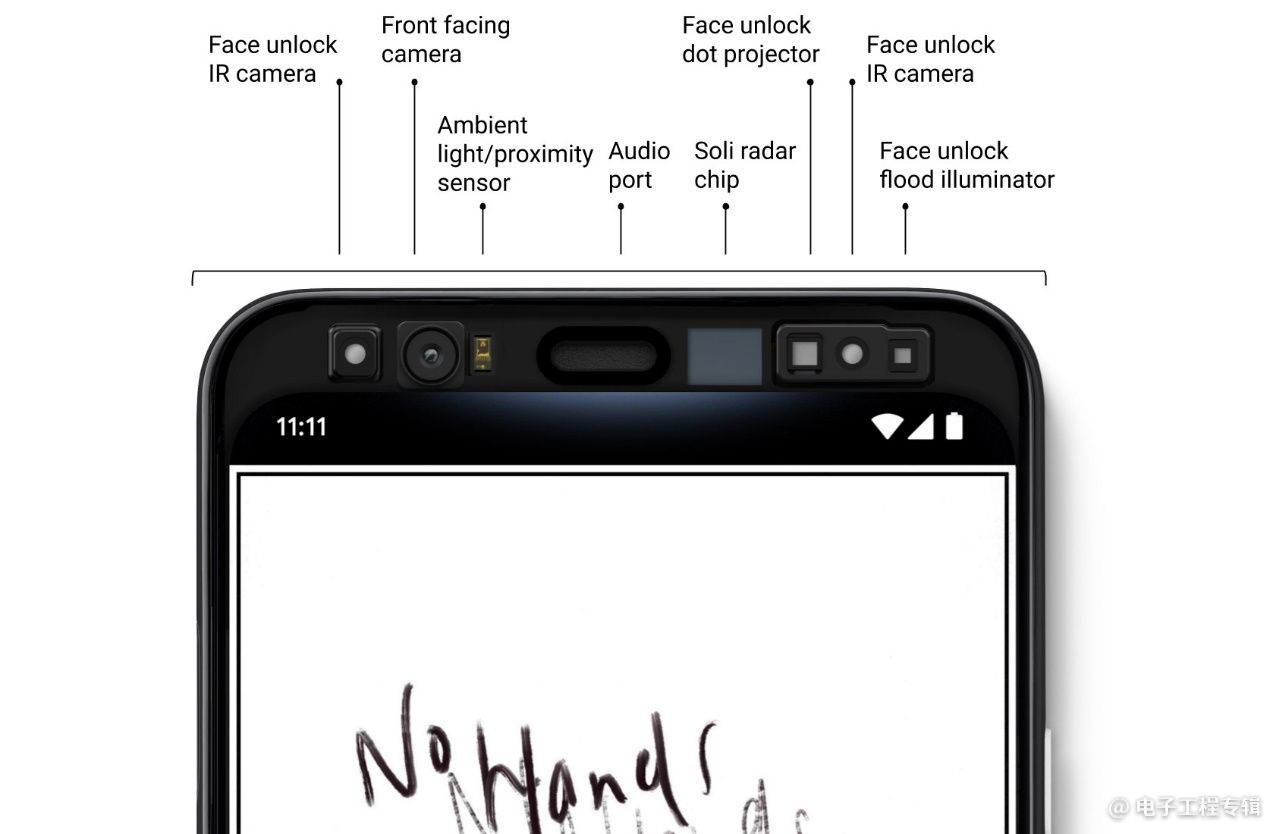

当代手机实现浮空操作已经不这么干了。更常见的选择是采用一些可做3D成像的方案——藉由不同的传感器做3D感知,也就极大地扩展了浮空操作的距离,体验自然不是在触控屏上下功夫可相提并论的。这其中颇具探索意义是谷歌Pixel 4手机,用于做浮空手势交互实现的乃是一枚毫米波雷达。这在手机产品上可认为是绝无仅有的。

谷歌将Pixel 4所用的雷达称为Soli雷达——这是一种短距雷达传感器。其基本原理是,以毫米波雷达基于对象与无线电波之间的相互作用,来检测和测量该对象的属性。这颗毫米波雷达来自英飞凌,在英飞凌的产品线中名为XENSIV毫米波雷达。“无接触的人机交互”也是这一时期的热门应用。英飞凌此前在接受我们采访时说,这颗毫米波雷达能应用到手机上,以小尺寸外形为基础——特色包括AiP(Antenna In Package)封装技术,把所有的天线都集成在一个芯片中。

雷达作为一种检测和测距技术,其存在已经有将近一个世纪的历史了。现在不同规模和原理的雷达应用领域也越来越多。谷歌当时组建了一个Soli团队来开发小规模雷达系统,其中也包括与人机交互相关的精细化感知。

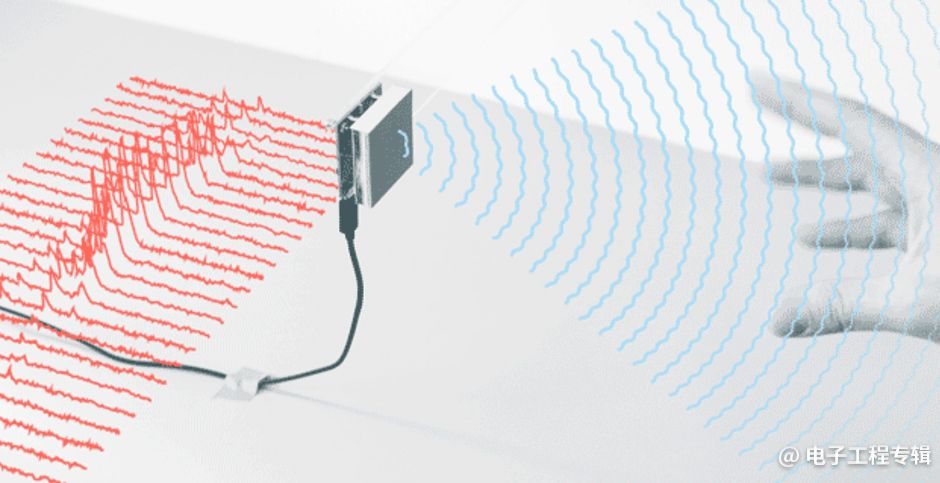

传统的雷达设计,需要考量相关目标尺寸的空间分辨率,这样才能分辨不同对象、辨别其空间结构。这样的空间分辨率要求较宽的传输带宽、较窄的天线束宽(beamwidth),以及较大的天线阵列。而Soli雷达是基于动作感知的思路,而非空间结构。这也是实现将毫米波雷达应用于手机这类小尺寸设备的关键。

这种方案基于接收信号的时域变化,来感知和分辨精细的动作。雷达发射高频率、毫米波长级别的调制信号,并接收对象反射叠加。对象亚毫米级别的位置变化,在接收信号时间周期变化过程中就可以被分辨出来。在多个传输窗口期内,这样的变化表现为多普勒频率——它与检测对象的运动速度是相关的。通过分辨不同的多普勒频率,雷达信号处理管线就能够借助不同的运动模式,来区分检测对象了。

加上Soli有三个接收器对信号做处理,来估算3D位置;位置信息配合距离、速度、角度,达成更复杂的分辨能力。当然这其中还有更具体的工程问题,比如提升信噪比的方法、规避干扰,以及如何降低功耗等。而且谷歌还为之配备了机器学习算法,将Soli获得的结果信号传给手势分类的ML模型,用于以较低的延迟来识别手势。数据集都是来自谷歌自己采集的志愿者手势。

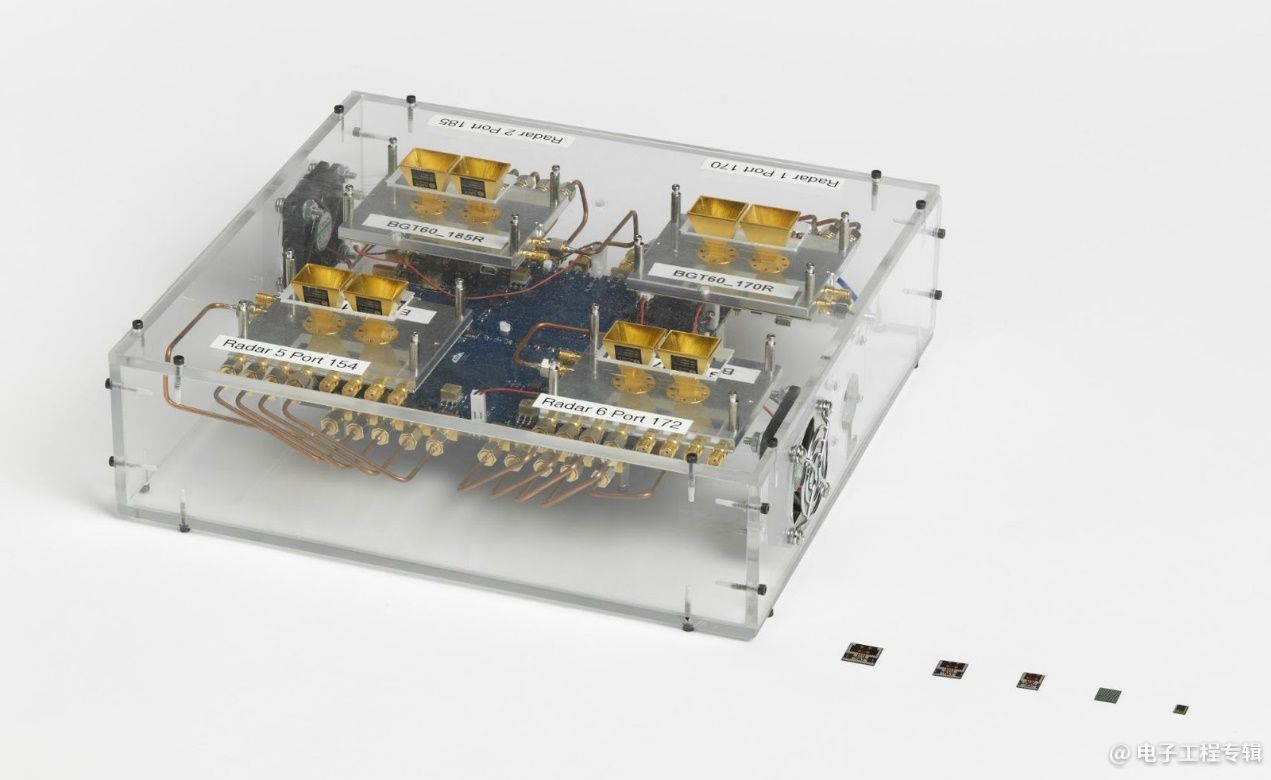

上面这张图是谷歌2014年首度制造的Soli原型产品,基本是一台桌面PC的大小。可见这些年人类为实现人机交互革新,也算是付出良多了。

3D ToF是如今的主流方案

Soli雷达在技术难度上应该说还是相当大的,它面临各种工程问题。举个简单的例子,它与手机周围其他组件的干扰与共存就比较令人头痛。谷歌为此开发了一种过滤器,用于减少手机音频震动对于雷达信号的影响——这样才能实现一边放音乐,一边也能手势操作。

未知谷歌对于Soli技术在手机上的应用是否还会做进一步的研究。英飞凌在接受我们采访时提到,对毫米波雷达在手机上的应用还是有信心的。它与现下主流的ToF技术相比,毫米波雷达更能感知微动,所以两者之间可以实现更好的互补。

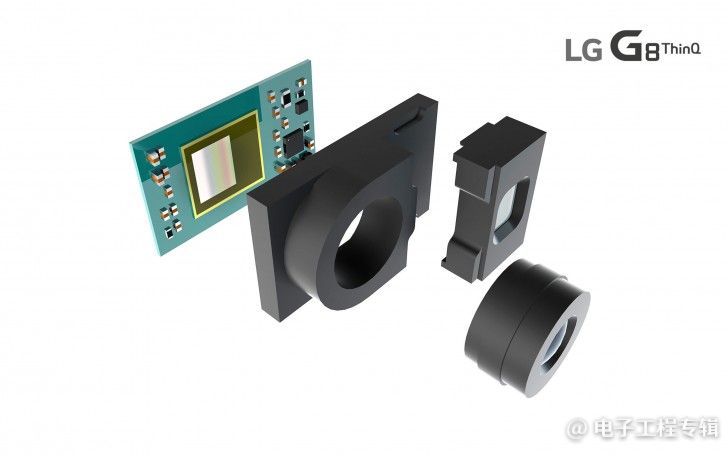

这就带出了如今浮空手势实现的主流方案3D ToF。华为Mate30主要就是用ToF光学3D感知来实现隔空操作的。不过事实上,最早将3D ToF带到前置光学感知系统中的手机应该是2019年在MWC展会上展示的LG G8 ThinQ。当时LG为这款手机的ToF光学3D感知能力,主打的应用方向是3D人脸识别。某种程度上,苹果的结构光带动了光学3D感知技术在手机上的发展,而3D ToF也是从这个时候开始兴起的。

对光学测距ToF技术,也就不需要再多做赘言了。此前我们有大量的文章探讨过这方面的技术,还专门撰写过一篇《消费电子ToF技术与市场分析报告》,其中详细探讨了ToF光学3D感知/成像技术在消费电子中的技术及市场。LG G8 ThinQ所用的ToF模组接收端传感器也是来自英飞凌。

ToF方法用于光学测距的原理也比较好理解:要测得ToF模组与场景中某个对象(或某个点)的距离,则由ToF模组的光源向该对象发出光(子)。光在发出后抵达该对象,并反射回到ToF模组的传感器。计量此间“光的飞行时间”,在光速已知的前提下,即可得到距离数据。

把这种单点扩展成多点,自然也就可以达成ToF的3D建模和感知能力了。当然,我们现在知道ToF光学测距/感知不仅可应用于手机前置摄像头做浮空手势交互,而且也能用在后置的光学系统上,不管是辅助摄像头对焦,还是做一定距离场景内的3D建模,辅助VR之类的应用。iPad和iPhone所用的LiDAR即是一种典型的3D ToF光学感知系统。

我们认为ToF在人机无接触交互方面,会更适用于手机等消费电子产品;而Soli雷达极有可能是在这条交互之路上,技术上所做的某种探索。当然也不排除未来,毫米波雷达应用于手机用来实现其他应用,比如微动感知,与3D ToF达成互补。

在手机的交互方式上,浮空操作始终不是主流。不过经过这8、9年的发展,从早期Galaxy S4以浮空操作那悲惨的成功率,到谷歌Soli雷达探索达成的高可用性,以及如今3D ToF将浮空操作可用度提升到很多旗舰设备标配的程度——传感器的选择在其中还是相当重要的。

前不久我们在采访Prophesee CEO Luca Verre时,共同探讨手机若作“存在检测”,哪种传感器会是更合理的。毕竟Prophesee基于事件的视觉传感器(event-based vision sensor)也能做存在检测。ToF、毫米波雷达、传统RGB摄像头等其实也都能做这方面的工作。实现always-on的存在检测,其实是提升人机交互体验的又一个重要课题。这个话题或许可留待多年后再看,何种传感器会在此实现最高效的应用表现呢?

最后别忘了关注2021 ASPENCORE全球CEO峰会:英飞凌科技首席执行官(CEO)Reinhard Ploss,以及英飞凌科技全球高级副总裁、大中华区总裁苏华博士将做题为《电气化和数字化:推动新时代创新与业务发展的主流趋势》的主题演讲。点击下面长图报名参会:

责编:Luffy Liu

- 学到了很多,感谢

- 很有帮助的文章