今年英伟达在Computex的主题演讲之后,黄仁勋接受媒体线上采访时,特意选在了英伟达新落成的一个企业建筑楼内。这栋建筑叫“Voyager”,位于美国的圣克拉拉,占地大约75万平方英尺。我们也算是第一批见到建筑内部长什么样的人了,虽然是通过线上的方式。

比较有趣的是,黄仁勋特别提到这栋建筑的独特之处在于其内部的光照设计,是最大程度考量了自然光特性的。“我们在超级计算机DGX上用RTX光线追踪技术模拟了整个建筑,之所以这么做是为了平衡照进这栋建筑的光,以及节约能源——主要是恒温系统的节能。因为进入建筑的光太多的话,就需要更大程度地使用空调。”黄仁勋说。

“这栋建筑的屋顶在角度上是恰到好处的,如此一来,早晨的阳光、傍晚的夕阳都不会直射进来。屋顶、窗户的倾斜都能够做到自然光的精致平衡,对人眼来说相当舒服。”“我们用超级计算机模拟了未来建筑,我相信这样的设计会在所有的建筑中见到。”这栋建筑内,也有专为机器人通行,远程VR之类的实现。

虽然黄仁勋在介绍Voyager时并未直接谈到Omniverse,但实际上在DGX上用光线追踪模拟建筑全貌,实现自然光的平衡照射,我们猜测很大程度用上了英伟达自己的Omniverse。Omniverse译作中文应该是“全宇宙”。本质上就是基于真实世界的各种物理特性,创建的虚拟世界,所以它应该属于Metaverse,也就是元宇宙或者虚拟世界范畴。这个虚拟世界内的各部分构成都极大遵循现实世界的物理法则,因此可以模拟现实世界的运作,并在很大程度上指导现实世界。

今年GTC上,黄仁勋对Omniverse的形容是,“一款将3D世界连接至共享虚拟世界的平台”。这句话是可以概括Omniverse的。这样看来,Omniverse可能成为未来digital twin数字孪生技术的基础。当前英伟达主要在图形领域和仿真领域融入Omniverse。黄仁勋在接受采访时,有人提问:“Omniverse技术能将这一概念扩展到什么程度呢,比如化学技术或者其他领域?”

元宇宙未来主义畅想

在谈元宇宙这个问题时,黄仁勋对Omniverse作了一些预想。“未来会有很多的设计者、创造者,在虚拟现实、Metaverse中设计数字事物;然后才在现实世界中去完成设计,包括汽车、包、鞋子等等产品。我相信这会是个更大的市场、更大的领域。可能Metaverse里的世界,会比我们现实世界(Universe)大上百倍。”

“其次,我相信Metaverse世界里的经济会比物理世界规模大很多,数字货币、加密货币会在Metaverse中使用。”日本此前有部电影叫《夏日大作战》,其中畅想的虚拟世界就与黄仁勋此处提及用Omniverse搭建的虚拟世界很相似——同类虚拟世界题材影片又如《头号玩家》。或许这件事很快就不只存在于科幻电影中了。

电影《头号玩家》剧照

“如果这个世界看起来很美好,很精致,就值得艺术家们贡献时间去打造漂亮的建筑、漂亮的汽车、漂亮的产品,只不过是以数字的方式。以数字的方式买东西,数字的方式驾车,数字的方式享受。”

“怎么去造出一个虚拟世界?并且为这样的虚拟世界添砖加瓦?”黄仁勋说,“首先需要有个引擎,这就是Omniverse要做的事情。这个引擎能够渲染非常高保真的影像。其次,这个虚拟世界需要符合物理定律,包括粒子物理、引力、电磁波、光、压力等等。”“在这样仿真的引擎之下,人们愿意将创造的东西放进去。”

“随后,这个世界必须是开放的。所以我们选择了Pixar发明的USD(universal scene description)语言。我们在其中投入了相当多的资源。有了USD,AI本体(AI agent)穿越虫洞就能通过AR/VR的方式进出。”“最后,Omniverse在云上也是可扩展的。”

“这就是Omniverse,我们动用全球最棒的工程师、科学家去打造,已经为其投入了大约3年的时间。我觉得这会成为我们最重要的作品之一(one of our most important bodies of work)。”

虚拟世界现在走到了哪里?

计算机图形学的核心就是模拟,使用数学和计算机科学来模拟光线、材料的交互,模拟物体、粒子和波的物理特性等等。光线追踪实际上是其中很典型的一个例子。所以由英伟达提出Omniverse一点也不奇怪。对于黄仁勋畅想的未来,我们也从不怀疑。不过问题也在于现阶段的Omniverse能做什么。前年GTC China上,英伟达才特别面向建筑行业(AEC)推了Omniverse,尤其强调3D制作流程的协作,“在AEC工作流中增加实时协作功能”。或许Voyager就是这么来的。到现在,Omniverse的发展速度有些超乎我们的想象。去年12月,英伟达发布Omniverse公开测试版。

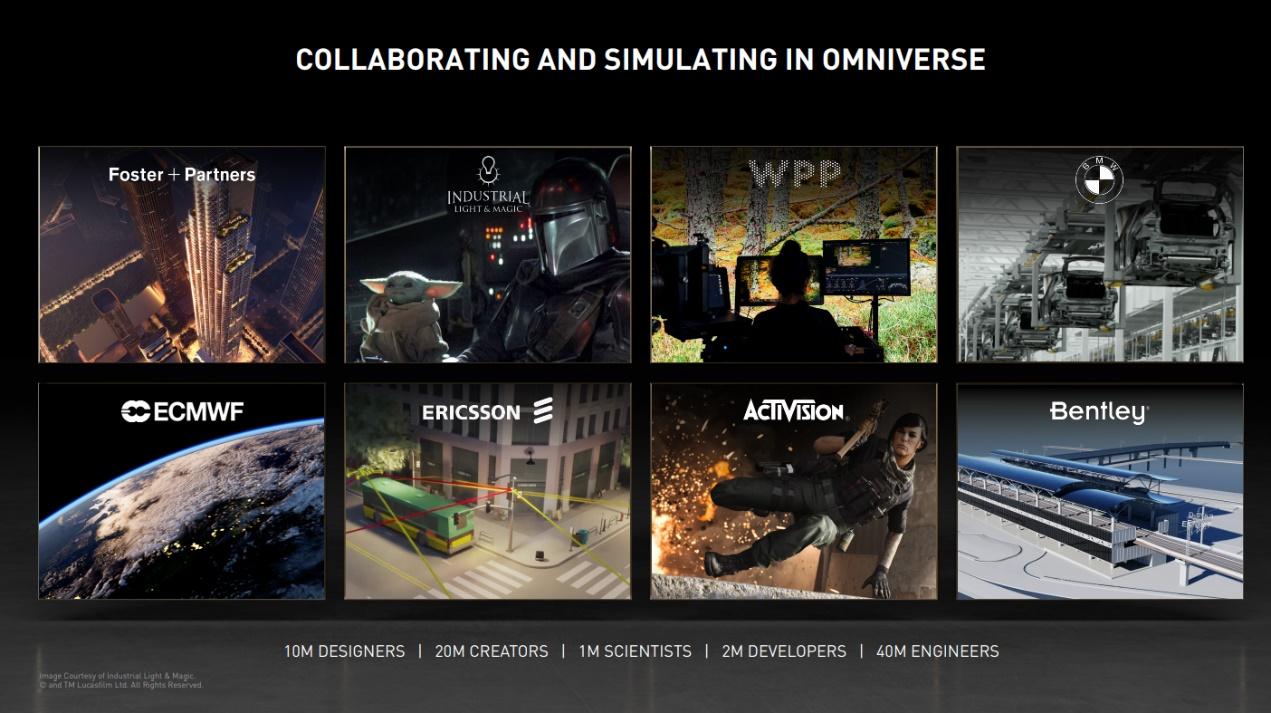

或许英伟达本身也无法完全预想Omniverse究竟未来能做什么,更多的需要交给使用Omniverse Kit的开发者去为元宇宙添砖加瓦。除了在不同工作地点协同进行建筑设计的例子(福斯特建筑事务所全球17个办公地点的设计师再用Omniverse协同作建筑设计),工业光魔(ILM)此前已经在测试Omniverse,这就是影视行业的应用了。

工业光魔主要是期望用Omniverse将来自多个工作室的内部、外部工具管线汇集到一起,在Omniverse中协同实时地渲染最终的镜头,以及创建Holodeck之类的大型虚拟数据集。从不同位置实现设计协作,以及构建更简单的工作流,也是Omniverse的重要特性之一。

有关设计协作还有不少例子,比如游戏公司Activision用Omniverse将自家大量3D内容整理到一个共享,并且可以搜索的空间内;包括Autodesk、WPP等不同领域的企业及其工具都参与了进来。不过这里我们将重点放在Omniverse在Digital Twin的应用上——在我们的理解里,Omniverse应用中,Digital Twin应该属于其中的高级阶段。

前文提到爱立信用Omniverse进行5G波传播的模拟,已经有真实世界模拟的成分了;Twin Earth则用Omniverse打造了一个数字孪生(Digital Twin)地球——虽然我们尚不清楚这个孪生是孪生到了何种程度。

但Digital Twin的确是这两年很热门的一个词,是工业4.0时代我们经常提到的一个概念。其本质就是针对现实世界——比如制造工厂的环境或某些系统,模拟一个数字复刻版出来。智慧工厂的某些解决方案常这么做,用数字复刻版模拟运作这样的虚拟工厂,也就能够实现预测性维护(predictive maintenance)、错误预判等。在图形学发展到Omniverse这个程度之时,Digital Twin似乎也有了更大的外延。

用Omniverse来构建Digital Twin的例子也不少。基础设施工程软件公司Bentley,构建的项目比如道路桥梁、铁路和交通系统等。这家公司打造的iTwin平台,是在施工完毕后可以使用3D模型在整个生命周期中监控和优化性能。其本质也算是基础设施Digital Twin的构建。

Bentley在Omniverse中用于构建Digital Twin的工具

如前文提到的,Omniverse可以模拟粒子、液体、材料、弹簧、线缆之类的物理特性。英伟达对于这个问题的理解是,这些模拟乃是机器人技术的基本能力,机器人可以在Omniverse世界里通过模拟,学习如何成为一名合格的机器人。

比如机器人可以在Omniverse的虚拟工厂里训练如何搬箱子、拾取放置对象等操作。虚拟工厂内的AI、软件,和实体工厂所用的完全相同。这就是打造Digital Twin的概念了,包括虚拟工厂中的布局、操作设备和实体工厂一样,而且也连接ERP系统等等。

宝马的虚拟工厂

宝马工厂就用Omniverse进行虚拟工厂的模拟,在Omniverse世界里构建工厂的Digital Twin。宝马打造Digital Twin的出发点在于,他们需要定期对工厂做重组,来适应新车上市的节奏。那么在Digital Twin虚拟工厂里面就能做规划和测试了。从此前GTC的演示来看,宝马可能不仅用到了Omniverse技术,还需要更多技术的配合。比如需要有人用动作捕捉套件在虚拟工厂中操作,穿越实体工厂和虚拟工厂的“虫洞”进入装配模拟系统,记录任务动作;随后有人以协作的方式再去实时调整生产线设计。

针对新的工作流程,则可以使用“数字人”来测试。这些“数字人”本身就是Digital Twin,与真实员工的数据一致。最终优化生产线,针对人体工学设计和人身安全等问题做出考量。

至于工厂中的机器人,宝马主要是用机器人执行生产中的物料流动。这个过程里,宝马用英伟达的Isaac来对机器人做AI训练,类似于在机器人“脑内”训练其物流工作过程中,应对各种环境的能力。有关Isaac Sim——它实际上是Omniverse的一个具体应用:用Omniverse平台来进行模拟,比如说各种常见的机器人使用场景,像是在工厂内导航、操作,为之生成合成数据用于感知模型的训练。这也是比较具有代表性的Omniverse应用,下文还会提到。据说宝马在生产网络中模拟了全部的31家工厂,Digital Twin智能制造方式果然还是未来啊。

如果将来Omniverse以更高的精度模拟世界甚至宇宙,则其应用场景或许就覆盖到了全人类的方方面面,而不仅限于以上谈到的这些企业。而且从今年夏天开始,Omniverse正式提供企业许可证,作为企业服务存在。

还有一些比较典型的例子,比如说用Omniverse来测试自动驾驶汽车。毕竟虚拟世界的一个好处就是,可以测试各种现实世界无法测试(或无法简单测试)的项目,而且测试时间可以大幅缩短。沃尔沃就是用Omniverse做自动驾驶汽车测试的成员,这其中涉及到对汽车驾驶周边环境、行人等的模拟。

这应该是英伟达DRIVE AV在Omniverse上的应用DRIVE Sim。这是又一个Omniverse的典型应用,通过DRIVE Sim的“模拟路测”,自动驾驶开发者也就能够提升测试效率、加快汽车的time-to-market时间了。

自动驾驶和机器人是英伟达现阶段对Omniverse设想中应用的两个重要组成部分,也都是Digital Twin方向。不过感觉现阶段的这些例子,在英伟达看来估计还只是Omniverse的小试牛刀。

Omniverse需要哪些核心构成?

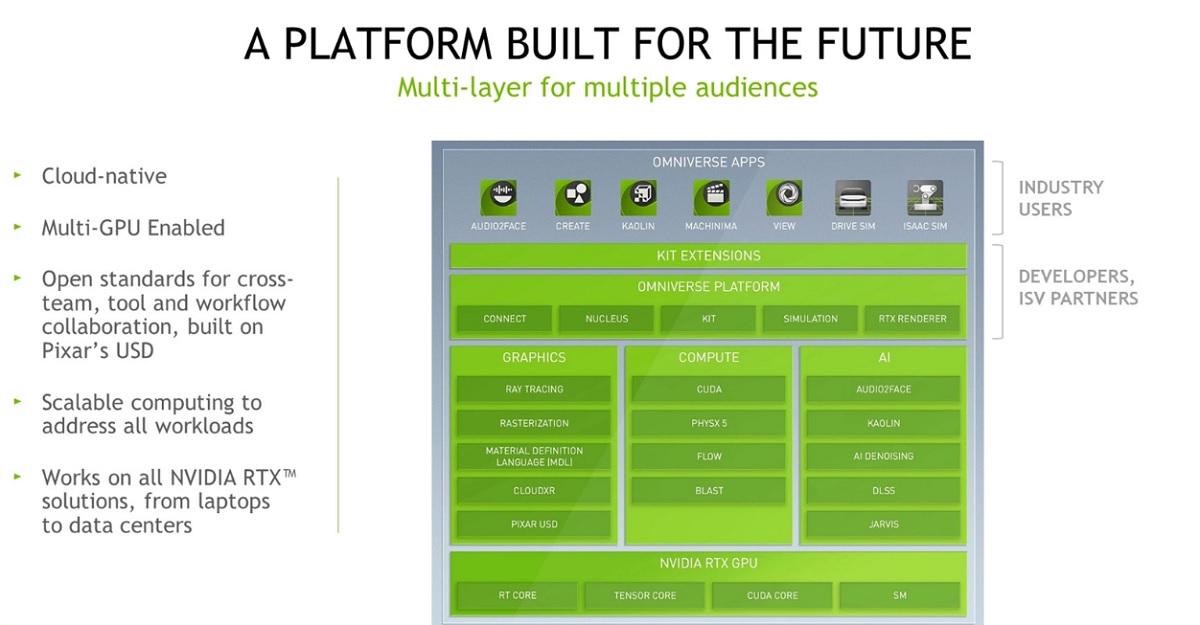

最后来谈谈Omniverse本身的一些主要的构成要素,这有助于我们理解到底如何构建元宇宙。今年GTC上,黄仁勋对Omniverse进行了比较详细的介绍,他在介绍中将Omniverse平台分成了几个部分:

第一部分是Omniverse Nucleus。Nucleus是连接不同位置的用户,实现3D资产交互和场景描述的数据库引擎。“连接以后,负责建模、布局、着色、动画、照明、特效或渲染工作的设计师,可以协作创建场景。”Omniverse客户端向数字内容和虚拟世界做出改动,应用于Nucleus Database。这些改动在所有连接应用之间实时传输。

就像用Office 365进行线上的多人文本编辑协作一样。当然其实现难度要比文本编辑协作大很多。这对于很多行业而言也是长期以来的痛点。在Omniverse中,“多个用户可以连接到Nucleus,以USD代码段的形式传输和接收对自己场景的更改。”

有关USD(Universal Scene Description),这里可以多聊几句——也是Omniverse的关键元素之一。USD技术原本是著名的动画工作室Pixar开发出来用于制作动画电影的,其存在历史有超过10年了。这属于一种数据交换格式,针对的是大型3D场景,以无损的方式处理针对内容的融合、组装、覆盖、动画化等操作;算是融合了Pixar在电影协作软件打造方面数十年的经验。

USD的设定甚至可以追溯到《玩具总动员2》时期。对于3D世界而言,没有哪两个应用会使用相同的“语言”;而USD是为了突破这一点被英伟达看中的。我们大概可以把USD形容为3D领域的HTML,作为某种标准存在。对于Omniverse而言,协作也就实现了跨应用的内容共享,而且可以不同的方式浏览、修改内容。Nucleus整体在此扮演一个用于多方场景修改的通讯的hub型角色;USD则作为一种统一表达方式存在——如果没有统一表达方式,那其实也不用谈Metaverse虚拟世界构建了。

基于此,英伟达提到Pixar的动画电影协作是非实时的,所以英伟达在USD之上增加了在不同用户间同步的能力。与此同时要把USD扩展到媒体和娱乐应用之外,包括机器人、汽车、建筑、工程、生产制造等等。对于第三方应用而言, Omniverse Connect库作为插件可以让第三方应用连接到Nucleus——插件用Omniverse Connect来追踪本地和外部对内容的修改。

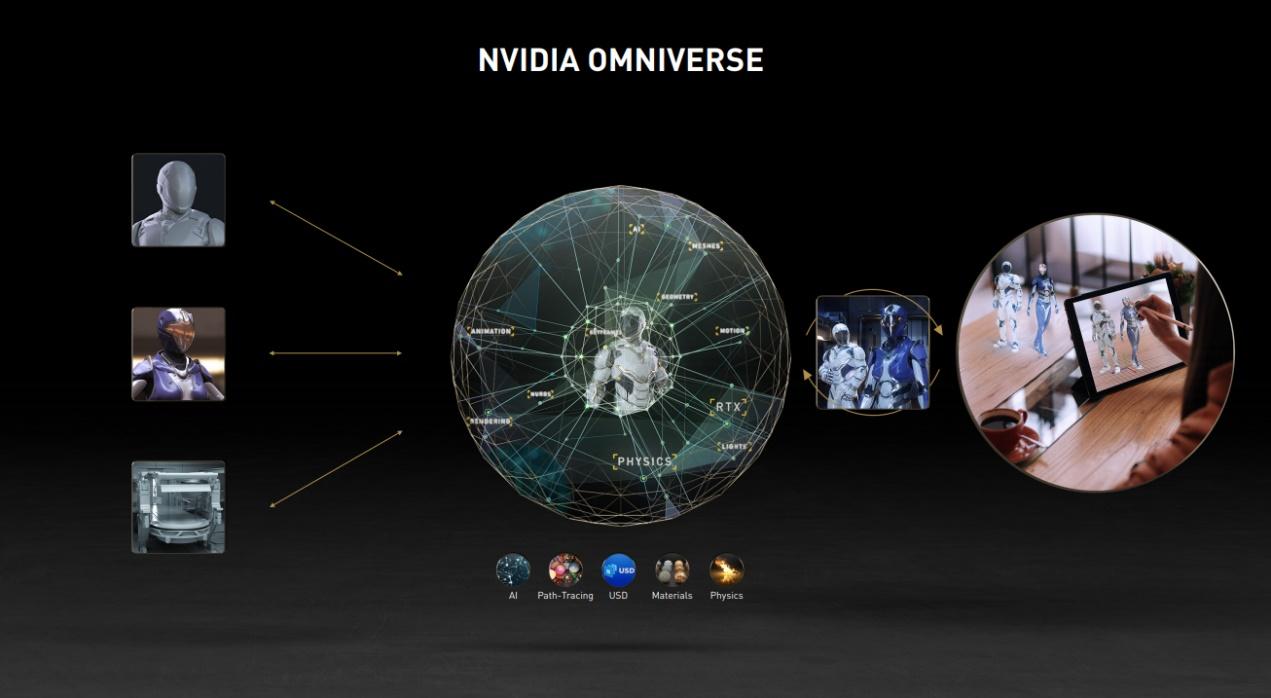

Omniverse的第二部分是合成、渲染和动画引擎,也就是对虚拟世界的模拟。这应该是前文提到了遵循现实世界各种物理性质的构成要素,也是英伟达在图形计算和AI领域这么多年来的经验集合:包括通过Nvidia PhysX模拟物理性质,通过Nvidia MDL模拟材质,并做Nvidia AI的全面集成。

第三部分则是Nvidia CloudXR。黄仁勋在GTC 2021上说:“如果你愿意,可将其用作‘星际之门’。用VR将内容传送到Omniverse中,而AI可以使用AR将内容从Omniverse传送出去。”这应该算是扩展的一种便捷途径。CloudXR本身作为英伟达应用于流VR/AR的解决方案,与Omniverse的结合,猜测在英伟达的规划中还是比较近期的事情。

以上每个不同的组成部分下属应当还有各种不同的组件和工具,比如说Omniverse Create用于加速场景组合,并且能够实时地、交互式地对场景做渲染、模拟、组合等;Omniverse View则是实现设计协作和建筑工程项目可视化的构成等等。

从游戏到现实世界

要在高度抽象下理清Omniverse究竟是什么,可以看看下面这张Omniverse平台结构图,里面还是有各种我们熟悉的组成部分,尤其在Omniverse平台之下实现图形、计算和AI的各种技术和组件;上层现阶段也有英伟达自己打造的各种应用。

应用这一层未来应当还会持续完善,就像元宇宙的不同组成模块一样。前文已经提到了其中的DRIVE Sim和Isaac Sim,分别是自动驾驶和机器人在Omniverse世界里的应用。这里再来简单地看两个例子,也能体现英伟达现阶段对元宇宙的构建程度。Machinima也是今年Computex上,英伟达着重谈到的一点。

Machinima一般是指使用实时图形引擎去打造电影、短片作品的方式。此前Quake、Doom引擎就被用来创作电影。《模拟人生》这款游戏在网上就有很多人用其素材来做成短片或者故事片的。Omniverse Machinima是为这种创作方式还加入了光线追踪和AI支持的应用。用户可以导入自己的游戏素材,或者从英伟达的库中提取素材。

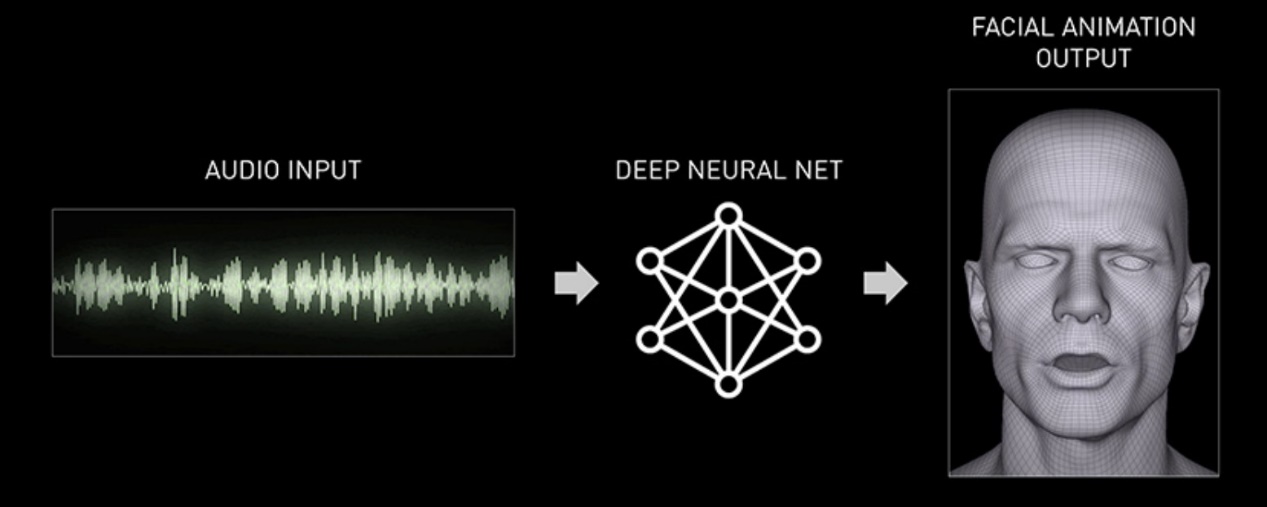

再比如Omniverse Audio2Face:这个应用是在仅有人声(音频)的情况下生成3D面部表达的应用。实时生成的3D形象,嘴巴就能与输入的音频完美匹配。而且可以调整参数,来丰富3D面部表达——比如自定义一个3D人脸(如用外星人3D形象),或者加入面部表情等等。这个应用也用上了某个预训练深度神经网络,输出的网络可以驱动3D形象面部的各个顶点做运动。

Audio2Face显然也能和Machinima一起来用,此前英伟达在GeForce 30系列发布会上其实就有这两个应用的联合演示。这些应当都是构建元宇宙的基石。更多创作者和开发者的加入,对这些Omniverse应用的使用和二次开发也是在完善这个构建过程。

这篇文章从相对抽象的角度谈了谈英伟达的Omniverse,以及英伟达对其的畅想。在实现其畅想的过程里,其实还有很多待解决的问题,毕竟罗马不是一天建成的。比如对于巨型数据集,达到城市构建级别的建模,USD该怎么发展——这是Digital Twin应用上遭遇的问题。而在设计协作应用方向,还有不同行业之间的协作其实也面临十分巨大的挑战,比如建筑公司,从工程师到咨询顾问,再到制造商的内容传递都是不简单的,存在很多需要解决的实际问题。这是此前在GTC会后圆桌上有嘉宾提到的。

像Omniverse这么庞大的工程,不知黄仁勋是何时发想的。不过最初英伟达是针对游戏做图形计算的公司——游戏原本就是虚拟世界,游戏大概有自己的元宇宙。游戏玩家在虚拟世界中寻找存在感。而现如今Omniverse要把这个虚拟世界以超大规模量级扩展开来,扩展到企业,甚至令其与现实世界并驾齐驱,对英伟达而言似乎也是一条顺理成章之路。我们期待这一天的到来。

责编:Luffy Liu

- 真tn的长