作者|Ta-Ying Cheng,牛津大学博士研究生,Medium技术博主,多篇文章均被平台官方刊物Towards Data Science收录

翻译|颂贤

关于格物钛

格物钛公开数据集提供海量优质公开数据集搜索、数据托管、一站式搜索,与全球AI开发者共创公开数据集社区。本文介绍的是以格物钛公开数据集平台中的CIFAR-10数据集为基础,通过数据增强方法Mixup,显著提升图像识别准确度。

深度学习蓬勃发展的这几年来,图像分类一直是最为火热的领域之一。传统上的图像识别严重依赖像是扩张/侵蚀或者是频域变换这样的处理方法,但特征提取的困难性限制了这些方法的进步空间。现如今的神经网络则显著提高了图像识别的准确率,因为神经网络能够寻找输入图像和输出标签之间的关系,并以此不断地调整它的识别策略。

然而,神经网络往往需要大量的数据进行训练,而优质的训练数据并不是唾手可得的。因此现在许多人都在研究如何能够实现所谓的数据增强(Data augmentation),即在一个已有的小数据集中凭空增加数据量,来达到以一敌百的效果。本文就将带大家认识一种简单而有效的数据增强策略Mixup,并介绍直接在PyTorch中实现Mixup的方法。

神经网络架构内的参数是根据给定的数据进行训练和更新的。但由于训练数据只覆盖了某一部分可能数据的分布情况,网络很可能就会在分布的“能见”部分过度拟合。因此,我们拥有的训练数据越多,理论上就越能覆盖整个分布的情况(这也正是为什么以数据为中心的AI(data-centric AI)非常重要)。当然,在数据量有限的情况下,我们也并不是没有办法。通过数据增强,我们就可以尝试通过微调原有数据的方式产生新数据,并将其作为“新”样本送入网络进行训练。

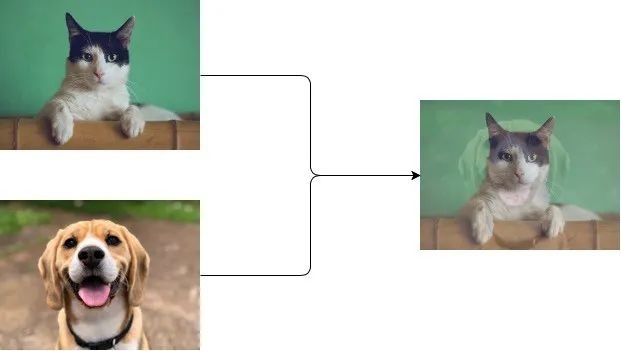

图1:Mixup的简易演示图

假设我们现在要做的事情是给猫和狗的图片做分类,并且我们已经有了一组标注好了是猫是狗的数据(例如[1, 0] -> 狗, [0, 1] -> 猫),那么Mixup简单来说就是将两张图像及其标签平均化为一个新数据。

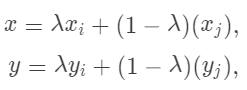

具体而言,我们可以用数学公式写出Mixup的概念:

其中,x和y分别是混合xi(标签为yᵢ)和xⱼ(标签为yⱼ)后的图像和标签,而λ则是从给定的贝塔分布中取得的随机数。

由此,Mixup能够为我们提供不同数据类别之间的连续数据样本,并因此直接扩大了给定训练集的分布,从而使网络在测试阶段更加强大。

Mixup其实只是一种数据增强方法,它和任何用于分类的网络架构都是正交的。也就是说,我们可以在任何要进行分类任务的网络中对相应的数据集使用Mixup方法。Mixup的提出者张宏毅等人基于其最初发表的论文《mixup: Beyond Empirical Risk Minimization》对多个数据集和架构进行了实验,发现了Mixup在神经网络之外的应用中也能体现其强大能力。

我们将通过PyTorch(包括torchvision)来构建整个程序。Mixup需要的从beta分布中生成的样本,我们可以从NumPy库中获得。我们还将使用random来为Mixup寻找随机图像。下面的代码能够导入我们需要的所有库:

"""

Import necessary libraries to train a network using mixup

The code is mainly developed using the PyTorch library

"""

import numpy as np

import pickle

import random

import torch

import torch.nn as nn

import torch.nn.functional as F

import torchvision

import torchvision.transforms as transforms

from torch.utils.data import Dataset, DataLoader

为了演示,我们将用传统的图像分类任务来说明Mixup的强大,那么这种情况下CIFAR-10则会是非常理想的数据集。CIFAR-10包含10个类别的60000张彩色图像(每类6000张),按5:1的比例分为训练和测试集。这些图像分类起来相当简单,但比最基本的数字识别数据集MNIST要难一些。

有许多方法可以下载CIFAR-10数据集,比如多伦多大学网站里就包含了相关数据集。在这里,我推荐大家使用格物钛的公开数据集平台(graviti.cn/open-datasets),因为在这个平台上,如果使用他们的SDK,不用下载也可以获取免费的数据集资源。事实上,这个公开数据集平台包含了行业内数百个知名的优质数据集,每个数据集都有相关的作者说明,以及不同训练任务的标签,例如分类或目标检测。当然,大家也可以在这个平台下载其他分类数据集,如CompCars或SVHN,来测试Mixup在不同场景下的性能。

一般来说,我们最好用GPU(显卡)来训练神经网络,因为它能显著提高训练速度。不过如果只有CPU可用,我们还是可以对程序进行简单测试的。如果你想让程序能够自行确定所需硬件,使用以下代码即可:

"""

Determine if any GPUs are available

"""

device = torch.device('cuda' if torch.cuda.is_available() else 'cpu')

这里,我们的目标是要测试Mixup的性能,而不是调试网络本身,所以我们只需要简单实现一个4层卷积层和2层全连接层的卷积神经网络(CNN)即可。为了比较使用和不使用Mixup的区别,我们将应用同一个网络来确保比较的准确性。

我们可以使用下列代码来搭建上面所说的简单网络:

"""

Create a simple CNN

"""

class CNN(nn.Module):

def __init__(self):

super(CNN, self).__init__()

# Network consists of 4 convolutional layers followed by 2 fully-connected layers

self.conv11 = nn.Conv2d(3, 64, 3)

self.conv12 = nn.Conv2d(64, 64, 3)

self.conv21 = nn.Conv2d(64, 128, 3)

self.conv22 = nn.Conv2d(128, 128, 3)

self.fc1 = nn.Linear(128 * 5 * 5, 256)

self.fc2 = nn.Linear(256, 10)

def forward(self, x):

x = F.relu(self.conv11(x))

x = F.relu(self.conv12(x))

x = F.max_pool2d(x, (2,2))

x = F.relu(self.conv21(x))

x = F.relu(self.conv22(x))

x = F.max_pool2d(x, (2,2))

# Size is calculated based on kernel size 3 and padding 0

x = x.view(-1, 128 * 5 * 5)

x = F.relu(self.fc1(x))

x = self.fc2(x)

return nn.Sigmoid()(x)

Mixup阶段是在数据集加载过程中完成的,所以我们必须写入我们自己的数据集,而不是使用torchvision.datasets所提供的默认数据集。

下面的代码简单地实现了Mixup,并结合使用了NumPy的贝塔函数。

"""

Dataset and Dataloader creation

All data are downloaded found via Graviti Open Dataset which links to CIFAR-10 official page

The dataset implementation is where mixup take place

"""

class CIFAR_Dataset(Dataset):

def __init__(self, data_dir, train, transform):

self.data_dir = data_dir

self.train = train

self.transform = transform

self.data = []

self.targets = []

# Loading all the data depending on whether the dataset is training or testing

if self.train:

for i in range(5):

with open(data_dir + 'data_batch_' + str(i+1), 'rb') as f:

entry = pickle.load(f, encoding='latin1')

self.data.append(entry['data'])

self.targets.extend(entry['labels'])

else:

with open(data_dir + 'test_batch', 'rb') as f:

entry = pickle.load(f, encoding='latin1')

self.data.append(entry['data'])

self.targets.extend(entry['labels'])

# Reshape it and turn it into the HWC format which PyTorch takes in the images

# Original CIFAR format can be seen via its official page

self.data = np.vstack(self.data).reshape(-1, 3, 32, 32)

self.data = self.data.transpose((0, 2, 3, 1))

def __len__(self):

return len(self.data)

def __getitem__(self, idx):

# Create a one hot label

label = torch.zeros(10)

label[self.targets[idx]] = 1.

# Transform the image by converting to tensor and normalizing it

if self.transform:

image = transform(self.data[idx])

# If data is for training, perform mixup, only perform mixup roughly on 1 for every 5 images

if self.train and idx > 0 and idx%5 == 0:

# Choose another image/label randomly

mixup_idx = random.randint(0, len(self.data)-1)

mixup_label = torch.zeros(10)

label[self.targets[mixup_idx]] = 1.

if self.transform:

mixup_image = transform(self.data[mixup_idx])

# Select a random number from the given beta distribution

# Mixup the images accordingly

alpha = 0.2

lam = np.random.beta(alpha, alpha)

image = lam * image + (1 - lam) * mixup_image

label = lam * label + (1 - lam) * mixup_label

return image, label

需要注意的是,我们并没有对所有的图像都进行Mixup,而是大概每5张处理1张。我们还使用了一个0.2的贝塔分布。你可以自己为不同的实验改变分布以及被混合的图像的数量,或许你会取得更好的结果!

下面的代码展示的是训练过程。我们将批次大小设置为128,学习率为1e-3,总次数为30次。整个训练进行了两次,唯一区别是有没有使用Mixup。需要注意的是, 损失函数需要由我们自己定义,因为目前BCE损失不允许使用带有小数的标签。

"""

Initialize the network, loss Adam optimizer

Torch BCE Loss does not support mixup labels (not 1 or 0), so we implement our own

"""

net = CNN().to(device)

optimizer = torch.optim.Adam(net.parameters(), lr=LEARNING_RATE)

def bceloss(x, y):

eps = 1e-6

return -torch.mean(y * torch.log(x + eps) + (1 - y) * torch.log(1 - x + eps))

best_Acc = 0

"""

Training Procedure

"""

for epoch in range(NUM_EPOCHS):

net.train()

# We train and visualize the loss every 100 iterations

for idx, (imgs, labels) in enumerate(train_dataloader):

imgs = imgs.to(device)

labels = labels.to(device)

preds = net(imgs)

loss = bceloss(preds, labels)

optimizer.zero_grad()

loss.backward()

optimizer.step()

if idx%100 == 0:

print("Epoch {} Iteration {}, Current Loss: {}".format(epoch, idx, loss))

# We evaluate the network after every epoch based on test set accuracy

net.eval()

with torch.no_grad():

total = 0

numCorrect = 0

for (imgs, labels) in test_dataloader:

imgs = imgs.to(device)

labels = labels.to(device)

preds = net(imgs)

numCorrect += (torch.argmax(preds, dim=1) == torch.argmax(labels, dim=1)).float().sum()

total += len(imgs)

acc = numCorrect/total

print("Current image classification accuracy at epoch {}: {}".format(epoch, acc))

if acc > best_Acc:

best_Acc = acc

为了评估Mixup的效果,我们进行了三次对照试验来计算最终的准确性。在没有Mixup的情况下,该网络在测试集上的准确率约为74.5%,而在使用了Mixup的情况下,准确率提高到了约76.5%!

Mixup将图像分类的准确性带到了一个前所未有的高度,但研究表明,Mixup的好处还能延伸到其他计算机视觉任务中,比如对抗性数据的生成和防御。另外也有相关文献在Mixup拓展到三维表示中,目前的结果表明Mixup在这一领域也十分有效的,例如PointMixup(arxiv.org/abs/2008.06374)。

由此,我们用Mixup做的小实验就大功告成啦!在这篇文章中,我们简单介绍了Mixup的概念并演示了如何在图像分类网络训练中应用Mixup。完整的实现方式可以在这—GitHub仓库(github.com/ttchengab/mixup.git)中找到。

Open Datasets

格物钛 | 公开数据集

graviti.cn | open-datasets

订阅号 :格物钛

微博 | | 格物钛

https://www.graviti.cn/