嘉楠科技发布高性能图像及语音处理AI芯片勘智K510 原文:

https://mp.weixin.qq.com/s/c_k0gs686L7zAzqw-n-amQ

7月8日,嘉楠科技正式发布AI芯片勘智K510。该芯片定位于中高端边缘推理市场,搭载自主研发IP核的升级版本KPU2.0,采用独创计算数据流与复用方式,在算力提升3倍的同时降低芯片功耗。K510集成新一代图像处理单元,搭载3D ISP,支持TOF深度摄像头,以及2D/3D降噪、WDR宽动态、鱼眼矫正和硬件3A等功能。在应用方面,K510支持高清视频会议、高清航拍和机器人等边缘侧场景。 K510在总线架构、IP核心与视频子系统推出全新设计,相比一代芯片算力提升3倍,经典视觉算法大幅度优化,自研高速PHY接口理论带宽10GB/s,8位数据压缩率50%以上,极大优化了勘智AI系列在机器视觉场景的应用性能。 中国最大AI芯片问世!能组建一个顶级超算集群 原文:

https://finance.sina.com.cn/tech/2021-07-07/doc-ikqciyzk4098759.shtml

今天,中国最大AI单芯片邃思2.0在上海正式发布,这款芯片面向AI云端训练,尺寸为57.5毫米 x 57.5毫米(面积为3306mm2),达到了芯片采用的日月光2.5D封装的极限,与上代产品一样采用格罗方德12nm工艺,单精度FP32算力为40TFLOPS,单精度张量TF32算力为160TFLOPS,整数精度INT8算力为320TOPS。 燧原科技创始人兼 COO 张亚林告诉雷锋网(公众号:雷锋网):“基于邃思2.0芯片打造的云燧T20加速卡支持的集群规模从上一代云燧T10的千张卡提升至8000卡,用云燧T20可以打造一个E级单精度算力集群CloudBlazer Matrix 2.0。 苹果M1更适合强化学习?相比V100性能提升200%,价格低90%,功耗减88% 原文:

https://www.jiqizhixin.com/articles/2021-07-01-5

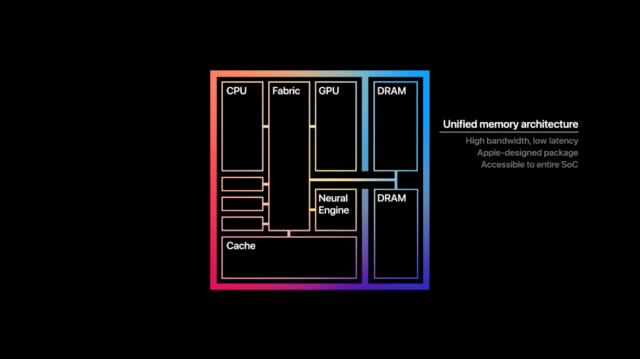

2020 年底,苹果发布了 M1 芯片,提供了全新的自研 GPU,并和 CPU 集成封装成 SoC,加上随之而来的 ML Compute 框架,macOS 端的深度学习训练有了显著的速度提升。 另一方面,强化学习的特性使得训练过程中需要交替使用 CPU 和 GPU,对此,M1 芯片能否提升强化学习的训练效率?据了解,此前业界并无相关测试数据。 南栖仙策(南京大学人工智能创新研究院技术孵化企业)算法小组用 M1 芯片设备组建小型服务器集群,并与基于 NVIDIA GPU 的传统服务器进行性能对比测试,结果表明,强化学习的训练效率可以得到显著提升。 AI都会写灵魂Rap了?Transformer跨界说唱,节奏、流畅度都不在话下 原文:

https://www.jiqizhixin.com/articles/2021-07-08-6

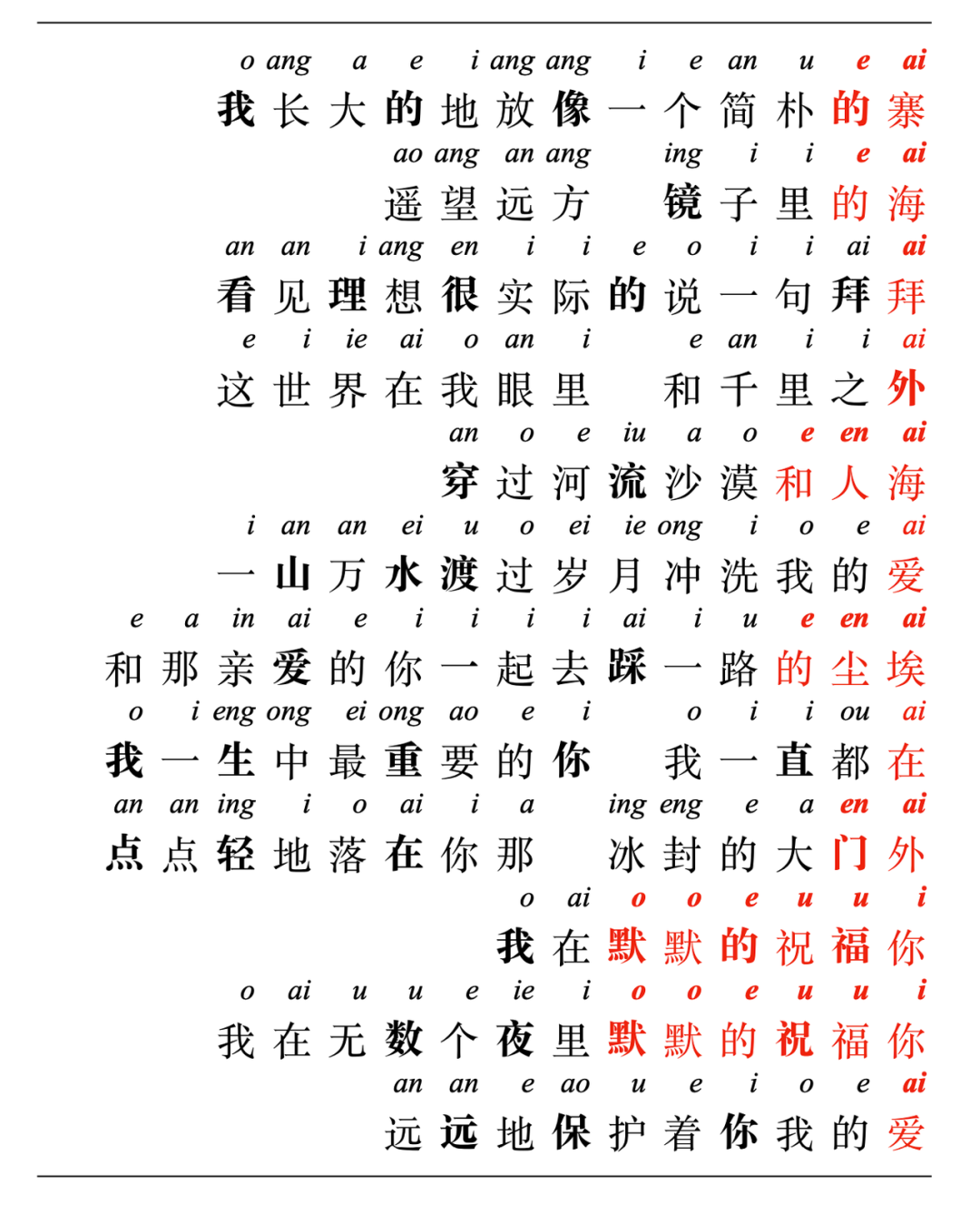

Rapper 要酝酿一整天的歌词,AI 或许几分钟就能写出来。

给你一段 Rap,你能看出这是 AI 写的吗?

只需要给定一句输入,AI 就能生成整首歌词。从押韵、流畅度、节奏方面,基本不逊于人类 Rapper。 这项研究来自港科大、清华、复旦等机构,在这篇论文中,研究者提出了一个基于 Transformer 的 Rap 生成系统「DeepRapper」,该系统可以同时模拟 Rap 的韵律和节奏。 2021世界人工智能大会来了,马化腾、李彦宏、董明珠、周鸿祎等大佬都说了啥? 原文:

https://mp.weixin.qq.com/s/FQXiS7pRN3y6MsVa3pLgOg

7月8日,以 “智联世界·众智成城” 为主题的2021世界人工智能大会在上海召开。此前,世界人工智能大会已成功举办了三届。 本届大会依旧汇聚了顶级科学家、企业家、政府官员、专家学者、国际组织、投资人、初创团队等,从人工智能的新产品、应用场景、数字信息安全等多个方面,探讨了人工智能的发展前景。 今日上午,参与发言的主要嘉宾包括腾讯公司董事会主席兼首席执行官马化腾、百度创始人李彦宏、格力集团董事长董明珠、360集团创始人周鸿祎、红杉资本全球执行合伙人沈南鹏等。 数十亿行代码训练,GitHub原生AI代码生成工具上线,网友:要终结编程? 原文:

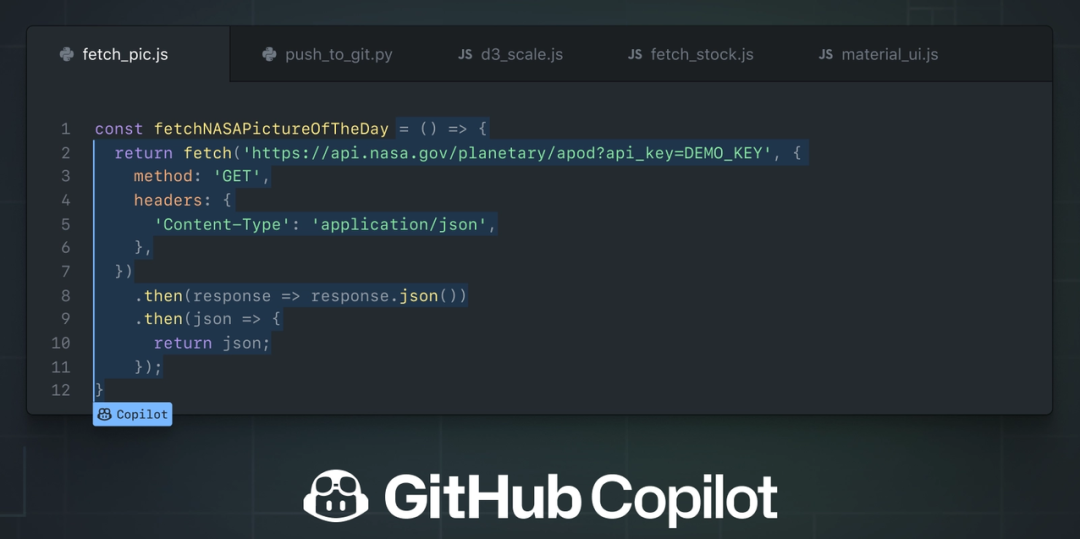

https://www.jiqizhixin.com/articles/2021-06-30-9

GitHub Copilot 是一个 AI 代码合成器,并不是搜索引擎:它提出的绝大多数代码建议都是新生成的,此前从未出现过。 在项目开发中,优秀的代码自动补全工具可以提升工作效率。然而,传统的 IDE 基本都使用搜索方法进行补全,在一些场景下效果不佳。 今日,GitHub 和 OpenAI 联合发布了新的 AI 代码补全工具 GitHub Copilot,并展示了技术预览版。该工具可以在 VS Code 编辑器中自动完成代码片段,这也是 OpenAI 接受微软 10 亿美元投资以来的首个重大成果。 CVPR 2021 | 视觉目标检测大模型GAIA:面向行业的视觉物体检测一站式解决方案 原文:

https://www.jiqizhixin.com/articles/2021-07-08-8

论文地址:

https://arxiv.org/pdf/2106.11346.pdf

开源框架:

https://github.com/GAIA-vision

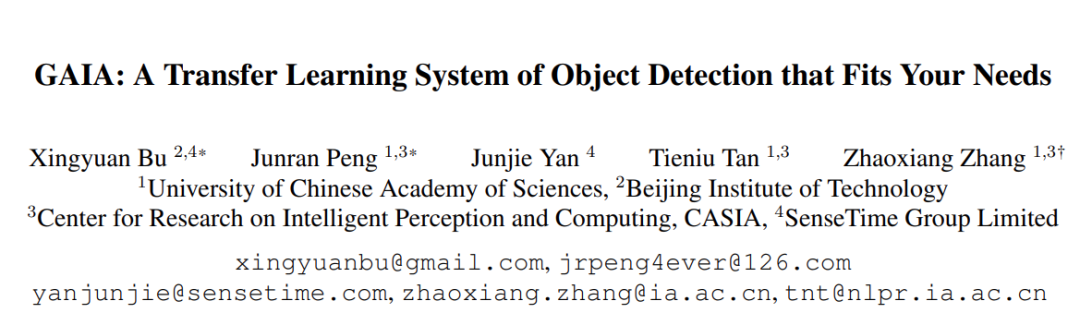

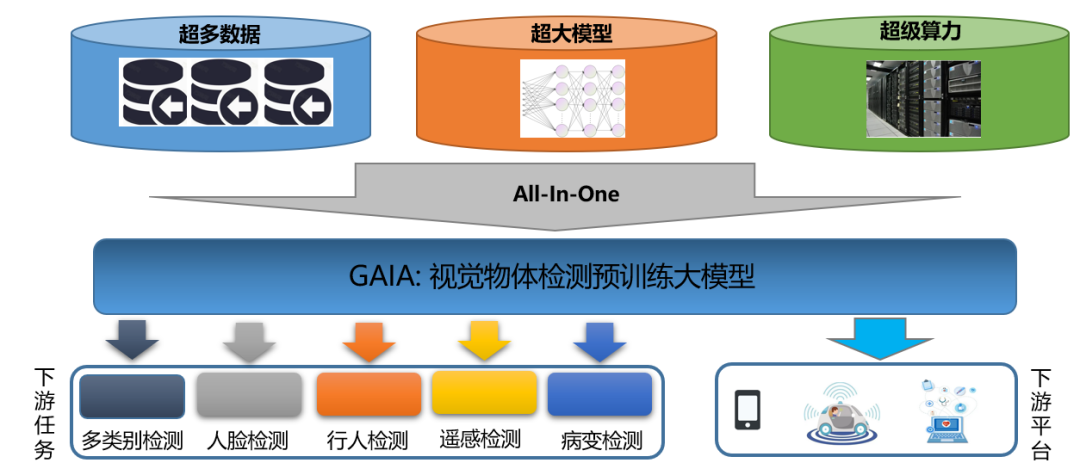

在深度学习与大数据的浪潮下,视觉目标检测在各个基准数据集上已经达到了优异的性能。中国科学院自动化研究所智能感知与计算研究中心联合华为等企业提出面向行业的视觉物体检测一站式解决方案 GAIA。通过 GAIA,用户可轻松获得不同硬件环境下的可直接用于部署的目标检测模型。GAIA 致力于构建一种生态,它以目标检测为基础,后续将会开枝散叶扩展到更多领域,期望更多的学者和用户共同维护 GAIA 的迭代,参与到 GAIA 社区中。该研究的论文已被 CVPR 2021接收。 无需额外数据,首次实现ImageNet 87.1% 精度,颜水成团队开源VOLO 原文:

https://www.jiqizhixin.com/articles/2021-07-06

论文地址:

https://arxiv.org/pdf/2106.13112.pdf

https://github.com/sail-sg/volo

VOLO 是第一个在 ImageNet 上无需额外数据达到 87.1% top-1 准确率的模型,进一步拉近了视觉 Transformer 与最顶级 CNN 模型的性能距离。 近十年来,计算机视觉识别任务一直由卷积神经网络 (CNN) 主导。尽管最近流行的视觉 Transformer 在基于 self-attention 的模型中显示出巨大的潜力,但是在没有提供额外数据的情况下,比如在 ImageNet 上的分类任务,它们的性能仍然不如最新的 SOTA CNNs。目前,在无额外数据集时,ImageNet 上的最高性能依旧是由 Google DeepMind 提出的 NFNet (Normalizer-Free Network)所获得。

STM32的“GPU”——DMA2D实例详解 原文:

https://mp.weixin.qq.com/s/9uDebenSqGEW2Uuiv-tSCw

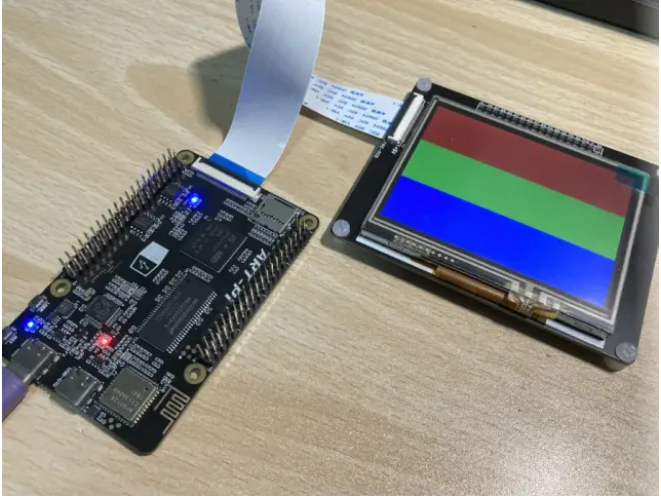

GPU即图形处理器,是现代显卡的核心。在没有GPU的时代,所有图形的绘制都是由CPU来完成的,CPU需要计算图形的边界、颜色等数据,并且负责将数据写入显存。简单的图形还没有什么问题,但随着计算机的发展(尤其是游戏的发展),需要显示的图形图像越来越复杂,CPU也就越来越力不从心。所以后来GPU应运而生,将CPU从繁重的图形计算任务中拯救了出来,大大加速了图形的显示速度。 而单片机这边也有类似的发展历程。在早期的单片机使用场景中,极少有图形显示的需求。即使有,也只是简单的12864之类的显示设备,运算量不大,单片机的CPU可以很好的处理。但是随着嵌入式图形的发展,单片机需要承担的图形计算和显示任务越来越多,嵌入式系统的显示分辨率和色彩也一路飙升。慢慢地,单片机的CPU对这些计算就开始力不从心了。所以,自STM32F429开始,一个类似GPU的外设开始加入到STM32的单片机中,ST称之为Chrom-ART Accelerator,也叫DMA2D(本文将使用此名称)。DMA2D可以在很多2D绘图的场合提供加速,完美嵌合了现代显卡中“GPU”的功能。 虽然这个“GPU”只能提供2D加速,而且功能非常简单,与PC中的GPU不可同日而语。但是它已经可以满足大多数嵌入式开发中的图形显示加速需求,只要用好了DMA2D,我们在单片机上也可以做出流畅、华丽的UI效果。 本文将从实例出发,介绍DMA2D在嵌入式图形开发中的可以发挥的作用。目的是使读者能简单、快速地对DAM2D的建立最基本的概念并且学会最基本的用法。为了防止内容过于晦涩和难懂,本文不会对DMA2D的高级功能和特性进行深入地刨析(如详细介绍DMA2D的架构、全部的寄存器等等)。如果需要更加详细、专业地学习DAM2D,可以在阅读完本文后参考《STM32H743中文编程手册》。 阅读本文之前需要对STM32中的TFT液晶控制器(LTDC)和基本的图形知识(如帧缓冲framebuffer、像素、颜色格式等概念)有一定的了解。 另,除了ST之外,其他不少厂商生产的MCU中也存在类似功能的外设(如NXP在RT系列中设计的的PxP),不过这些不在本文的讨论范围内,有兴趣的朋友可以自行了解。

你可以添加微信17775982065为好友,注明:公司+姓名,拉进 RT-Thread 官方微信交流群!

👇 点击阅读原文进入官网