----追光逐电 光引未来----

本文转自公众号:人形机器人洞察研究,专注于人形机器人&具身智能行业研究和咨询分享。

文章出于学术/技术分享进行转载,如有侵权,联系删文。

原文链接:https://mp.weixin.qq.com/s/AI0iHulI76JeA9oAJv1L1Q

英伟达创始人兼CEO黄仁勋为CES2025做开幕演讲,带领14款生态人形机器人产品精彩亮相。在英伟达公布的14家合作人形机器人公司中,中国厂商占据6席,包括宇树科技、智元机器人与傅利叶3家独角兽公司,以及小鹏汽车、银河通用、星动纪元。其中,宇树科技H1是一台具备奔跑能力的全尺寸通用人形机器人,集成双足行走、先进运动控制技术、多种传感器和AI算法等,小鹏汽车的“老铁”是一款身高178厘米、重70公斤、拥有62个主动自由度的A!机器人,可模仿人类动作并进行自然对话;傅利叶的GR-2全身自由度达53个,单臂运动负载达3kg,搭载12自由度自研灵巧手及第二代执行器,续航两小时并新增换电方案。

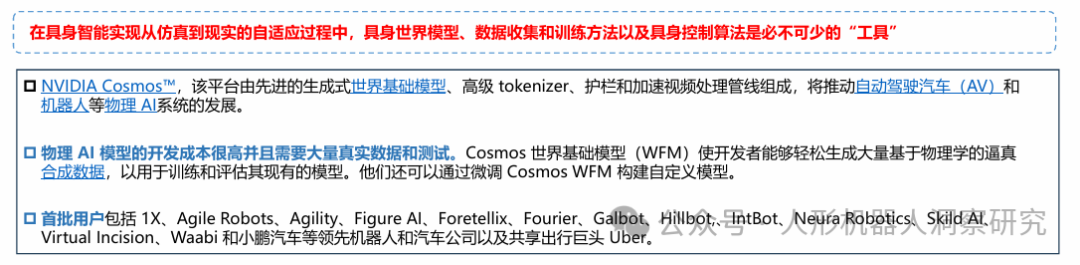

英伟达同时宣布推出“世界基础模型”NVIDIA Cosmos。Cosmos模型可以接受文本、图像或视频的提示,生成虚拟世界状态,作为针对自动驾驶和机器人应用独特需求的视频输出。开发人员可以利用Cosmos为强化学习生成AI反馈,从而改善策略模型并测试在不同场景下的性能。黄仁勋表示,通过Cosmos,开发人员可以使用0mniverse创建三维场景,然后使用Cosmos将其转换为照片级逼真的场景,再通过同时生成多个模型,帮助机器人找到完成任务的最佳方法,从而实现机器人更快学习和进步。

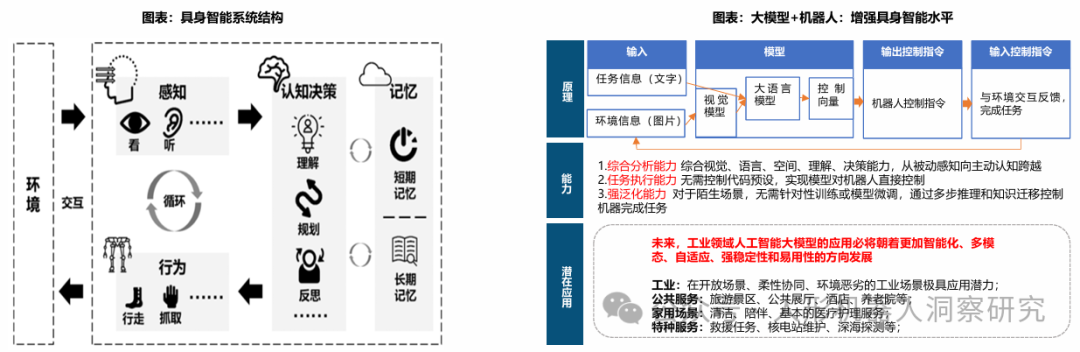

机器人相关软硬件技术渐趋成熟,大模型+具身智能打开人形机器人产业成长空间。星动纪元创始人、清华大学交叉信息研究院助理教授陈建宇表示,现在人形机器人最大的技术瓶颈是具身智能。根据智源研究院发布的2025十大AI技术趋势,2025年的具身智能(包括人形机器人),将继续从本体扩展到具身脑的叙事主线。在行业格局上,近百家具身初创企业或将迎来洗牌,厂商数量开始逐步收敛;在技术路线上,端到端模型继续迭代,小脑大模型的尝试或有突破;在商业变现上,将看到更多工业场景下的具身智能应用,部分人形机器人迎来量产。

01

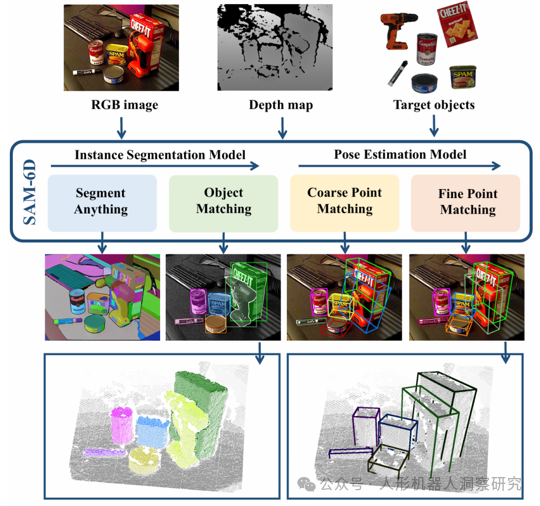

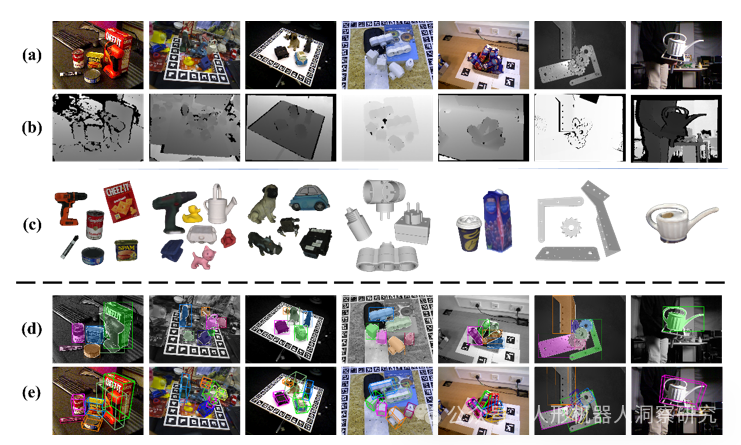

跨维智能:SAM-6D

应用场景

02

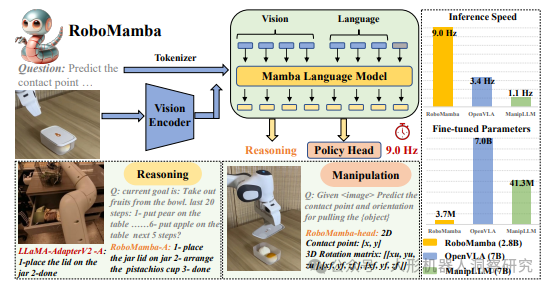

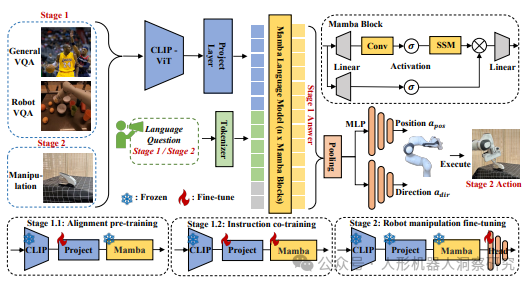

智平方 & 北京大学:RoboMamba

应用场景:RoboMamba适用于多种机器人任务,包括任务规划、长程任务规划、可操纵性判断、未来与过去预测以及末端执行器位姿预测等

03

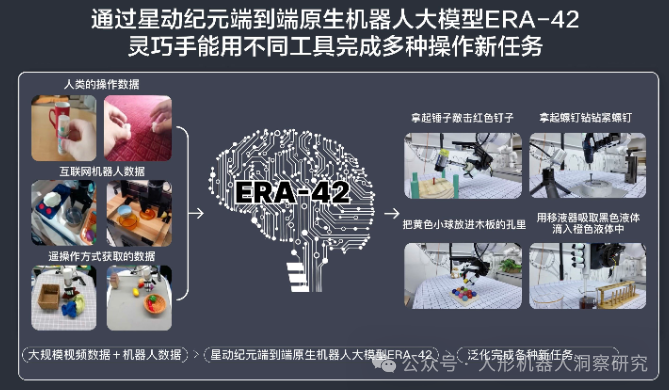

星动纪元:ERA-42

在通用性和灵巧操作能力方面,ERA-42无需任何预编程技能,具备强泛化与自适应能力,基于少量数据收集,可在不到2小时即可学会新任务,并持续快速学习更多新技能。

星动纪元指出,具身大模型作为开启通用具身智能体的密钥,需要具备以下三个要素。第一,统一一个模型泛化多种任务和环境,第二是端到端,从接收全模态数据,到生成最终输出如决策、动作等,通过一个简洁的神经网络链路完成,第三是Scaling up(规模化),允许模型通过持续的数据积累实现自我完善,使得具身大模型在数据量指数级增长的同时,不仅提升性能,还能在未知任务中展现卓越的自适应和泛化能力。

在实际应用中,相比传统的夹爪机器人,基于ERA-42能力的五指灵巧手星动XHAND1能使用多种工具,完成更通用、灵巧性更强、复杂度更高的操作任务。例如,通过简单的彩色方块抓取数据训练后,ERA-42就能成功实现从未见过的多样化物体的抓取泛化。

04

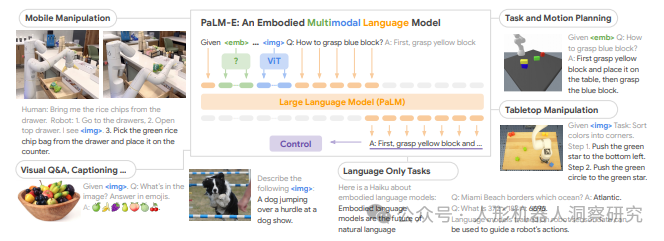

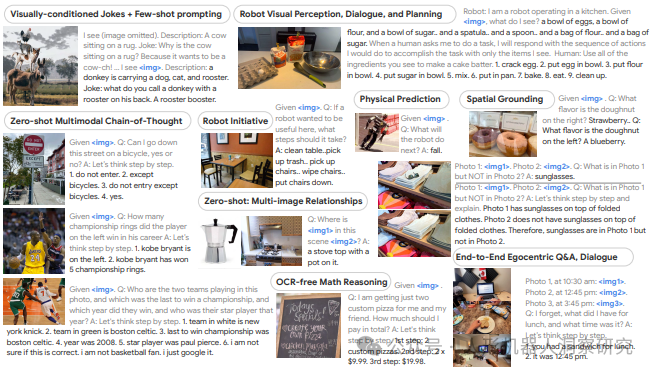

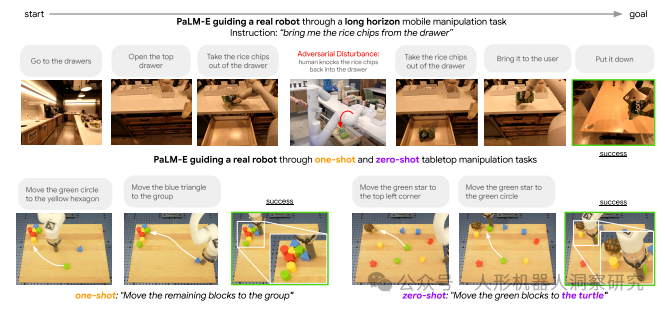

Google & 柏林技术大学:PaLM-E

PaLM-E(全称:Pathways Language Model with Embodied)是由Google和柏林技术大学(TU Berlin)合作开发的一种具身多模态语言模型,旨在通过融合视觉、语言和机器人控制能力,实现复杂的机器人任务。PaLM-E的研究成果于2023年3月发布。

项目主页:https://palm-e.github.io/

跨模态迁移能力:PaLM-E通过多模态训练,展示了从语言、视觉到具身任务的正向迁移能力。它不仅在机器人任务上表现出色,还在视觉问答(VQA)等任务上达到了最先进的性能

05

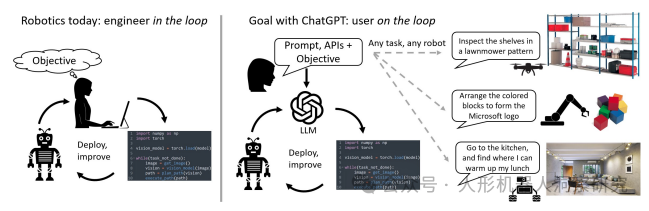

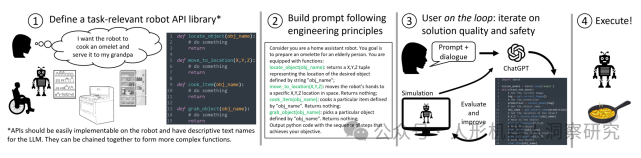

Microsoft:ChatGPT for Robotics

ChatGPT for Robotics是由微软自主系统和机器人研究院(Microsoft Autonomous Systems and Robotics Research)与OpenAI合作开发的一个研究项目,旨在探索如何将ChatGPT应用于机器人任务,通过自然语言交互实现机器人控制和任务规划。

设计原则与能力:该项目提出了结合提示词工程(prompt engineering)和高级函数库的设计原则,使ChatGPT能够适应不同的机器人任务、模拟器和硬件形态。研究重点在于评估不同提示词技术和对话策略在机器人任务中的有效性。

多模态交互能力:ChatGPT for Robotics不仅支持自由对话形式,还能解析XML标签、合成代码,并通过对话进行闭环推理。这些能力使其能够处理从基础逻辑、几何和数学推理到复杂任务(如空中导航、操作和具身代理)的多种机器人任务。

应用范围ChatGPT for Robotics的应用范围广泛,包括但不限于:

空间-时间推理:如视觉伺服任务

06

NVIDIA Cosmos 世界基础模型平台

NVIDIA Cosmos 是由英伟达推出的一个面向物理 AI(Physical AI)开发的具身大模型平台,旨在通过生成式世界模型(World Foundation Models, WFM)加速机器人和自动驾驶汽车等物理 AI 系统的开发。

辅助模型(Utility Models):如 Cosmos-1.0-Guardrail 和 Cosmos-1.0-PromptUpsampler-12B-Text2World,用于提升提示质量和生成内容的安全性。

应用场景

增强现实(AR):支持视频解码和增强现实应用

07

银河通用:GraspVLA

GraspVLA是由银河通用机器人联合北京智源人工智能研究院(BAAI)、北京大学和香港大学研究人员共同发布的全球首个端到端具身抓取基础大模型。该模型完全基于仿真合成大数据进行预训练,展现出强大的泛化能力和真实场景应用潜力。

技术创新:GraspVLA是全球首个完全基于仿真合成大数据进行预训练的具身大模型。这一创新突破了具身通用机器人领域的两大瓶颈:数据瓶颈和泛化瓶颈

08

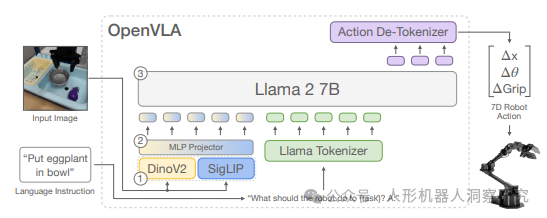

斯坦福 & Google等:OpenVLA

OpenVLA 是一个开源的视觉-语言-动作(Vision-Language-Action, VLA)模型,由斯坦福大学、加州大学伯克利分校、谷歌DeepMind、丰田研究院(Toyota Research Institute)和麻省理工学院(MIT)的研究人员联合开发。该模型旨在通过预训练的视觉和语言基础模型(VLMs),为机器人提供泛化能力强的动作生成能力,从而推动机器人技术的发展。

应用范围:OpenVLA 可以在多种机器人平台上直接使用,支持零样本(zero-shot)控制,也可以通过少量演示数据进行微调以适应新任务。它特别适用于需要泛化能力的机器人操作任务,如物体抓取、环境交互等

高效微调:支持多种微调方式,包括LoRA(低秩适配)和全参数微调

09

UC 伯克利 & 斯坦福等:Octo

Octo 是由加州大学伯克利分校、斯坦福大学、卡内基梅隆大学和谷歌DeepMind等机构联合开发的开源通用机器人策略(Generalist Robot Policy)。它是一个基于Transformer架构的具身大模型,旨在通过大规模预训练数据提升机器人在多种任务和环境中的泛化能力。Octo 的预训练数据来自Open X-Embodiment数据集,涵盖了多种机器人形态、场景和任务。这些数据不仅在机器人类型上具有多样性,还在传感器配置(如是否包含腕部相机)和标签(如是否包含语言指令)上表现出异质性。

项目主页:https://octo-models.github.io/

多机器人支持:支持多种机器人平台,无需为每个平台重新训练

10

谷歌 DeepMind:RT-2

RT-2(Robotic Transformer 2)是由谷歌 DeepMind 推出的一种新型视觉-语言-动作(Vision-Language-Action, VLA)模型,旨在通过大规模互联网数据和机器人轨迹数据的结合,提升机器人控制的泛化能力和语义推理能力。

实时推理与部署:为了实现高效的实时控制,RT-2 可以部署在云端,机器人通过云服务请求控制指令,从而实现快速响应

涌现能力:模型能够执行复杂的推理任务,例如根据用户指令选择合适的工具或饮料。

实时控制:通过云端部署实现高效的实时机器人控制

11

Physical intelligence:π0

π₀ 是由 Physical Intelligence 公司开发的一种具身大模型,旨在通过视觉-语言-动作(Vision-Language-Action, VLA)流模型实现通用机器人控制。该模型展示了强大的泛化能力和实时推理能力,能够完成复杂的多阶段任务,如叠衣服、清理餐桌和组装盒子。

项目主页:Physical Intelligence π₀ Blog

多机器人适配:π₀ 可以直接控制多种机器人平台,无需为每个平台重新训练

训练方法:π₀ 使用条件流匹配损失(Conditional Flow Matching)来监督动作的生成。

多机器人适配:通过微调适应不同的机器人平台

12

清华TSAIL团队:RDT

RDT(Robotics Diffusion Transformer)是由清华大学人工智能研究院 TSAIL 团队开发的全球最大的双臂机器人操作任务扩散基础模型。该模型旨在通过扩散模型(Diffusion Model)和可扩展的 Transformer 架构,提升机器人在复杂环境中的双臂协调与精确操作能力。

Hugging Face 模型库:https://huggingface.co/robotics-diffusion-transformer/rdt-1b

应用场景:RDT 在多种复杂任务中表现出色,例如调酒、遛狗、倒水、清洗杯子等。这些任务展示了 RDT 的灵巧操作能力、指令遵循能力和对未知环境的适应性

申明:感谢原创作者的辛勤付出。本号转载的文章均会在文中注明,若遇到版权问题请联系我们处理。

----与智者为伍 为创新赋能----

联系邮箱:uestcwxd@126.com

QQ:493826566