第一阶段:芯片算力不足,神经网络没有被受到重视

在早期,受限于芯片算力,复杂的神经网络模型难以实现。这一时期的 AI 主要依赖于专家系统、决策树等传统方法。神经网络虽然在理论上已经被提出,但由于计算资源的匮乏,难以训练出有效的模型,因此没有受到广泛重视。

第二阶段:CPU 算力大幅提升,但仍然无法满足神经网络增长需求

随着摩尔定律的推进,CPU 性能不断提升。这为神经网络的发展提供了一定的计算基础。研究者们开始尝试更大规模的神经网络,并在一些领域取得了突破。但是,神经网络对算力的需求呈指数级增长,单纯依靠 CPU 的性能提升已经难以满足日益复杂的模型训练需求。

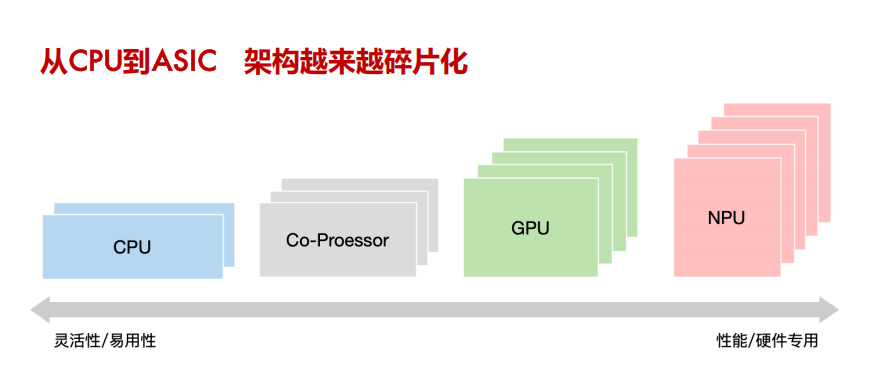

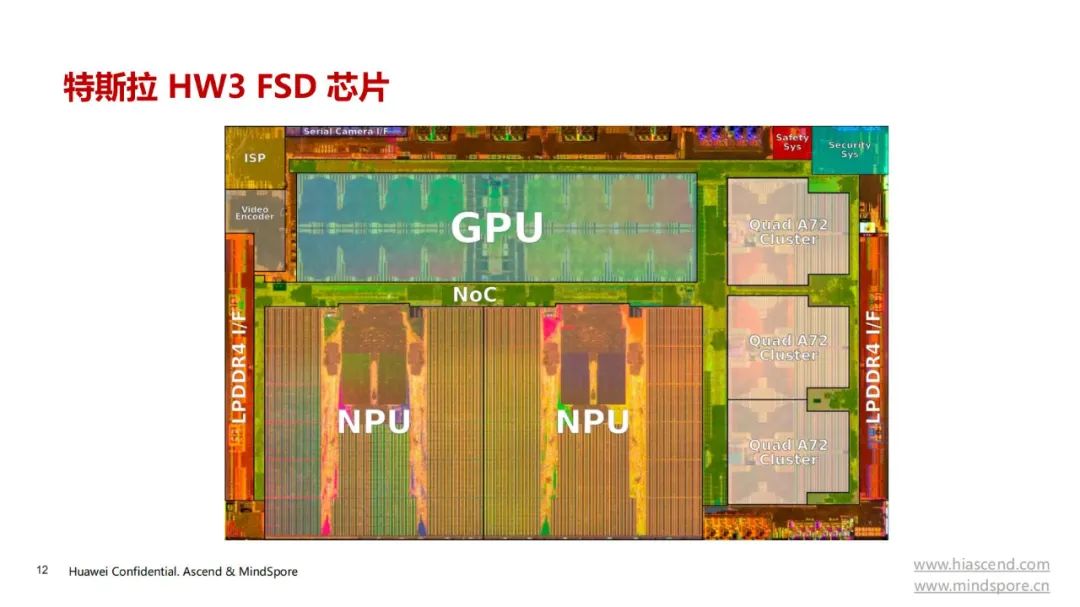

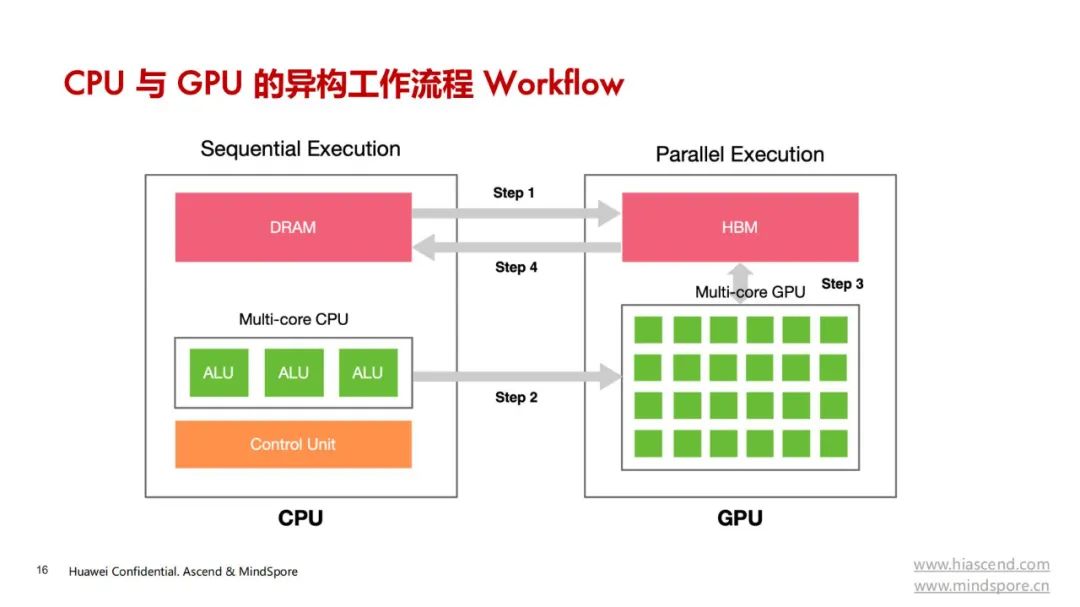

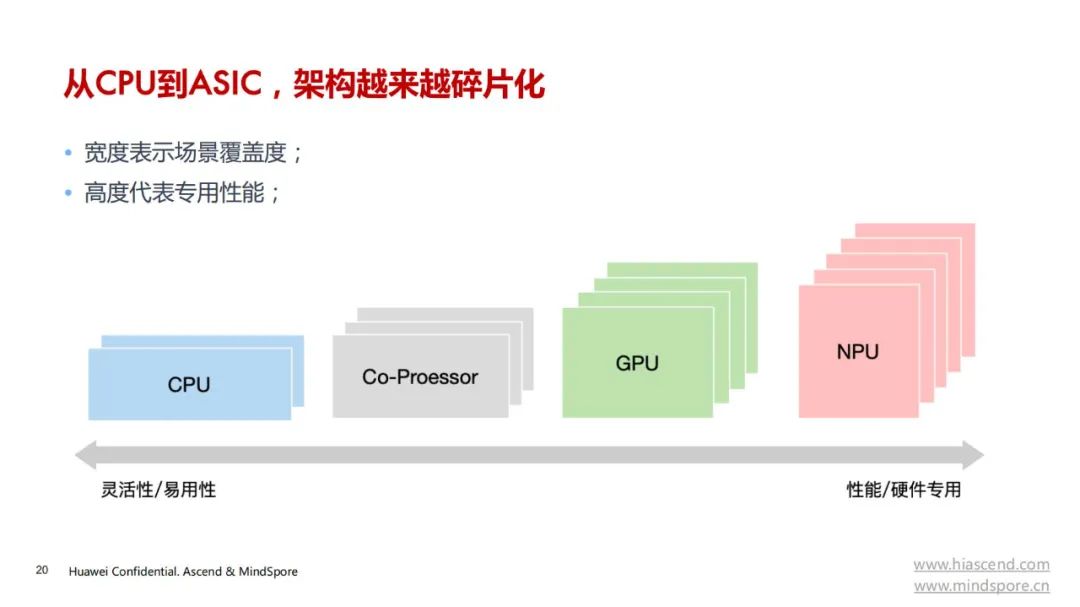

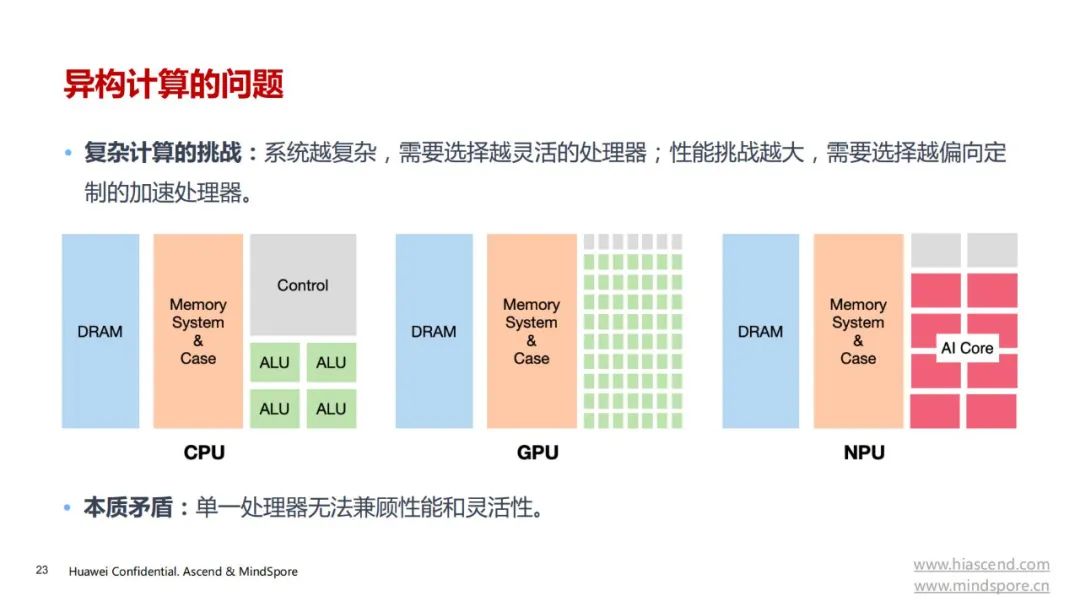

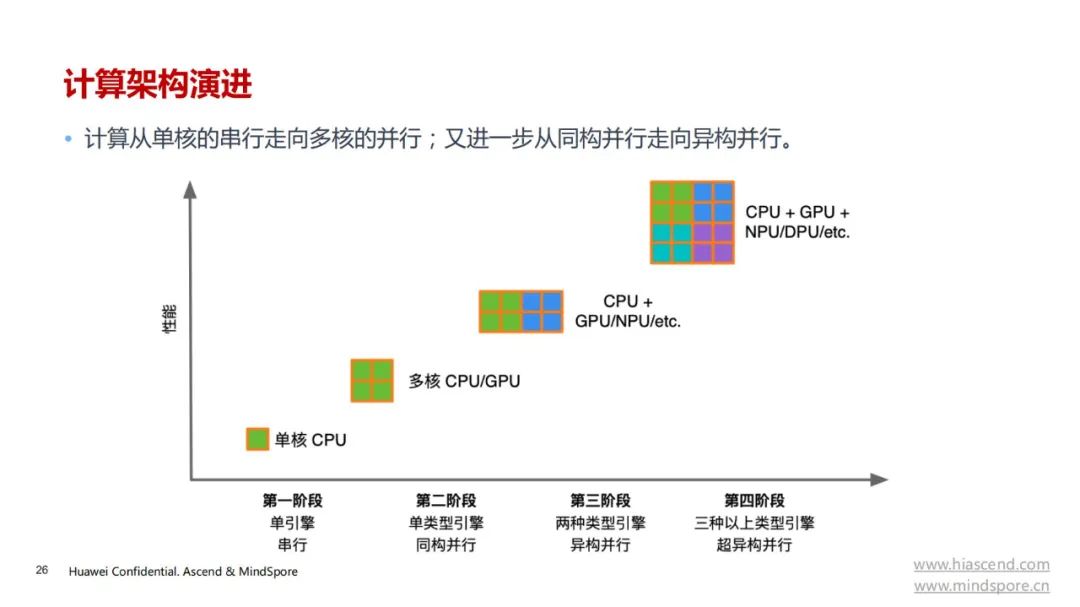

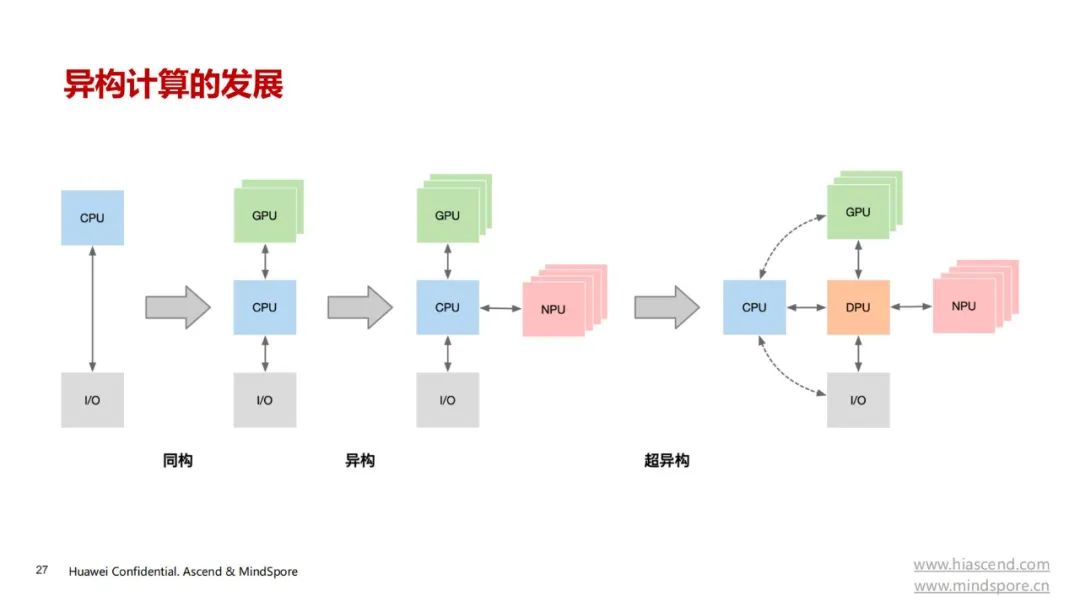

第三阶段:GPU 和 AI 芯片新架构推动 AI 快速落地

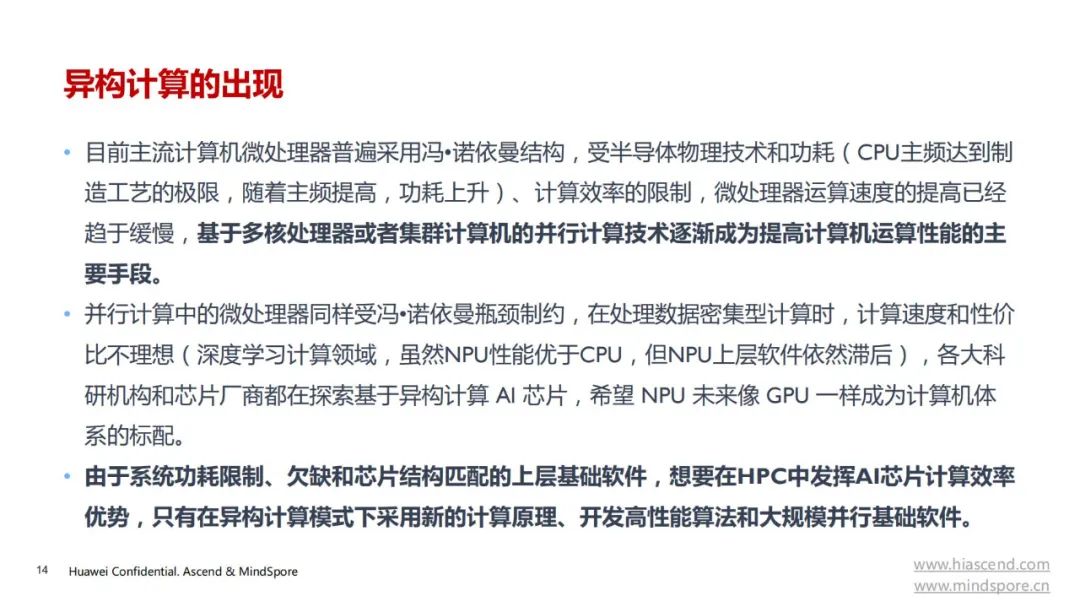

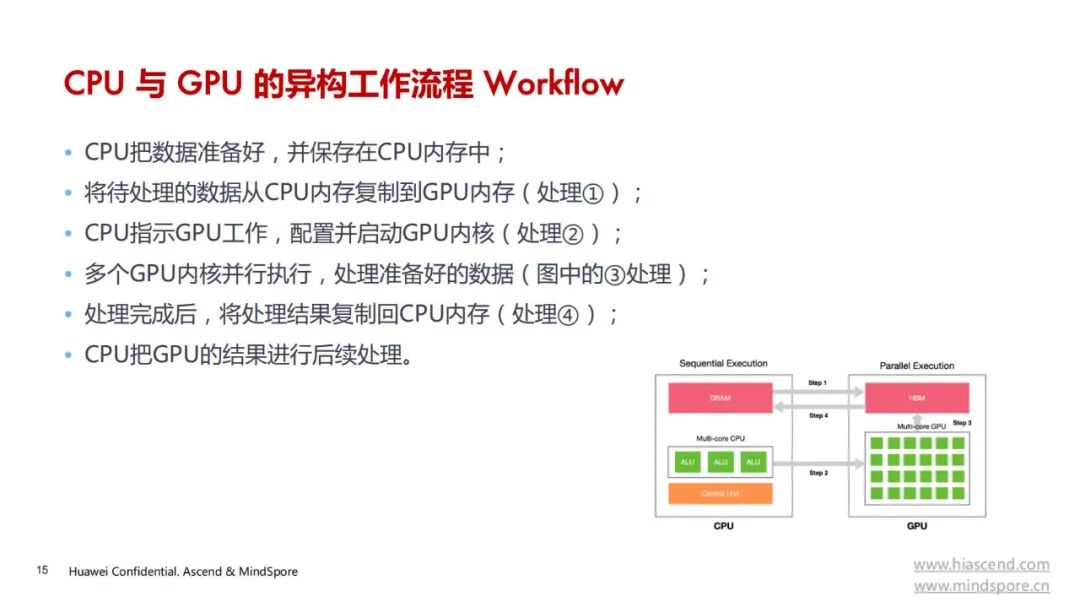

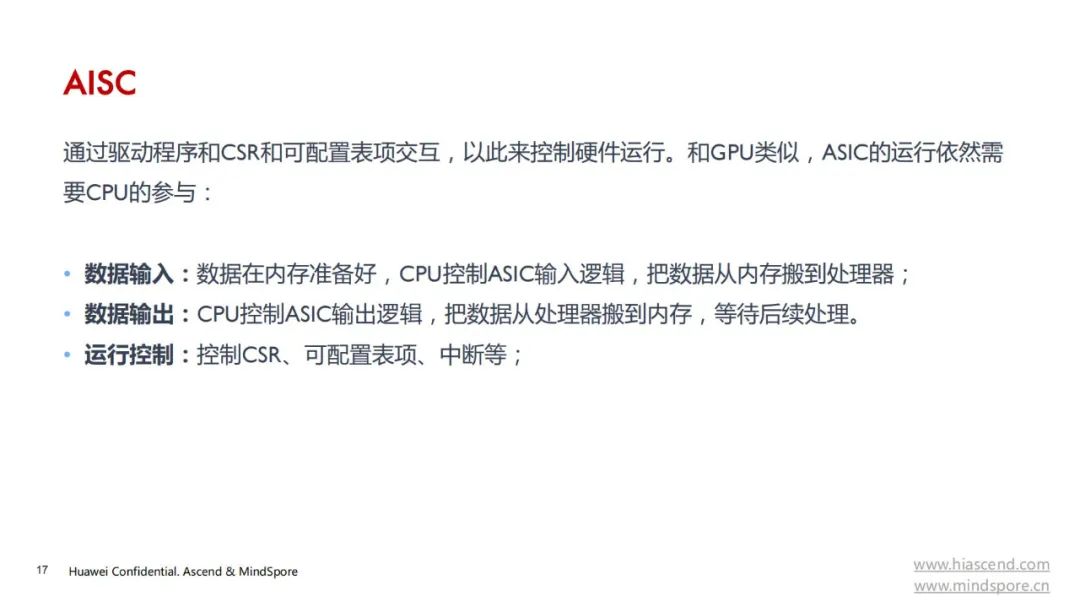

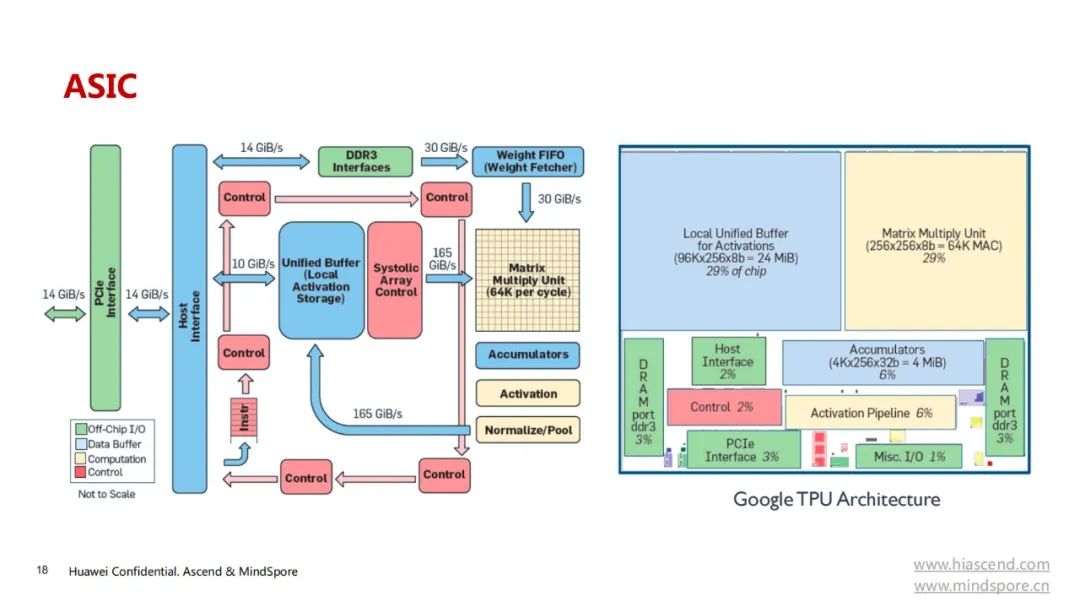

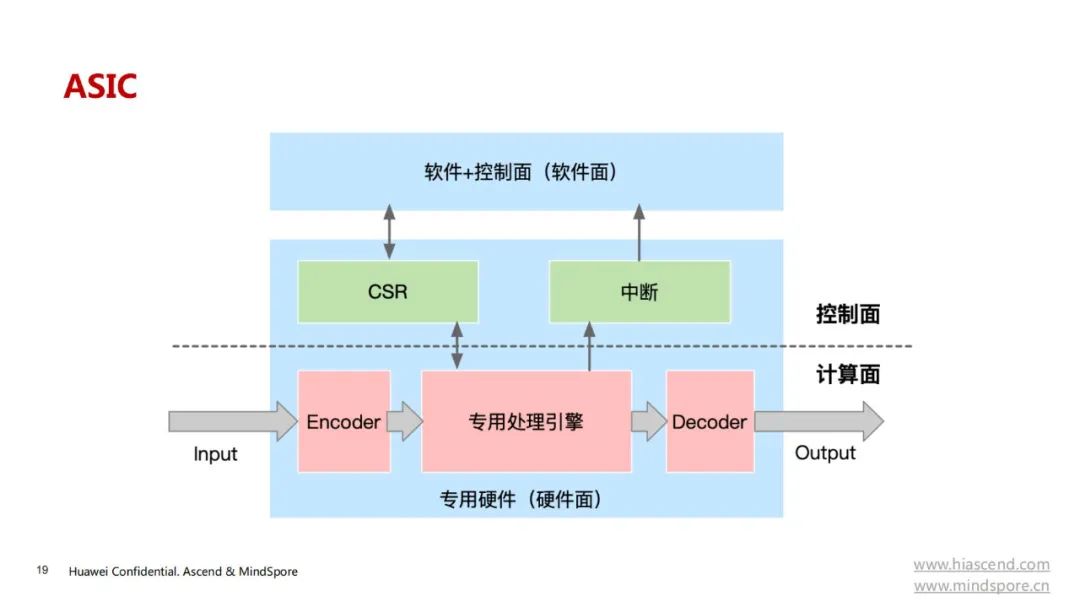

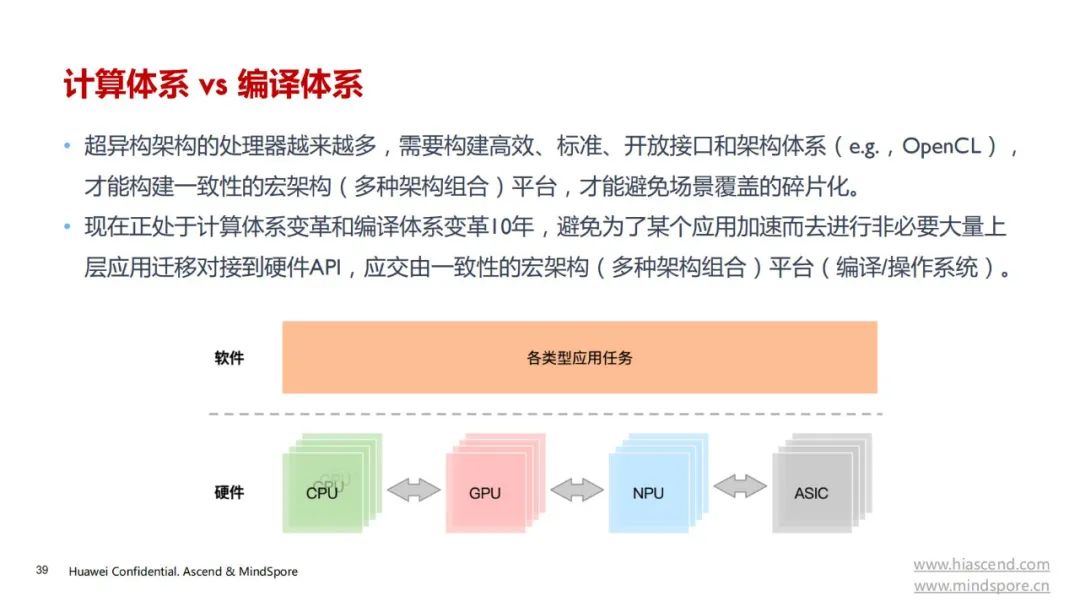

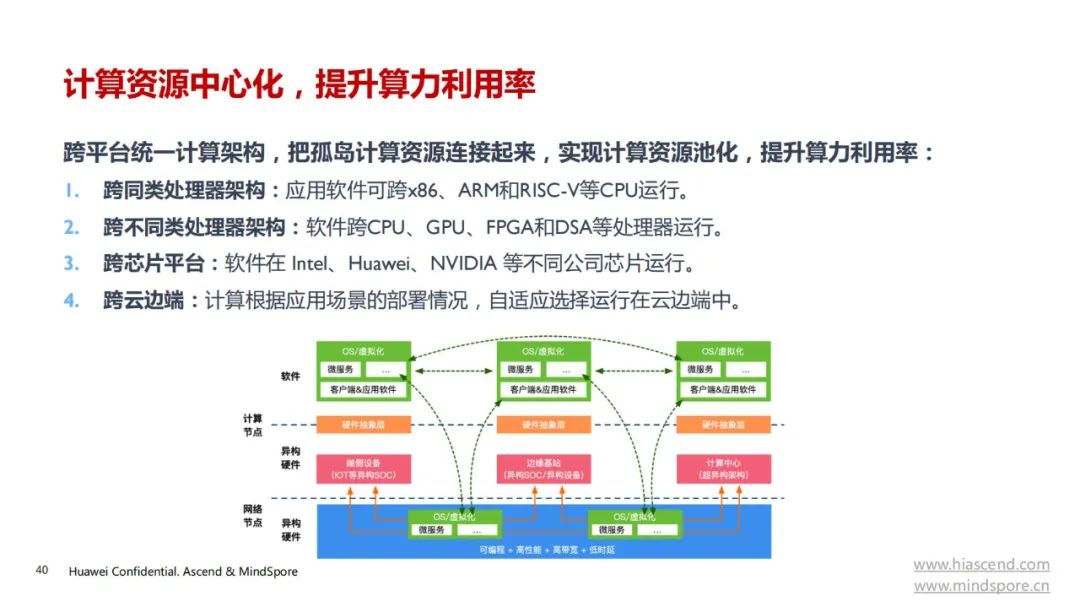

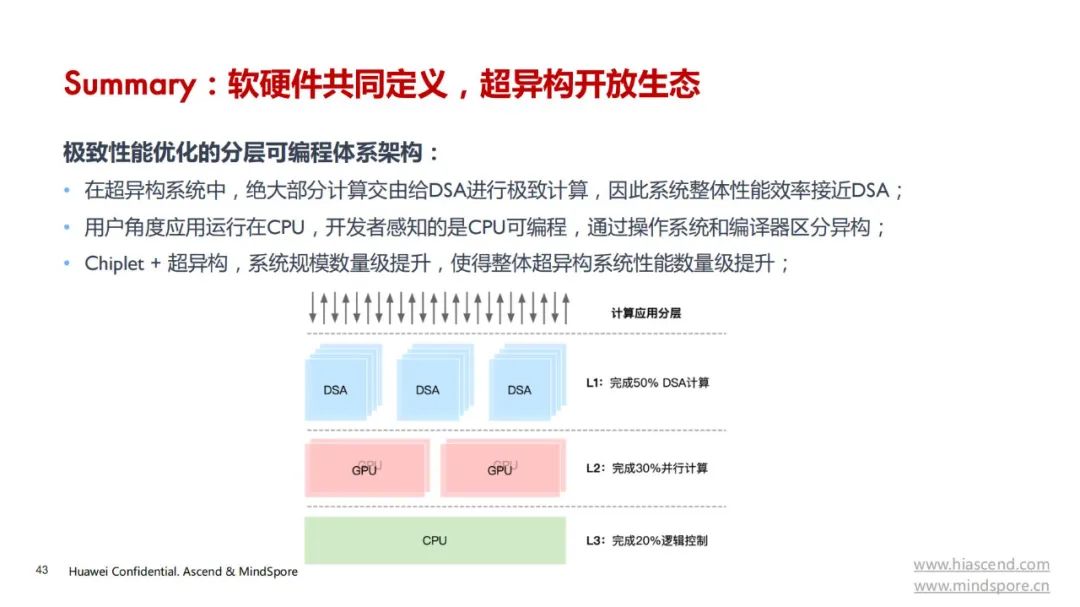

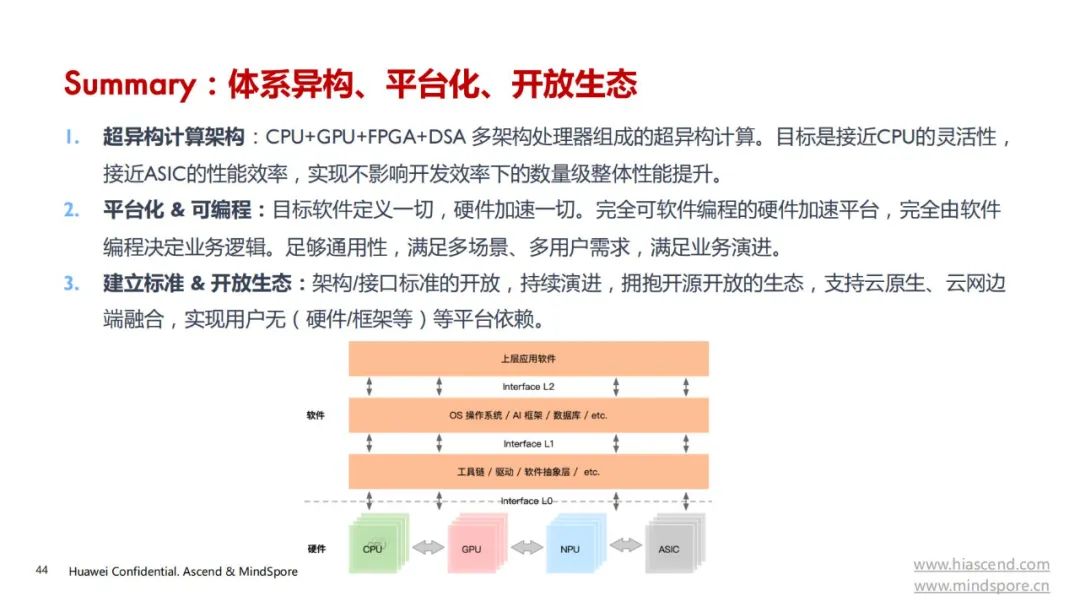

为了解决算力瓶颈,研究者们开始将目光转向了其他计算架构。与 CPU 相比,GPU 在矩阵运算等方面有着显著的优势,能够大幅加速神经网络训练。与此同时,一些专门针对 AI 加速的芯片架构也开始涌现,如 TPU、NPU 等。这些芯片在算力、功耗等方面进一步优化,为 AI 的落地应用扫清了障碍。

除了芯片算力外,算法的进步、数据的积累也是 AI 发展的重要推动力。在算力瓶颈得到缓解后,一些重要的神经网络结构如 CNN、RNN、Transformer 等被相继提出,并在图像、语音、自然语言处理等领域取得了突破性进展。海量的数据为模型训练提供了丰富的素材,使得神经网络能够学习到更加鲁棒和泛化的特征表示。

本文所有资料都已上传至“智能计算芯知识”。如“《225+份DeepSeek技术报告合集》”,“《100+份AI芯片技术修炼合集》”,“《10+份Manus技术报告合集》”,加入星球获取严选精华技术报告,提供打包下载,内容持续更新...

8、《3+份技术系列基础知识详解(星球版)》

《100+份AI芯片技术修炼合集》

《220+份DeepSeek技术报告合集》

《42篇半导体行业深度报告&图谱(合集)

亚太芯谷科技研究院:2024年AI大算力芯片技术发展与产业趋势

本号资料全部上传至知识星球,更多内容请登录智能计算芯知识(知识星球)星球下载全部资料。

免责申明:本号聚焦相关技术分享,内容观点不代表本号立场,可追溯内容均注明来源,发布文章若存在版权等问题,请留言联系删除,谢谢。

温馨提示:

请搜索“AI_Architect”或“扫码”关注公众号实时掌握深度技术分享,点击“阅读原文”获取更多原创技术干货。