有人说,20世纪是电的世纪,21世纪是光的世纪;知光解电,再小的个体都可以被赋能。追光逐电,光引未来...欢迎来到今日光电!

----追光逐电 光引未来----

YOLOv12 是 YOLO 系列中首个打破传统基于卷积神经网络(CNN)方法的模型,它通过将注意力机制直接集成到目标检测过程中实现了这一突破。本文深入研究了 YOLOv12 的架构、创新模块、技术细节以及它在实际应用中的性能表现。该模型配备了区域注意力(Area Attention)方法、残差高效层聚合网络(Residual Efficient Layer Aggregation Networks,R-ELAN)和快速注意力(FlashAttention)等先进技术,既实现了高检测精度(平均精度均值,mAP),又具备实时推理速度,为工业应用、自动驾驶、安防等众多领域带来了革命性的提升。1. 引言及 YOLO 系列的演进

“你只需看一次”(You Only Look Once,YOLO)系列自诞生以来,通过不断提升速度和精度,彻底革新了目标检测领域。从 YOLOv1 的单阶段预测方法,到后续借助 Darknet、跨阶段局部网络(CSP)、高效层聚合网络(ELAN)以及其他各种创新技术所做出的改进,每个版本都为实际应用带来了更高的性能和效率。

尽管像 YOLOv11 这样的早期版本因在实时应用中具有较高的帧率(FPS,每秒帧数)而受到认可,但 YOLOv12 通过集成注意力机制,对架构进行了全新的构思。这使得该模型不仅依赖卷积方法,还能更有效地对大感受野进行建模,从而实现更高的精度(mAP)。

2. YOLOv12 的核心特性与创新方法

2.1 以注意力机制为核心的架构

YOLOv12 的显著特点是摒弃了传统基于 CNN 的方法,引入注意力机制用于实时目标检测。这一方法基于两项主要创新:

为了克服传统自注意力机制的高计算成本问题,YOLOv12 将特征图水平或垂直划分为大小相等的区域(默认分为 4 部分)。这种简单而有效的方法在保留大感受野的同时,显著降低了计算复杂度。

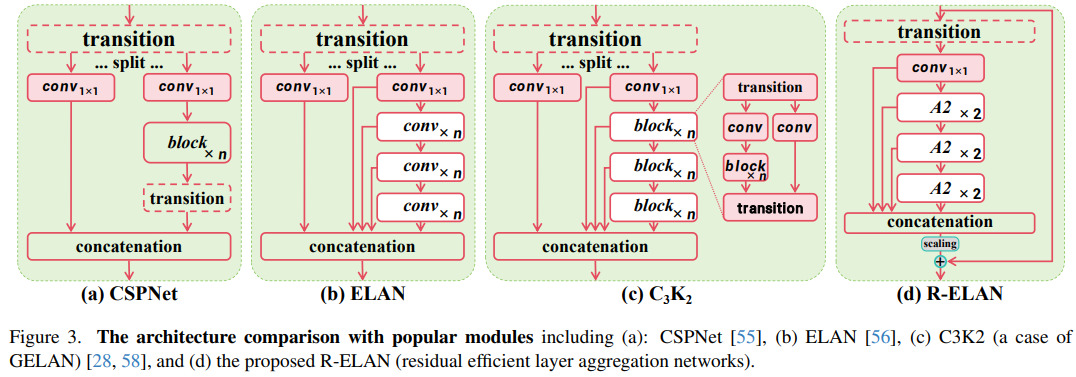

- 残差高效层聚合网络(Residual Efficient Layer Aggregation Networks,R-ELAN)

R-ELAN 是早期 ELAN 架构的演进版本,它通过引入块级残差连接和缩放技术,解决了训练过程中的不稳定性问题。这种重新设计的特征聚合方法,使得即使是更深更宽的模型版本也能稳定训练。2.2 快速注意力(FlashAttention)的集成YOLOv12 利用快速注意力(FlashAttention)技术来最小化内存访问瓶颈。该技术在现代支持 CUDA 的 GPU(如 Turing、Ampere、Ada Lovelace、Hopper 架构)上尤为有效,能显著减少注意力操作的计算时间,从而提升模型的整体效率。

2.3 调整多层感知机(MLP)比例并去除位置编码

与典型的 Transformer 中 MLP 扩展比例为 4 不同,YOLOv12 使用较低的比例(例如 1.2 或 2),以便更好地平衡注意力层和前馈层之间的计算量。此外,该模型去除了不必要的位置编码,从而构建了更简洁、快速的架构,并引入了一个 7×7 的可分离卷积(称为 “位置感知器”)来隐式地对位置信息进行建模。

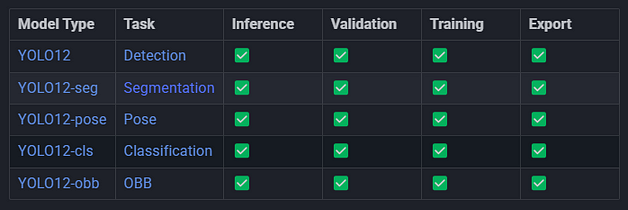

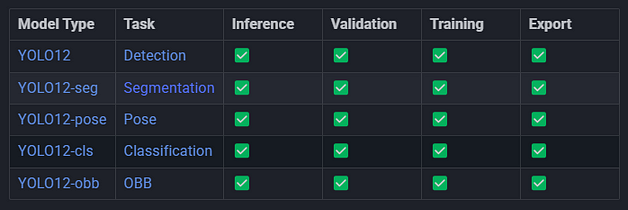

2.4 支持的任务和模式

YOLOv12 是一个功能多样的模型,支持广泛的计算机视觉任务。下表总结了它所支持的任务:

这种多功能性使得该模型适用于自动驾驶、工业自动化、医疗保健、安防等众多领域。

这种多功能性使得该模型适用于自动驾驶、工业自动化、医疗保健、安防等众多领域。3. 技术架构解析

YOLOv12 的架构融入了多项创新,使其在保持实时性能的同时,有别于早期的 YOLO 版本。3.1 区域注意力机制

区域注意力机制通过将特征图(例如 H×W)分割为 l 个相等的部分(默认 l = 4)来解决传统自注意力的二次复杂度问题,这些部分可以水平或垂直排列。这种方法:- 无需复杂的窗口划分。

这种简单的重塑操作显著降低了计算复杂度并加快了模型速度。

[来源:Ultralytics 官方文档]

3.2 残差高效层聚合网络(R-ELAN)

为了克服原始 ELAN 架构中梯度阻塞和优化困难的问题,R-ELAN 包含以下内容:- 块级残差连接:添加从输入到输出的残差(跳跃)连接,并通过层缩放来稳定梯度流动。

- 重新设计的特征集成:重新组织输出通道以创建类似瓶颈的结构,在保持整体精度的同时,降低了计算成本和参数数量。

这些改进对于训练更大规模的模型(M、L、X)特别有益。3.3 优化的注意力架构组件

YOLOv12 通过多项优化进一步完善了注意力机制:

- 快速注意力(FlashAttention):最小化内存访问瓶颈,确保在支持 CUDA 的 GPU 上实现高速性能。

- MLP 比例调整:通过将 MLP 扩展比例从 4 降低到较低值,平衡了注意力层和前馈层之间的计算量。

- 去除位置编码:与传统的位置编码不同,使用 7×7 的可分离卷积(“位置感知器”)来隐式捕获位置信息。

- 深度减少:减少堆叠块的数量,简化了优化过程并减少了推理时间。

- 卷积算子的集成:利用高效的卷积操作有助于降低整体参数数量和计算成本。

4. 性能指标与实际应用

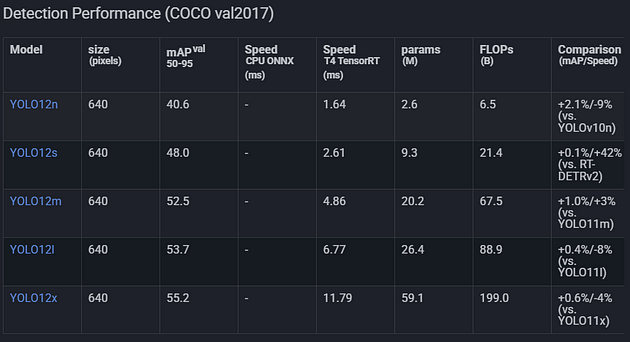

在像 COCO 这样的标准基准测试中,YOLOv12 取得了以下结果:- YOLOv12-Nano(N):推理延迟为 1.64 毫秒,平均精度均值(mAP)达到 40.6%。

- 更大规模的模型(S、M、L、X):随着参数数量的增加,它们能达到更高的 mAP 值;然而,这种增加必须根据 GPU 性能和特定应用需求进行仔细评估。

在实际测试中,例如在实时视频流中,YOLOv12 的低延迟和高精度表现突出,尤其是在工业自动化、安防和自动驾驶等领域。此外,由于 Ultralytics 开发的集成包,安装和集成过程大大简化。YOLOv12 已在 COCO val2017 等标准基准上进行了各种规模的测试。以下是该模型重要版本(nano、small、medium、large、extra-large)的一些关键性能指标总结:注意:表格中的数据是使用配备 TensorRT FP16 的 NVIDIA T4 GPU 获得的。

4.1 精度与实际应用

YOLOv12,特别是其较大规模的版本(mAP50–95 范围从 52.5% 到 55.2%),实现了高精度。这归因于该模型的大感受野,使其能够更精确地定位目标。Nano 版本 1.64 毫秒的推理时间在对时间敏感的应用中具有显著优势,例如自动驾驶、安防摄像头和工业自动化。- 自动驾驶高精度和低延迟使其能够检测道路和交通标志等小目标。

- 安防视频监控系统中快速而精确的目标检测最大限度地减少了安全漏洞。

- 工业自动化生产线上快速的目标检测加快了错误检测和质量控制过程。

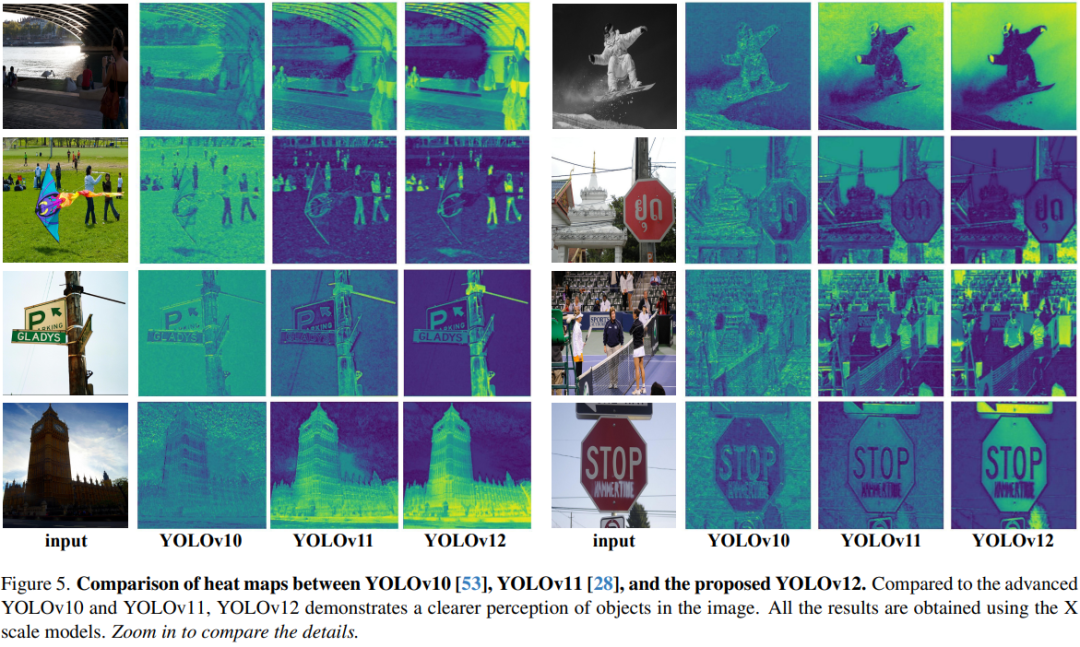

4.2 对比分析与之前的 YOLO 模型相比,YOLOv12 具有以下特点:

- 与 YOLOv10 和 YOLOv11 相比:

Nano 版本比 YOLOv10n 的 mAP 提高了 2.1%,比 YOLOv11-nano 的 mAP 提高了 1.2%。

- 与像 RT-DETR 这样的竞争模型相比:

YOLOv12s 在保持高精度和快速推理的同时,速度提高了多达 42%。

这些数据表明,YOLOv12 无论是在学术研究还是工业应用中都是首选。

5. 安装与使用指南

YOLOv12 旨在与现代深度学习框架兼容。例如:

- 安装

- 安装所需的依赖项:(例如,Python 3.11、CUDA 12.x、FlashAttention、PyTorch 等)

git clone https://github.com/sunsmarterjie/yolov12.git cd yolov12 pip install -r requirements.txt pip install flash-attn==2.7.3 --no-build-isolation

- 确保你的支持 CUDA 的 GPU 已配置好适当的驱动程序和库。

- 使用

from ultralytics import YOLO model = YOLO("yolov12n.pt")results = model.predict("image.jpg")results[0].show()

- 你也可以使用基于 Gradio 的 Web 界面运行演示:

这些步骤使 YOLOv12 能够快速部署在不同的应用场景中(视频、摄像头输入流、静态图像)。

5. 使用示例

5.1 使用 Python 接口:

from ultralytics import YOLO

# 加载在 COCO 数据集上训练的 YOLO12n 模型model = YOLO("yolo12n.pt")

# 在 COCO8 数据集上训练模型 100 个 epochresults = model.train(data="coco8.yaml", epochs=100, imgsz=640)

# 在 'bus.jpg' 图像中检测目标results = model("path/to/bus.jpg")results[0].show()# 可视化预测结果

5.2 命令行接口(CLI)

- 使用在 COCO 上预训练的 YOLO12n 模型开始训练:

yolo train model=yolo12n.pt data=coco8.yaml epochs=100 imgsz=640

yolo predict model=yolo12n.pt source=path/to/bus.jpg

5.3 基于 Gradio 的 Web 演示

使用基于 Gradio 的 Web 界面进行演示:python app.py,此命令将在本地 http://127.0.0.1:7860 启动一个交互式演示。

性能分析与比较

与之前的版本相比,YOLOv12 在几个方面表现出色:

- 速度推理延迟得到了优化,例如在 GPU 上低至 1.64 毫秒,使其非常适合实时应用。

- 精度在 COCO 基准测试中,YOLOv12-N 比 YOLOv11-N 的 mAP 提高了 2.1%。然而,在某些实际场景中,帧率(FPS)可能会略有变化。

- 模型大小和计算成本借助 R-ELAN 和区域注意力模块,在不牺牲性能的情况下减少了参数数量。

这种平衡使得 YOLOv12 成为工业应用、自动驾驶、安防系统和许多其他领域的首选。

6. 创新改进与优化

YOLOv12 的关键创新可以总结如下:

6.1 先进的特征提取

将特征图划分为相等的部分,在降低计算成本的同时保留了大感受野。调整 MLP 比例以平衡注意力层和前馈层之间的计算量。通过残差连接和瓶颈结构,为深度网络提供稳定的训练。6.2 优化创新添加从输入到输出的残差连接,缓解了梯度流动问题并稳定了训练过程。最小化内存访问瓶颈,尤其是在现代 NVIDIA GPU(Ampere、Ada Lovelace、Hopper 架构)上,确保快速的性能。与传统的位置编码不同,采用 7×7 的可分离卷积来隐式地对位置信息进行建模。6.3 架构深度和参数效率简化了优化过程,从而实现更快的训练时间和更低的延迟。7. 硬件要求与设置为了充分发挥 YOLOv12 的优势,特别是快速注意力(FlashAttention)特性,确保你拥有以下 NVIDIA GPU 系列之一:

- Turing 架构 GPU:例如,NVIDIA T4、Quadro RTX 系列

- Ampere 架构 GPU:例如,RTX30 系列、A30/40/100

- Ada Lovelace 架构 GPU:例如,RTX40 系列

- Hopper 架构 GPU:例如,H100/H200

确保你的 CUDA 工具包和 GPU 驱动程序已更新,以保证在训练和推理过程中都能获得最佳性能。

git clone https://github.com/sunsmarterjie/yolov12.git cd yolov12

pip install -r requirements.txt pip install flash-attn==2.7.3 --no-build-isolation

8. 结论与未来展望

YOLOv12 成功地将注意力机制的强大功能集成到实时目标检测中,为该领域的性能设定了新的基准。

- 优点

- 借助快速注意力(FlashAttention)减少推理延迟。

- 由于 R-ELAN,即使在深度模型中也能实现稳定的训练。

- 支持多种任务:目标检测、分割、分类、姿态估计和有向目标检测。

- 缺点

- 快速注意力(FlashAttention)的优势需要现代兼容的 GPU,这可能会限制在较旧硬件上的性能。

- 实际场景可能需要针对不同的数据集和用例进行微调(例如,调整帧率)。

展望未来,预计会出现更多基于 YOLOv12 的变体,可能会针对移动部署、更低功耗和更广泛的应用领域进行优化,为实现更高效、多功能的目标检测解决方案铺平道路。

【参考文献】

论文:https://www.arxiv.org/pdf/2502.12524

代码:https://github.com/sunsmarterjie/yolov12

申明:感谢原创作者的辛勤付出。本号转载的文章均会在文中注明,若遇到版权问题请联系我们处理。

----与智者为伍 为创新赋能----

【说明】欢迎企业和个人洽谈合作,投稿发文。欢迎联系我们诚招运营合伙人 ,对新媒体感兴趣,对光电产业和行业感兴趣。非常有意者通过以下方式联我们!条件待遇面谈联系邮箱:uestcwxd@126.com

QQ:493826566

这种多功能性使得该模型适用于自动驾驶、工业自动化、医疗保健、安防等众多领域。

这种多功能性使得该模型适用于自动驾驶、工业自动化、医疗保健、安防等众多领域。