▼关注微信公众号:硬件那点事儿▼

最近随着国产AI神器DeepSeek R1的爆火,着实让中国科技秀了一把,也许是不甘于此,马斯克出手了,推出了Grok 3人工智能大语言模型,并且号称是“地球上最聪明的 AI”,Grok 3的训练号称使用了20万个H100 GPU,这一规模使其在处理复杂任务时具备强大的推理能力。根据公开信息,DeepSeek R1的训练过程中使用了仅仅使用了2048个NVIDIA H800 GPU。并且H800是NVIDIA专为中国市场设计的GPU型号,受美国出口限制影响,其性能较H100有所降低,换句话说DeepSeek R1使用的是阉割版的2048个GPU。H100面向全球高端市场,价格较高,单卡价格通常在3万美元以上,H800专供中国市场,价格稍低,约2万至2.5万美元。所以问题来了20万个H100 GPU能碾压2048个H800 GPU吗?是马斯克的大力出奇迹?还是DeepSeek的四两拨千斤?

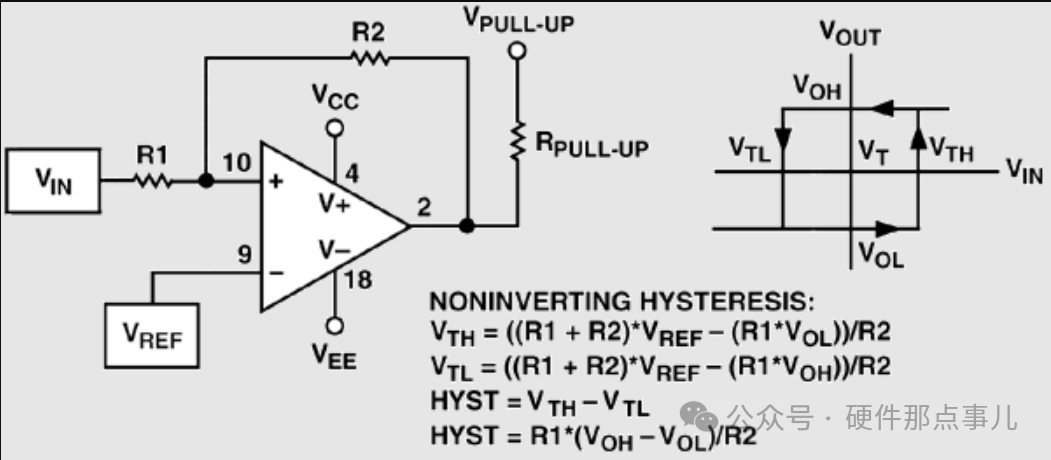

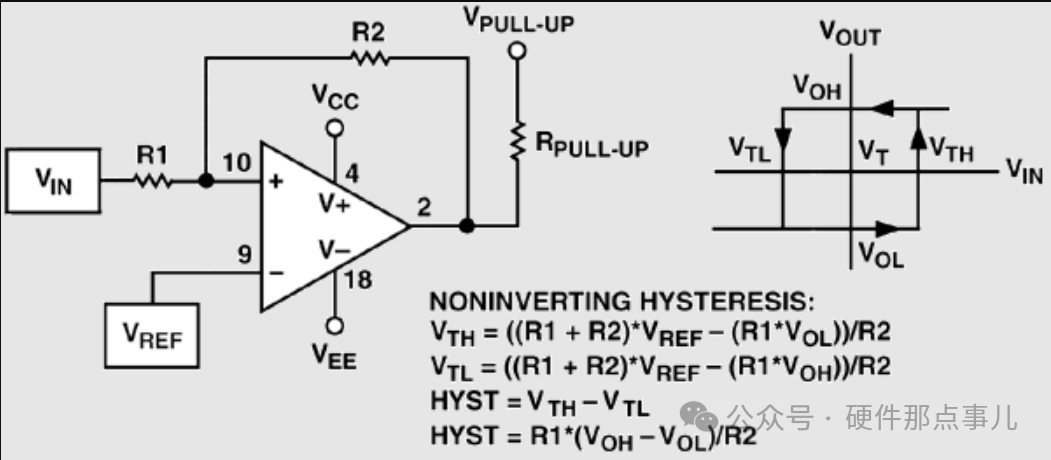

接下来我们还是拿之前对比DeepSeek和ChatGPT时的电路图,让这俩AI工具分析一下,下面的电路是一个采用比较器搭建的带回滞的同相比较器电路,带回滞的同相比较器是一种施密特触发器,用于抑制输入信号中的噪声,防止输出在输入接近阈值时出现抖动。比较器用于区分两个不同的信号电平。比如下面的电路图就是带回滞的同相比较器电路,当输入电压大于VTH电压或小于VTL电压时,输出电平就会反转,回滞区间是VTH-VTL。

后面的对比我们都采用下面的电路图:

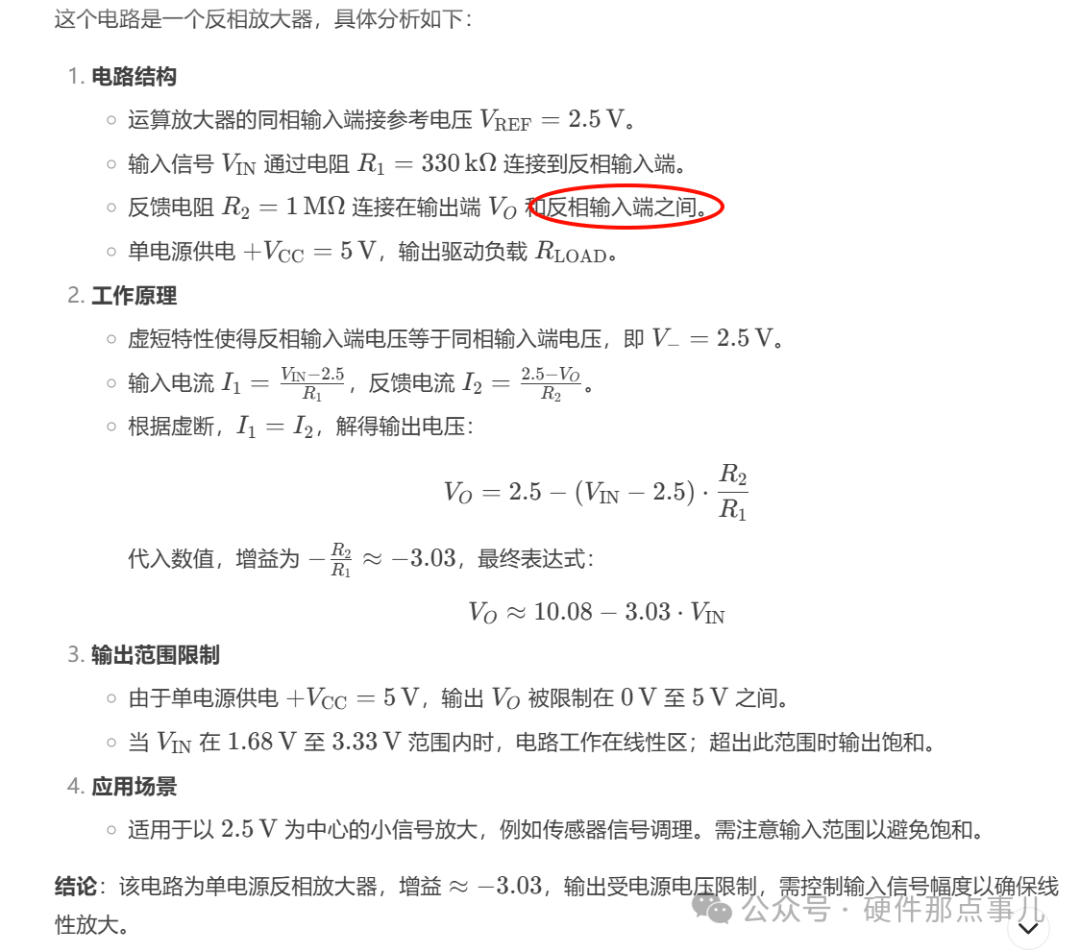

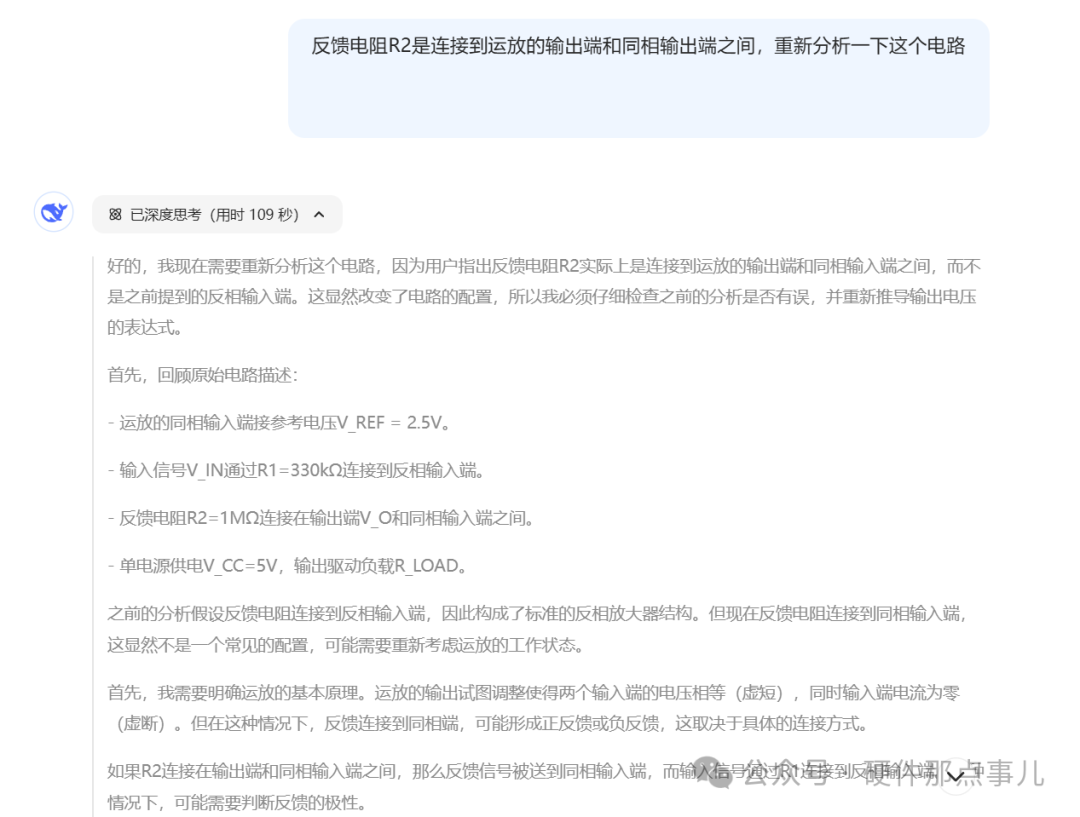

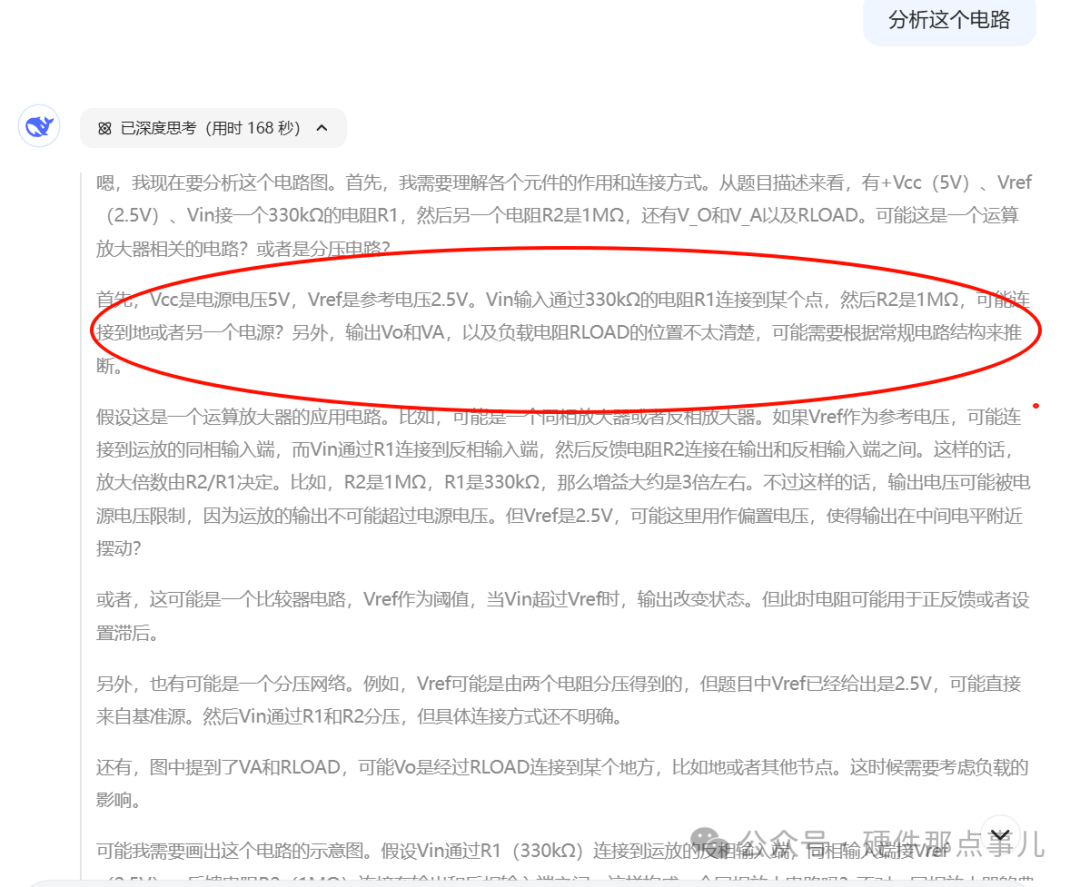

DeepSeek分析结论如下:这个电路可能是一个反相放大器,将输入信号以2.5V为参考点进行放大,增益为-3.03,但由于单电源供电,输出受到电压限制,只能在输入信号的特定范围内保持线性放大。 DeepSeek在第一步电路结构就分析错了,因为R2是接在输出端和同相输入端之间,它在分析电路的过程中没有准确识别运放的同相输入和反相输入,所以它没有按完全按图片里的电路去分析,而是假定R2是接在输出端和反相输入端之间往下分析。看来它还是没分析出来这个电路的正确作用,在它的思路里,运放是要线性放大工作的,所以挑战失败呀。接下来看看号称地表最强的Grok 3能不能正确分析这个电路图:这里Grok 3和DeepSeek犯了一样的错误,在第一步电路结构就分析错了,因为R2是接在输出端和同相输入端之间,它俩都把R2认为是接在输出端和反相输入端之间往下分析,所以得到的分析结论肯定是错的。给它点提示之后,Grok 3没有再犯错了:由于正反馈的存在,电路的行为不再是线性放大,而是可能表现出开关特性(例如比较器或触发器)。我们需要推导其工作原理:

DeepSeek在第一步电路结构就分析错了,因为R2是接在输出端和同相输入端之间,它在分析电路的过程中没有准确识别运放的同相输入和反相输入,所以它没有按完全按图片里的电路去分析,而是假定R2是接在输出端和反相输入端之间往下分析。看来它还是没分析出来这个电路的正确作用,在它的思路里,运放是要线性放大工作的,所以挑战失败呀。接下来看看号称地表最强的Grok 3能不能正确分析这个电路图:这里Grok 3和DeepSeek犯了一样的错误,在第一步电路结构就分析错了,因为R2是接在输出端和同相输入端之间,它俩都把R2认为是接在输出端和反相输入端之间往下分析,所以得到的分析结论肯定是错的。给它点提示之后,Grok 3没有再犯错了:由于正反馈的存在,电路的行为不再是线性放大,而是可能表现出开关特性(例如比较器或触发器)。我们需要推导其工作原理:Grok 3的最终结论:

该电路是一个带正反馈的比较器或可能的施密特触发器,其功能如下:

输入-输出关系:以V_REF=2.5V为基准,当V_IN变化时,输出V_O在0 V和5V之间切换。

阈值范围:

当V_IN<1.675 V时,V_O 趋向于+5V。

当V_IN>3.327V时,V_O趋向于 0V。

在1.675V至3.327V范围内,输出可能表现为滞回切换(需要进一步验证是否为施密特触发器)。

应用:适合信号检测、波形整形或触发电路,但需注意正反馈可能导致不稳定或振荡。

对比下来只能说马斯克这20万张GPU没白买,确实是有真东西的,因为在之前的对比中,DeepSeek和ChatGPT半斤八两,都没分析对,但是这次对比中虽然DeepSeek和Grok 3一开始都没回答对,但是Grok 3经过提示后迅速转变分析思路,当然了,毕竟二者实力悬殊,20万个H100 GPU和2048个阉割版H800 GPU确实难顶,当然了DeepSeek最大的优势是开源和低成本。它免费开放,API费用也很低,大大降低了AI但是入行门槛,不说给DeepSeek20万个H100 GPU,哪怕给DeepSeek10万个H800 GPU,谁胜谁负还未可知!但本次对比也给广大硬件工程师敲响警钟,之前觉得AI能端走搞软件的程序猿的饭碗,未来感觉硬件的饭碗也不太稳了,大家努力吧!

有问题欢迎在评论区留言交流哦!

DeepSeek在第一步电路结构就分析错了,因为R2是接在输出端和同相输入端之间,它在分析电路的过程中没有准确识别运放的同相输入和反相输入,所以它没有按完全按图片里的电路去分析,而是假定R2是接在输出端和反相输入端之间往下分析。

DeepSeek在第一步电路结构就分析错了,因为R2是接在输出端和同相输入端之间,它在分析电路的过程中没有准确识别运放的同相输入和反相输入,所以它没有按完全按图片里的电路去分析,而是假定R2是接在输出端和反相输入端之间往下分析。