太卷了,智能驾驶在国内的落地发展太迅速了,从体验功能端,大家开城大战打完了之后就进入点到点的落地战,点到点弄完了之后肯定Robotaxi大战;而在硬核的软件技术端,端到端大模型战在华为这个月宣布急攻端到端大模型的信息下,已经算是进入焦灼状态。

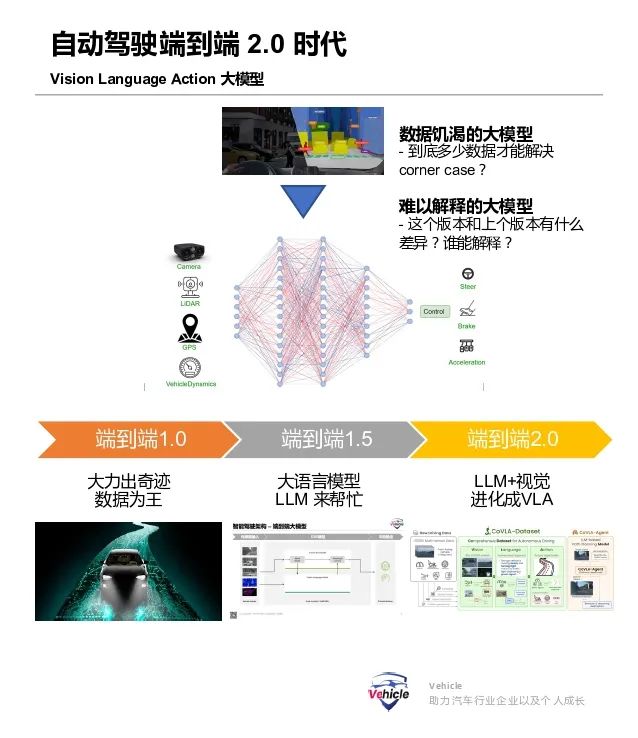

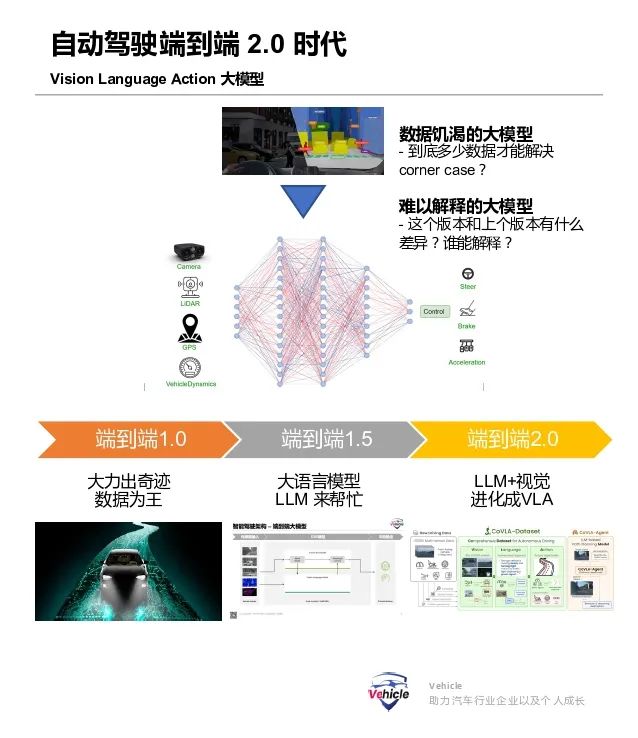

那么端到端大模型之后呢?

或许最近不少苗头已经透露 VLM (vision language model 具《智能驾驶技术演进与未来挑战:从目标物识别到大模型上车》体可以点击之前文章了解)之后的VLA (vision language action)会是2025年国内的自动驾驶行业全面宣传和竞争的重点,各家会开卷端到端大模型 2.0。

VLA其实不但可以应用于自动驾驶,它其实是自动驾驶车辆的大类 - 智能机器人,具身智能的基础,那么也可以理解为什么现在人行机器人产业。具身智能会火起来了,其实机器人比汽车更容易,机器人出问题可能不会有生命危险,但汽车出问题是会有生命危险,甚至公共安全的生命危险。

本文整理 VLA 相关论文以及其在汽车行业发展和应用信息,希望能大家一些科普和前瞻信息。

什么是 VLA 模型?

VLA 有哪些优点?

实验室里面的 VLA 有哪些进展?

落地应用 VLA 有哪些挑战?

目前有哪些车企在布局?

什么是 VLA 模型

首先,我们先回顾视觉语言模型 (VLM), 它是一种机器学习模型,可以处理视觉信息和自然语言。它们将一张或多张图像作为输入,并生成一系列标记,这些标记通常表示自然语言文本。

VLM 的奇妙之处是在人类智慧结晶互联网上的图像和文本数据上进行训练的,VLM 类似于三体中的智子,吸收了人类语言文字的智慧,能看懂和推理图片内容。

而 VLA 模型,就是在 VLM 基础上利用机器人或者汽车运动轨迹数据,进一步训练这些现有的 VLM,以输出可用于机器人或者汽车控制的文本编码动作。

这些经过进一步训练的 VLM 被称为视觉-语言-动作 (VLA) 模型。通过结合视觉和语言处理,VLA 模型可以解释复杂的指令并在物理世界中执行动作。

上面Google Deepmind RT-2的图片,非常好的图像化解释VLA,VLA(RT-2) = VLM + 机器运动数据(RT-1)。

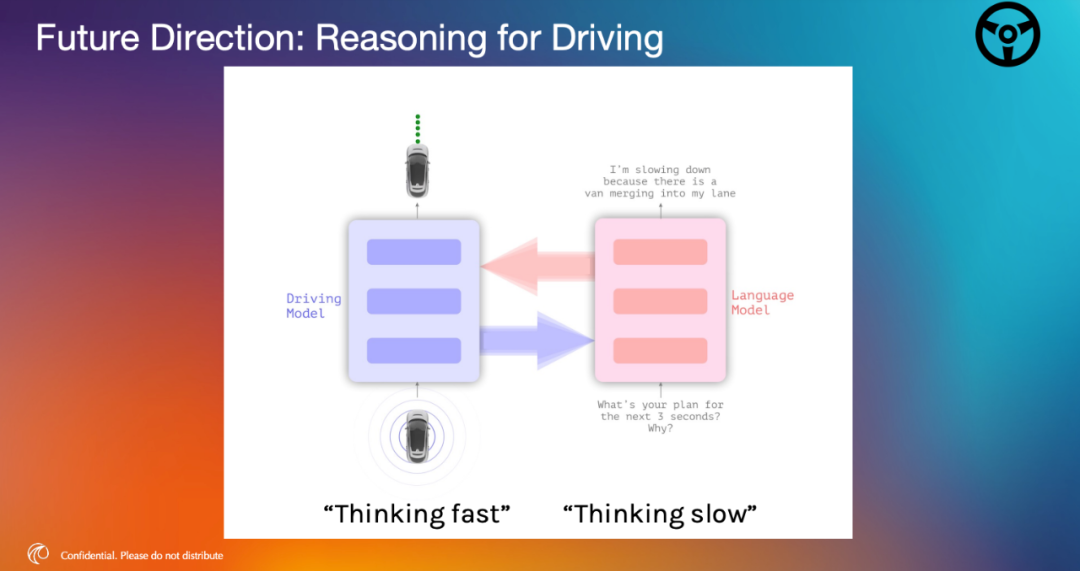

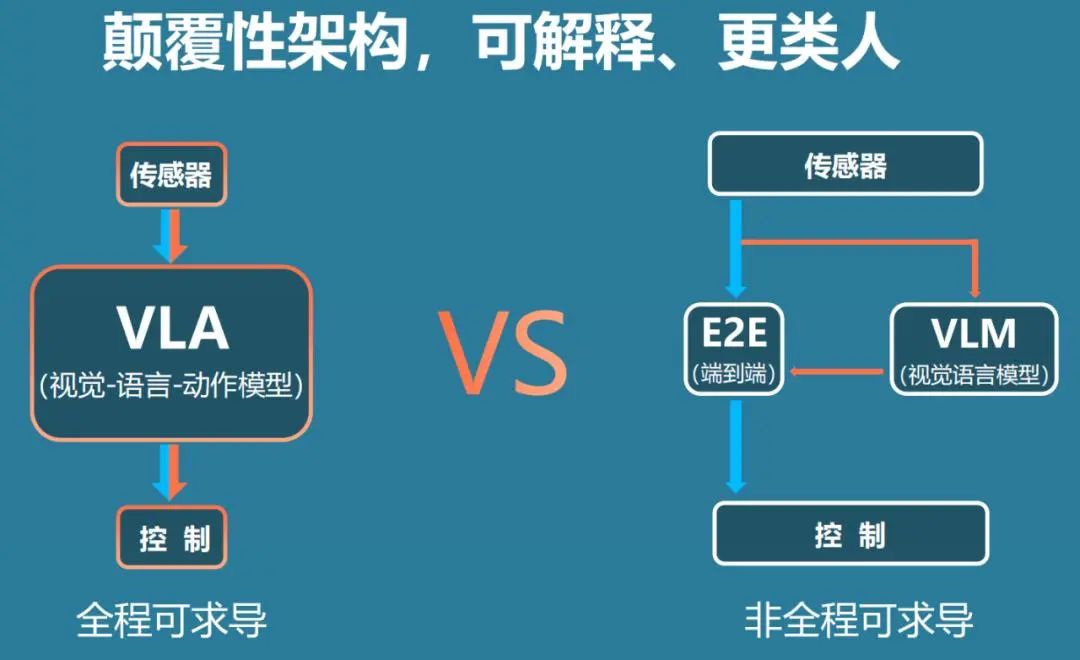

首先,VLA是一个端到端大模型,所以大模型该有的优点,他都有。另外,从视觉到执行,类似可推理性,可解释性都有非常大的优势,这个可以查看之前文章了解《采用 ChatGPT 类似大模型作为自动驾驶算法核心的 - Waymo 的端到端多模态算法 EMMA》。其次,它具有通用型,未来所有“智能机器设备”都可以统一采用这套大模型算法,通过微调可以实现,不管是汽车,飞行设备,乃至任何智能机器人都可以通用。所以这就是为什么可以看到现在的新势力,上天下地,机器人都搞的原因,他们明白通用AI可以加任何机械设备从而变成人工智能设备,实现phycial AI(也有人叫具身智能,我更愿意叫他phycial AI)而不是仅仅现在的digital AI。VLA这些通用系的模型在数据量、计算资源和模型复杂度的边界上表现出持续的性能提升,因为有了自然文字语言的人类智慧为底座,所以可以极大的减少重复的数据,计算资源,同时降低模型复杂度。当前AI的催生,基本都来自于著名学术机构高校和知名公司的创新实验。2023年7月28日,谷歌DeepMind推出了全球首个用于控制机器人的视觉语言动作(VLA)模型 RT-2 也就是上文解释 VLA 借用的那个图片。RT-2 以 Google 的 VLM PaLI-X 和 PALM-E 为基础,这些模型使用 DeepMinds 在开发 RT-1 模型期间收集的机器人轨迹数据进行微调。该模型经过微调,通过将机器人动作表示为文本标记来输出机器人动作。这种独特的方法使模型能够从自然语言响应和机器人动作中学习,从而使其能够执行各种任务。RT-2 模型的令人印象深刻的泛化能力。该模型在新的物体、背景和环境中表现出显著改善的性能。它可以解释机器人训练数据中不存在的命令,并根据用户命令执行基本的推理。推理能力是底层语言模型采用思路链推理能力的结果。该模型推理能力的例子包括弄清楚要拿起哪个物体用作临时锤子(一块石头),或者哪种饮料最适合疲惫的人(能量饮料)。这种程度的泛化是机器人控制领域的一大进步。RT-2目前不是开源的,也就是大家无法基于他去创新和修改,但他的出现激励了当前智能机器人行业的发展,给了大家信心。

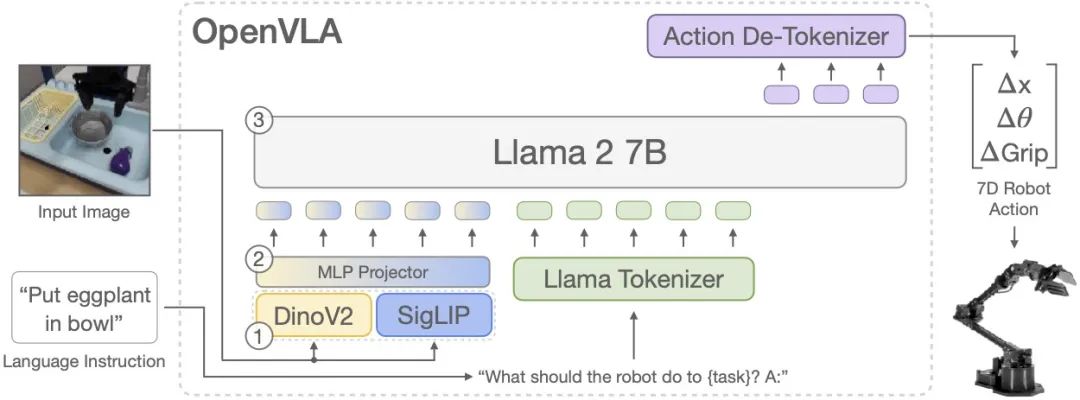

另一个比较知名的是 OpenVLA 模型,它是由来自斯坦福大学、加州大学伯克利分校、谷歌 Deepmind 和丰田研究院的研究人员组成的团队发起。他是一种基于 LLM/VLM 构建的视觉/语言动作模型,用于具身机器人和行为学习(此基础模型是使用 Llama-7B、DINOv2 和 SigLIP 的 Prismatic VLM)。OpenVLA 模型不是使用图像字幕或视觉问答,而是根据用于控制机器人的摄像头图像和自然语言指令生成动作标记。动作标记是从文本标记器词汇表中保留的离散标记 ID,这些标记映射到连续值,并根据每个机器人的运动范围进行归一化。通过微调预训练的Prismatic-7B VLM 来训练 OpenVLA 。模型由三个关键元素组成:- 融合视觉编码器一般也叫ViT(Vision transformer),由 SigLIP 和 DinoV2 主干组成,其中DinoV2主要是为了增加对于空间的理解,将图像输入映射到多个“图像块嵌入”,可以简单理解将视觉编码成语言。

- 投影仪MLP Projector,这个组件可以获取视觉编码器的输出嵌入并将其映射到大型语言模型的输入空间,可以理解为这是个中间人,他能将编码的语言和大语言模型对接上。

- Llama 2 7B作为语言模型的主干,根据对接上的信息,预测标记化的输出动作。这些标记被解码为可直接在机器人上执行的连续输出动作。

OpenVLA 是开源的,目前不少公司应该都基于他在进行研究,来找VLA应用和商业落地的方法。以上两个为影响比较大的,除了上面 VLA 还有不少其他的例如 Umass的3D-VLA,美的集团的Tiny-VLA等等。VLA 那么好,是不是立马可以在生活和商用中用起来?其实上面RT-2/Open VLA基本上和大模型一样都是上Billions十亿的参数。

模型大,需要边缘算力大,就拿Open VLA 的7B 的参数模型来看,推理过程中速度很慢,需要对大量机器人数据进行大量预训练,这使得实际部署变得困难。所以,实时运行大型 VLA 模型的计算成本很高,需要进行更多研究来优化其推理速度。未来的研究应侧重于开发实现更高频率控制的技术,并使更多 VLM 模型可用于训练 VLA 模型。Phycical AI 需要与人类世界互动,那么实时高频精准的运动是必须的,机器人可能要求的响应可以低,但一般可用的都需要达到以 30-50 Hz 运行的执行;而汽车智能汽车的电控底盘一般的执行响应都达到100Hz。所以,这里还有很长的路要走。最后,其实 VLA 应用的难点还有匹配语言描述和驾驶行为或者机器人动作的训练。

目前VLA 模型应用于自动驾驶的一个主要障碍是缺乏能够有效结合视觉数据与语言描述和驾驶行为的大规模数据集。现有数据集往往在规模和全面注释方面存在不足,尤其是对于语言,这通常需要费力的人工操作。这限制了能够处理现实世界驾驶复杂性的稳健 VLA 模型的开发和评估。所以这些都是目前 VLA 工程落地,需要攻克的问题。目前准确来讲,应用VLA的应该屈指可数,甚至没有,但大批车企以及自动驾驶企业布局中。

我们之前文章《采用 ChatGPT 类似大模型作为自动驾驶算法核心的 - Waymo 的端到端多模态算法 EMMA》中讲到的EMMA,就是Waymo内部团队在创新和测试探索的 VLA。国外的创业公司Wayve,他的主要投资方是微软和软银,走的是提供L4软件算法的路线,目前测试车队已经从欧洲扩展到北美,与Uber达成合作协议,未来可能进入Uber平台。他在开始就站位采用通用人工智能来解决自动驾驶,所以可以看到之前就采用LLM,之后采用VLM,目前有消息其正在采用类似于VLA的模型。国内,元戎启行在上个月宣布下一步计划使用VLA,计划在英伟达Thor芯片上进行开发,不过Thor推迟到明年年中量产,高性能Thor估计年底,所以估计中国的VLA大概率在明年中旬声量巨大,一起卷。另外,就是理想,这个我们之前文章《智能驾驶技术演进与未来挑战:从目标物识别到大模型上车》中讲过理想在上半年就开始推进VLM,现在其车上智驾已经采用VLM,那么接下来肯定是朝着VLA进发。

小鹏,目前没有信息,但是看小鹏科技产品的布局,从机器人,汽车到飞行基本上也赌的是人工智能,如果不走通用人工智能的方向,那么显然战略失误,所以估计在研发中或者布局中。

华为,比较特殊,有自己的闭环和中国特色发展,其200TOPs的MDC显然在规则化,小模型的算法方面做的是一流,车辆运动控制遥遥领先,但最近估计也是感觉端到端是未来,这个月的动态显示其急攻一段式端到端,那么估计其应用VLA也不会很长。

至于,蔚来汽车昨天搞了NIO Day发布了一大堆东西,由于没有邀请我,我得说说蔚来的问题了,开玩笑,蔚来一直是我喜爱而且认为有格局和格调的品牌,但蔚来有点不像新势力了,他反过头来在追随传统汽车的末日黄昏,蔚来在硬件端是在准备,但是在智能驾驶软件端,目前缺少相关信息。很难说,不过,自动驾驶采用AI的大方向是既定的,但是AI的发展太迅猛了,从采用CNN识别物体到Transformer BEV 构建时空关系应用大概也就是几年,但从端到端大模型演化到采用通用人工智能的VLM却是一年之内。那么对应的从文字LLM 到视觉的VLM再到未来是不是空间Spatial 人工智能的大力发展?AI 还是一个快速发展的小孩,都有可能!*未经准许严禁转载和摘录-参考资料:

2024_Kira_ECCV_FOCUS.pdf -

Google deepmind RT-2 .pdf - Anthony Brohan, Noah Brown等

OPEN VLA .pdf - Moo Jin Kim∗,1 Karl Pertsch∗等

2024-IB-Introduction-Embodied-AI-Wayve.pdf

加入我们的知识星球可以下载包含以上参考资料的公众号海量参考资料。