清华校友,最新自动驾驶研究成果再登Nature。

去年,Nature正刊曾罕见的将封面给了自动驾驶研究“仿真效率提升2000倍”——同样是这个这个团队的成果,成为自动驾驶圈内一时热议的重大进展,智能车参考也详细介绍过。

这次新研究发表在Nature子刊《Nature Communications》,关注更加底层、更加核心的AI技术难题:

稀疏度灾难。

有点“神乎其神”,稀疏度是个啥东西,咋就成了自动驾驶的灾难?

严谨的定义是这样:

高维变量空间中安全关键事件的稀疏度。

通俗的说就是,拿来喂给AI司机的训练数据中,真正有用的不多。

举个例子,现在车企、自动驾驶公司动辄说自己有几百上千万公里实测里程,或者仿真测试里程过亿,但都回避了关键问题:

这些数据中,真正对系统能力有关键性提升的有多少?

比如自动驾驶在平直无车的高速上测试百万公里,可能都不如在城市中遇见一次“鬼探头”的提升大。

关键场景的查漏补缺,行业内通常称为“长尾场景”。

现在一般有两种解决思路,一种是大力出奇迹,尽可能多的车,跑尽可能多的路,期望最大程度覆盖各种罕见的交通状况,让自动驾驶能力从量变积累到质变飞跃。

其实,包括现在成为行业共识的端到端技术体系,本质上仍然是通过这样的思路解决问题,只不过把整个自动驾驶流程中更多环节的权限移交给了AI。

另外一种,则是在有限算力、参数限制下,用人为手写的规则,给自动驾驶套上“安全壳”,极限情况下通过降级或者刹停等等手段兜底。这是现在大部分量产智驾的方法,但劣势很明显:系统决策僵硬死板,泛化性差,体验更差。

不知大家发现没有,无论是哪一种方式,都没有在AI算法这个层面剖析“稀疏度”本质,自然也就提不出针对性的解决方案。

作者在论文开篇就直接指出了这个问题:

尽管在公共道路上积累了数百万英里的测试里程,但自动驾驶仍难以有效处理频发的“安全关键事件”。能商用的L4也一直落不了地。

所以将“稀疏度”称为“自动驾驶的灾难”。

新研究解决稀疏度灾难的方法,是打开AI黑箱,尝试用数学表达稀疏度本质,并提出了三种对应的解决办法。

具体来说,作者认为传统上比较重视的安全关键事件的概率分布,其实并不核心。

相反,真正挑战在于如何定义高度复杂场景中安全关键情况的稀有性,例如不同的天气条件、不同的道路基础设施以及道路使用者的行为差异…

这些安全关键情况,可能由于多种原因而出现,比如对未知物体的错误识别,或对附近行人运动轨迹错误预测…这类事件发生的概率很低,大多数可用数据只包含很少的罕见事件信息。

因为罕见事件的宝贵信息可能被大量正常数据所掩盖,所以深度学习模型其实很难有效学习到这些安全关键事件。

关键的地方来了。深度学习的本质是通过优化目标函数对具有特定分布的数据期望,来获得神经网络的最优参数。

为了解决这个优化问题,最常用的方法是基于梯度下降,在每个训练步骤使用一批数据通过蒙特卡洛估计来估计梯度。

然而,随着安全关键事件的罕见性增加,估计方差会呈指数增加,导致“稀疏度灾难”。

解决方法有三个。

首先是使用更多罕见事件数据进行有效训练。

这种方法侧重数据,专门利用与罕见事件相关的数据来不断改进系统能力。但定义和识别罕见事件不是那么简单的。因为它们依赖于特定于问题的目标函数,并受到安全关键事件的时空复杂性的影响。更重要的,现在学界仍然缺乏可以指导罕见事件数据利用的理论基础。

对于这样的安全验证任务,团队之前的试图通过密集深度强化学习 (D2RL) 方法来解决(即登上Nature封面的研究),实验结果表明,D2RL 可以显著降低策略梯度估计的方差,这是解决 CoR 的重要一步。

其次是提高机器学习模型的泛化和推理能力。实际上作者在这里讨论的就是AGI的问题,目前在自动驾驶领域最前沿的尝试是端到端模型。

人类可以在有限的经验(通常少于一百小时的训练)下学习驾驶,所以未来的AI也有可能在不依赖大量特定于任务的数据的情况下克服 CoR。这就要求AI同时具备自下而上的推理(感知数据驱动)和自上而下的推理(认知期望驱动)能力。

可以参考大型语言模型 (LLM) 和视觉语言模型 (VLM) 的方案,它们的基础模型通过采用完全监督微调、情境学习和思路链等技术,展现出了出卓越的泛化和推理能力。

第三种方法,是通过减少安全关键事件的发生来减轻CoR对整个系统的影响。

直白的说就是尽量降低系统对场景、目标的错检漏检。具体方法有很多,比如将传统深度学习模型和强化学习想结合,训练AI“预防性驾驶”能力、车路协同多传感器融合、车云一体化方案等等。

三种解决 CoR 问题的潜在方法,从不同角度出发。不过作者强调,这些方法并不相互排斥,结合起来会有巨大的潜力。

CoR的影响不仅仅局限在感知环节,而是渗透进了自动驾驶各个流程,逐级累加。一个概率极低的安全关键情况一旦出现,可能造成很严重的后果。

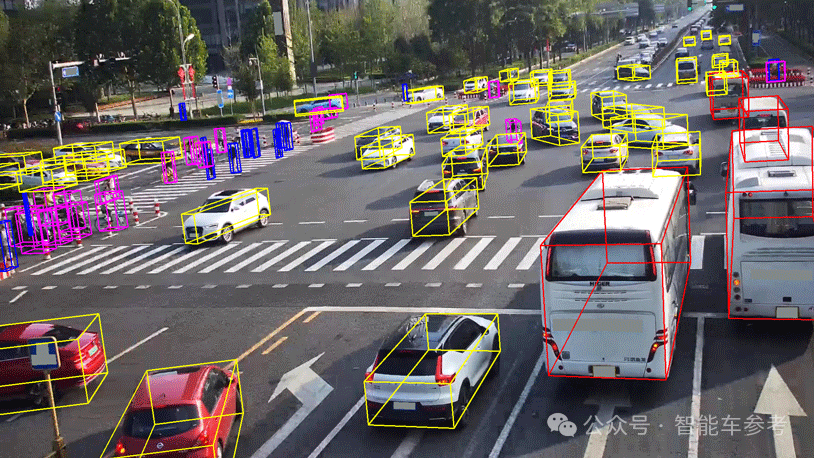

例如,单帧中的物体分类错误可能不是什么大问题,而一系列帧(clips)中的多个物体分类错误可能会导致严重的错误识别和误判,此类事件的发生概率远低于任何单个错误的发生概率,因此 CoR 问题变得更加严重。

轨迹预测层面上,一个小小的预测错误可能会导致误报或漏报,从而导致过于谨慎的驾驶决策或过于自信的决策而导致事故。所以行为预测模型必须有效处理容易出现CoR的罕见事件。

决策环节,以往由于现实世界数据的缺乏和偶然性,深度学习模型很容易受到CoR的影响,这可能导致策略梯度估计的严重差异。

自然而然,由于CoR的存在,理论上评估自动驾驶的安全性能需要数亿英里,这是不切实际且效率低下的,这也是为何仿真测试成了主流。但问题是,许多现有方法仅限于处理有限目标的短场景段,无法捕捉现实世界安全关键事件的全部复杂性和多变性。

所以CoR尽管不是一个看得见、摸得着的bug,但危害深刻渗透进自动驾驶每个环节。

这项新研究最大的意义,是解释了CoR的数学本质,并提出了几种可能的解决方法。

这项研究由美国密西根大学和清华大学研究人员合作完成。

一作、通讯作者刘向宏博士,现任美国密歇根大学讲席教授、Mcity主任(密歇根大学主导的智能交通模拟城市项目)。

他在国内最被外界熟悉的身份是滴滴前首席科学家。

刘向宏1993年本科毕业于清华大学汽车工程系,2000年在威斯康星大学麦迪逊分校取得博士学位。

刘教授是交通工程领域论文引用率最高的学者之一,他发明的用于精确测量交叉路口的排队长度和旅行时间的SMART-Signal系统于2012年取得美国国家专利,并已在美国明尼苏达州和加州得到广泛应用。

本文共同一作、通讯作者封硕,现在在清华自动化系任助理教授,曾前在刘向宏教授的Traffic Lab做博士后、研究员。

封硕本科和博士学位都在清华大学自动化系获得,研究方向是优化控制、互联和自动驾驶评估以及交通数据分析。

从封硕和刘向宏教授团队以往发表的成果和科研方向来看,他们一直在持续推进自动驾驶安全验证评估和仿真测试的优化升级。

比如之前我们报道过的D2RL,就是通过强化学习手段针对性生成高价值数据,提高仿真测试的效率。

有趣的是,无论是自动驾驶、智能汽车产业界从工程实践出发,还是高校学者从数学原理层面抽象归纳总结,竟然都指向了AGI、端到端、数据驱动的路径。

所以端到端会是自动驾驶的最优解,或者说它会是自动驾驶“历史的终结”吗?

— 联系作者 —

智能驾驶2023年度评选结果

在经过广泛征集、专业推荐,以及智能车参考垂直社群的万人票选后,智能车2023年度评选结果正式发布。涵盖三类奖项:

· 十大智能车领军人物

· 十大智能车产品

· 十大智能车技术方案

在汽车工业迎来百年未有之大变局时,我们希望能以此提供智能维度的参考和注脚。

其中,十大智能车技术方案是:

<< 左右滑动查看更多 >>

— 完 —

【智能车参考】原创内容,未经账号授权,禁止随意转载。

点这里👇关注我,记得标星,么么哒~