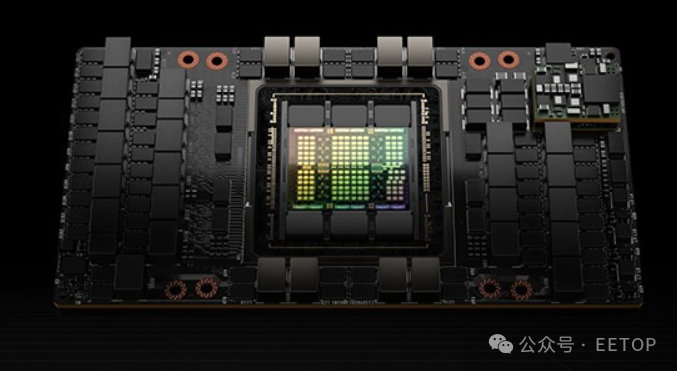

埃隆·马斯克在面向投资者的演讲中透露,新的超级计算机将使用多达100,000个基于Hopper架构的英伟达H100 GPU,使其至少比现有最大的GPU集群大四倍。英伟达的H100 GPU在AI数据中心芯片市场备受追捧,尽管强劲的需求使去年很难获得。但这些已经不是曾经的顶级 Nvidia GPU,英伟达即将推出用于 AI 和 HPC 应用的 H200 计算 GPU,并准备在今年下半年推出基于 Blackwell 的 B100 和 B200 GPU。

目前尚不清楚为什么xAI决定在其2025年的超级计算机上使用上一代技术,但这项巨大的硬件投资必须反映xAI的雄心壮志。马斯克认为自己“对按时交付超级计算机负有个人责任”,因为该项目对于开发大型语言模型非常重要。

xAI 寻求直接与OpenAI 和谷歌等 AI 巨头竞争。马斯克也是OpenAI的联合创始人,他将xAI定位为人工智能领域的强大挑战者,这正是他需要即将推出的超级计算机的原因。据马斯克称,Grok 2 模型需要大约 20,000 个 Nvidia H100 GPU 进行训练,而未来的迭代,例如 Grok 3,将需要多达 100,000 个 GPU。