点击这里👇关注我,记得标星哦~

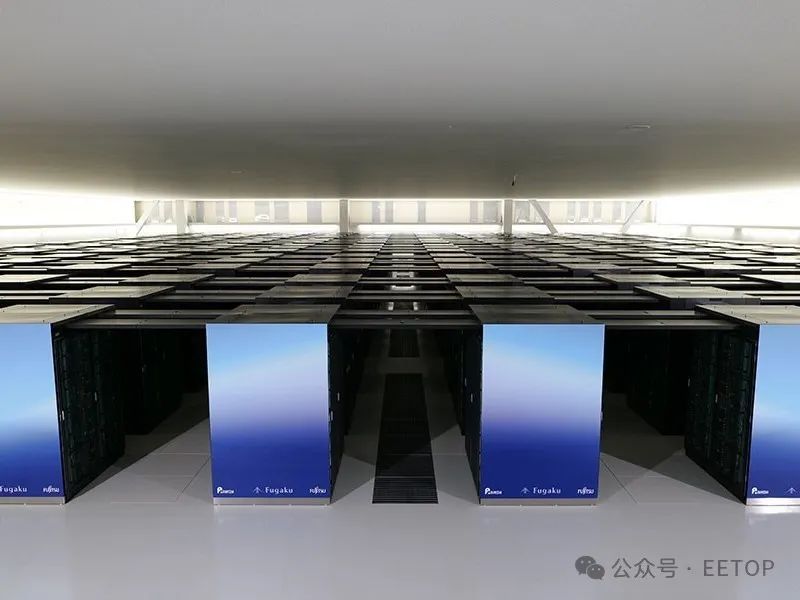

富士通的Fugaku-LLM在Fugaku超级计算机的13,824个节点上使用3800亿个Token进行训练,该超级计算机基于A64FX处理器,支持FP64、FP32、FP16和INT8模式,适用于各种AI和传统超级计算机应用。Fugaku-LLM的训练自然而然地利用了针对超级计算机架构和 Tofu 互连D 进行优化的分布式并行学习技术。

Fugaku-LLM具有130亿个参数,与GPT-4的1750亿个参数相比显得微不足道。富士通表示,130 亿参数的 LLM 不需要庞大的计算资源来进行推理,这对日本的企业和研究人员来说是最佳选择。约 60% 的训练数据是日语数据,40% 的数据是英语、数学和代码数据。

这种广泛的以日语为中心的训练使其有别于其他主要在英语数据集上训练的日语模型。因此,Fugaku-LLM拥有卓越的日语水平,在日语MT-Bench上获得了5.5的平均分,这是使用日本原始数据训练的公开可用模型中的最高分。根据富士通的数据,它在人文和社会科学方面尤其出色,取得了令人印象深刻的 9.18 分的基准分数。

Fugaku-LLM计划是由东京工业大学、东北大学、富士通株式会社、RIKEN、名古屋大学、CyberAgent和Kotoba Technologies等日本领先机构之间的合作推动的。他们合作的原因之一是通常用于训练和推理 AI 模型的 GPU 短缺。另一个原因是,该模型可以与富士通的下一代 150 核 Monaka 数据中心 CPU 一起使用,该 CPU 针对 AI 和 HPC 工作负载进行了优化。

Fugaku-LLM现在可以在GitHub和Hugging Face的指定许可条款下用于学术和商业目的。此外,它还将从2024年5月10日起通过富士通研究门户网站提供。