芯传感

聚焦芯片与传感器产业,与诸君共同探索未来趋势。

203篇原创内容

公众号

点击名片 |关注我们

FOCUS ON US

本文来源:芯传感

摘要:在某些场景下,由于需要采集的数据种类多、量大,单个传感器难以满足所有需求,因此多传感器的融合正成为主流方案。

但是,传感器融合难度非常大,比如在汽车领域,摄像头、毫米波雷达、激光雷达所收集的数据格式差异较大,从采集到处理再到应用,不仅过程复杂,更是在不同的细分场景下,对融合提出了更高的要求。

而本文就针对传感器融合的现状进行了解读,通过业内人士在项目中的总结与观点,讨论了具体场景下,传感器融合面临的挑战,包括对不同传感器的选择,技术层面中AI与传统DSP的优劣等等。

本文翻译自Semiconductor Engineering,原作者ANN MUTSCHLER。

这其中有多个问题需要解决,包括如何对不同类型的数据进行分区、优先级排序和最终组合,以及如何构建车辆内的处理架构,以便车辆能足够快地根据这些不同的数据类型做出决策,以避免事故发生。但对于如何实现这一目标还没有最佳方案,这就是许多自动驾驶OEM采取截然不同方案的原因,这也能解释为什么迄今还未出现完全自动驾驶的车辆。

“针对这个场景,目前有三种常见方案,”西门子工业软件混合物理和虚拟系统、汽车和军用航空副总裁David Fritz表示。“第一种方案是先融合来自多个传感源的原始数据,再对其进行处理。虽然这种方法可以降低功耗,但一个传感器阵列的不良数据可能会影响其他传感器的良好数据,从而导致不良结果。此外,大量原始数据的传输还带来了带宽、延迟和系统成本等其他挑战。”

第二种方案是融合处理后的数据:每个传感器单独处理数据,其处理结果就是对其检测到的内容的解释。“这种方案的优势在于,它可以无缝集成机载传感器结果。包括自己车辆、其他车辆、路端设施的传感器,”Fritz说。“不过这种方案的挑战在于,如何给相应传感器打上通用标识并进行标记,以便它们可以在不同的车辆和基础设施之间共享。”

Fritz继续说道“第三种方案——也是我们认为从功耗、带宽和成本角度来看最具吸引力的一种——是前两种方案的混合。在这种方案中,物体被传感器检测到但不被分类。在这种情况下,物体的点云被传输到机载中央计算系统,该系统对来自内部和外部不同传感器的点云进行分类(标记)。这就显著降低了带宽和延迟,以及传感器的成本和负载,并允许车辆以任何它喜欢的方式解释或分类物体,从而消除了对通用标识或标记的需要。”

不过汽车生态系统中的讨论才刚刚开始,还有很多挑战需要克服。

“你需要弄清楚你拥有哪些数据,以及何时使用它们,”Arteris IP业务开发副总裁Frank Schirrmeister说。“所有的格式都非常不同。如果您正在使用激光雷达,就会拥有一些带有距离信息的图像;在相机中,它们是RGB,并且有一组像素。所以目前看来就有了热成像和别的东西。但即使能够关联和融合所有这些内容,您也需要先以某种方式理解这些格式。从架构的角度来看,数据处理单元放置的位置则有了更高的要求,比如在传感器中或传感器附近。在所有的事情都完成之后,就可以在不同部分之间完成对象关联。只是,你还需要弄清楚细节,比如物体有多热、有多远等。然而这些不同传感器的Veen图,有些具有一组重叠的特征,但另一些则呈现出了传感器之间的差异性。”

值得一提的是,得益于算法的不断演进,以及芯片行业对SoC架构的深入见解,传感器融合是一个快速创新的领域。

“传感器融合的一个共同点是需要异构处理方法,因为它需要结合信号处理——通常使用DSP、专用加速器上的AI处理,以及使用CPU进行代码控制,”新思科技(Synopsys)的高级产品经理Markus Willems说。“针对不同类型的传感器,还要考虑其支持的数据类型。这包括用于图像数据的8位整数处理,或用于雷达处理的32位单精度(SP)浮点,而AI处理可能需要bfloat16等。在单芯片上运行不同类型的处理器需要复杂的软件开发流程,利用优化的C/C++编译器和函数库,以及支持最新神经网络(包括传感器融合中使用的变压器)的图形映射工具。内存、带宽和延迟等都是关键的设计参数,设计人员希望看到处理器仿真模型和SoC架构探索工具的早期可用性,以检查假设场景。”

当然,传感器融合不仅在汽车领域受到广泛关注,它在其他市场也很受欢迎。

“我们专注于汽车领域,涉及图像传感器、激光雷达。”Cadence Tensilica IP集团产品总监Pulin Desai表示,“但其他应用比如机器人,还可能要涉及更多图像传感器,以及IMU、陀螺仪、磁力计、加速度计等其他传感器,并且在应用上,您将对其进行融合。这些传感器在许多不同的领域以不同的方式使用。虽然汽车传感器的话题很热,但家用扫地机器人也使用相同的图像传感器和雷达传感器,它可能具有与无人机非常相似的架构。任何类型的无人驾驶车辆都具有此类传感器。”

在传感器融合中,因为有大量数据流入,所以弄清楚在哪处理所有数据是一个挑战,毕竟并非所有数据都采用相同的格式。

“这其中存在典型的边缘计算情况,您需要决定如何平衡整个链条的处理——从模拟世界获取数据的地方,到在大脑中做出决定或与驾驶员交互的地方混合使用模型,”Arteris的Schirrmeister说道。“对象关联听起来更现实,但也存在各种各样的挑战。热成像、激光雷达和其他雷达都使用不同的类型来表示数据。如果你知道激光雷达的工作原理,就明白它本质上是给你一定距离内的点,这与你从摄像头获得的数据完全不同。将这些全部关联起来当然不是一件小事,并且可能需要大量计算。更重要的是,您还需要确定不同的item之间是否彼此不一致。如果是这样,你会选择什么?你使用一些平均值吗?对于所有这些传感器的组合来说绝对是一个挑战。”

当谈到数据的实际融合时,西门子的Fritz考察了多种方法。

“第一种方法是在早期尝试中,NVIDIA 取得了飞速发展,他们说,‘我们可以做很多人工智能的事情。当传感器数据进来时,我们可以使用我们的高端GPU,尝试降低这些GPU的功耗,然后使用神经网络对其进行处理。’这就是几年前我们在设备中放置一个机架用来做水冷的原因。

第二种方法是,激光雷达人员会说,‘我知道你不能为每台激光雷达支付20000美元,所以我们正在努力让激光雷达变得更便宜。有人说,‘好吧,等等,相机大概是35美分,我们为什么不放一堆摄像机,把所有这些融合在一起呢?’于是摄像头取代雷达传感器成了部分企业的选择。

第三种方法是,几年前有人开始了一种采用“蛮力”,或说几乎是“脑死亡”的方法,“成功”地融合了激光雷达、摄像头、其他雷达的数据,例如将激光雷达数据转换为RGB。“因为有距离信息,所以我们的帧数暴增,然后我们将通过最简单的卷积神经网络运行它,来尝试检测对象并对它们进行分类。这就是它疯狂的程度,但有些人仍在尝试这样做。”

相比之下,特斯拉仍然主要依赖摄像头数据。Fritz说,这是可能的,因为立体相机的功能,甚至是单声道相机中固定时间段内的连续帧,可以使用视差来确定深度。“正因为如此,他们说,‘为什么我需要激光雷达?因为我没有激光雷达,所以我就不存在传感器融合问题。’但实际情况是,它只是简化了事情,并没有解决问题。那假设相机上的镜头被水或污垢覆盖了怎么办?他们需要担心这些问题。不过在极端的另一端,如果你完全依赖激光雷达也不好,我见过这样的场景:路边有一个“人穿过街道”的2D图像,而汽车认为这是一个真人。为什么?因为反射,激光雷达上会收录多种人们不希望的数据,而且要过滤掉这些数据非常困难。”

融合不同的数据类型还取决于传感器代表的需求。“人们正在谈论早期、中期和晚期融合,”Cadence的Desai 说。“这一切都取决于我们的客户、我们客户的客户的系统设计,这说明了他们试图解决什么类型的问题。我们对其中一些事情是不可知的,因为体视传感器可以进行早期融合或后期融合,因为你的图像和数据都已经识别了物体,并且你可以对其进行后期融合。但这之外还可能存在中间融合,这更像是系统供应商选择他们想要如何进行融合,他们想要做多少计算,信息有多强大,或者他们试图解决什么类型的问题。于是融合的难度取决于融合的类型。”

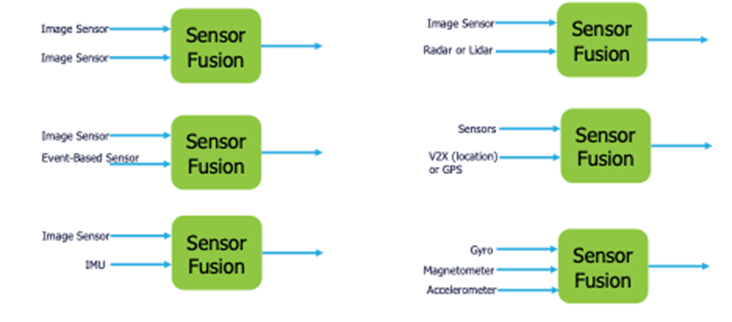

传感器融合的类型

不同的融合选项,来源:Cadence

Desai说,另一个需要考虑的因素是何时使用它们,或者传统DSP是否更合适,尤其是在人们对AI/ML技术高度关注的情况下。“我将我们过去所做的一些事情,与我们今天所做的事情进行了比较。发现其实AI一定程度上限制了我们。

在某些问题上,你可以利用人工智能实现非常高的成功率。例如,我们在2012年和2013年做人脸和人物检测时,我们使用了传统的计算机视觉算法,但当时它们不是很准确,因为达到高准确度是非常困难的。然后当我们开始采用AI时,它巨大地提升了人脸检测和人物检测方面的性能。

但现在有一个非常确定的情况,如果你说,“我要做人脸检测,我可以达到我们所说的人类99%的准确率,而人工智能可以给我97%的准确率。”那我为什么要用一些不够好的东西?我会去使用这个人工智能,因为我确切地知道它的作用,并且它提供了最好的准确性。但在某些情况下,例如当我仍在尝试解决问题时,我需要用不同的算法在特定环境中进行尝试。我需要能够做到X、Y或Z,并且我需要灵活性。在那些场景下,您可以继续使用DSP来执行这些算法。”

此外,很多时候,使用人工智能引擎时,进入人工智能引擎的数据必须经过预处理,这意味着它必须采用特定的格式。

“在特定的数据类型中,你的人工智能引擎可能会说,‘我只做定点,’”Desai解释道。“所以你可以使用可编程引擎来做到这一点。那么,一旦你把某些东西放入人工智能中,你可能就没有太大的灵活性了。四年后,当新事物出现时,你或必须改变它。有很多不同的因素。本质上,如果您正在做一些非常确定的事情,您就会知道您可以实现非常高的性能,并且您今天就知道了。你可能会说,‘今天我要引入人工智能来解决这个问题。明天,我可能仍然会这样做。”然后,我通过使用可编程引擎来增加灵活性。或者,如果我不知道我需要使用它,那么我仍然会使用经典算法来处理它。即使我有人工智能,我仍然需要对数据进行预处理和后处理,所以我需要使用我的经典DSP算法。”

结论

随着汽车OEM和系统公司将其计算架构向传感器融合发展,大量的实验将成为必要。

西门子的Fritz认为,在这个进化时期,处理开发的正确方法是雇用和/或组建一些小团队来进行大量试点项目。“可能有十几个人或二十来人。例如,他们的目标可能是到2026年或2028年在测试环境中生产300个原型。”

尽管如此,每个OEM目前的处境仍取决于他们自己、他们进行架构开发的时间以及他们未来希望如何做到这一点。

“不同的OEM拥有不同水平的专业知识。有些人正试图加强他们的团队来解决这个问题,”Fritz指出。“大多数原始设备制造商都有一点‘不是这里发明的’综合症,他们认为自己可以做到这一点,因为他们有很多聪明的人。问题是,您是否要将ECU(电子控制单元)从100个增加到200个,并使车辆的重量增加一倍?换句话说,他们现在的员工中往往没有全面思考这个问题的人。他们的想法是,‘我有一把锤子,所以我面对的一定是一颗钉子。’然后他们就惨败了。”

与大多数新技术一样,开发人员认识到他们需要一个适合自己CPU的编译器,因此他们尝试构建自己的编译器。“然后他们发现,他们认为可以做到的两个人却做不到,并意识到他们还需要四个人,然后,再需要一两个人,”他说。“到最后,他们对它投入了如此多的感情,很难消灭它,而且这种情况会永远持续下去,直到最后他们最终购买了他们需要的芯片并解雇了100名内部开发人员。这种情况经常发生,在汽车领域也不例外。传感器融合是我们正在看到这种现象发生的几个关键领域之一。就像这个领域的其他一切一样,就像多年前发令枪响了一样,人们开始跑步,然后意识到,‘我还没有为这场马拉松进行训练。’”

等等,你想了解更多企业和产品?

那就在2023年9月20-22日,来深圳国际会展中心(宝安),参加IOTE 2023 第二十届国际物联网展·深圳站。60000平方米的展会,汇聚了多个产业上中下游的玩家,不仅能提供行业最前沿的产品信息,也为业内人士提供了交流合作的机会,观众只需报名,即可享受免费、高效、精准的资源对接。展会针对性地提供了传感器专场,此外也有RFID、工业物联网、云平台、通信、人工智能、电子纸、泛安防等领域。识别下方二维码,即可报名观展!

报名成为VIP观众观展

~END~